総務省と経済産業省は2026年3月12日に開催した有識者会合で、AI(人工知能)を開発・利用する企業に向けた「AI事業者ガイドライン」の改定案を公表した。指示を自律的に実行するAIエージェントや、ロボットなど現実世界で動作するフィジカルAIの定義を新設した上で、リスクを評価して人間の判断が介在する仕組みを構築することを盛り込んだ。意見募集を経て、2026年3月末をめどに正式版を公表する予定だ。

ガイドラインに法的拘束力はなく、利用するか否かは企業などの自主判断に任されている。ただしアンケートによると、企業の約8割が内容を認知し、5割弱が利用したことがあると回答している。AIエージェントなどを事業に組み込もうとする企業には一定の影響力を持ちそうだ。

影響が大きい箇所に人間の判断を介在

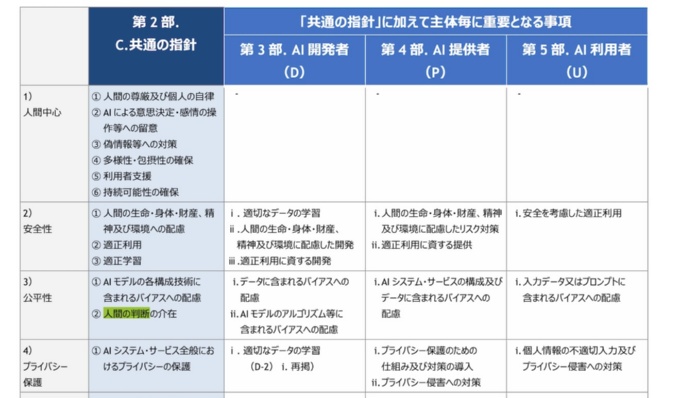

AI事業者ガイドラインはAIの開発者と提供企業、AIを利用する企業に対して、AIを安全に運用するための統制方法やチェック体制の構築などを定めている。総務省と経産省がそれぞれ策定していたガイドラインを統合する形で、2024年4月19日に第1.0版を公表した。今回の第1.2版は、第1.0版の公表以降3回目の改定となる。

ガイドラインの改定案では、AIエージェントの定義を「特定の目標を達成するために、環境を感知し自律的に行動するAIシステム」とした。フィジカルAIは「センシングを通じて物理環境の情報を取り込み、AIモデルによる処理を経て目的を達成する最適な方策を自律的に推論・判断し、アクチュエーター(駆動系)を介して物理的な行動へとつなげるシステム」と定義している。自律移動ができるロボットや自動運転車両がその典型例だという。

AIエージェントは複数のシステムと連係しながら自律的な分析や意思決定ができ、業務効率の向上への期待が高い。一方で改定案は、人間が意図しない取引をAIエージェントが実行したり、重要データを削除したりといった誤作動のリスクを挙げている。同様にフィジカルAIも自律性の高い運用方法が想定されており、現実世界で起こり得る誤動作の影響はこれまでのAIより大きい。

そこで改定案は、AIの出力や動作によって大きな影響や被害が生じ得る場合には、影響を抑制するため人間の判断を介在させる仕組みを設計・構築することを求めた。いわゆる「ヒューマン・イン・ザ・ループ」と呼ぶ仕組みで、人間が判断に関与する「ゲート」を、AIを使う業務プロセスの中に適切に設けることが重要になる。

次のページ

ゲートは「影響の大きいところに絞って」この記事は有料会員限定です