AIは1+1ができない。天才なのに小学生の問題で負ける理由 LLM(大規模言語モデル)バグ図鑑・序章

ごあんない🐾巻末に論文形式の本記事学術版がPDFで用意してあります。LLMに詳しい方や勉強中の方はそちらをお読みいただいてから本編を読んでも楽しめます🐾

(黒パグさんの日常の一コマ ガチ話)

今年受験が終わった中3の娘に、ある日こう聞かれました。

> 娘「ねえ、お父さん?数学わからないから解き方チャッピーに聞いたら全然意味不明だったんだけど?お父さんAIのプロでしょ?ねえ、なんで?」

>

> 黒パグ「あー、うん。そうだよね。そもそもAIっていうのは……」

>

> 娘「あ、お父さんストップ。長くなるから簡潔に。」

>

> 黒パグ「……はい。」

この記事は、あのとき簡潔に言えなかった答えです。

正直に言うと、その瞬間、私はうまく説明できなかった。「AIのプロ」を名乗りながら、中3の娘の疑問に答えられなかった。

……というわけで、6000字かけて調べました。娘よ、これが「簡潔に」への回答だ。

そしてこれは2026年の今でも、最先端モデル(o1、DeepSeek R1)で普通に起きている話です。

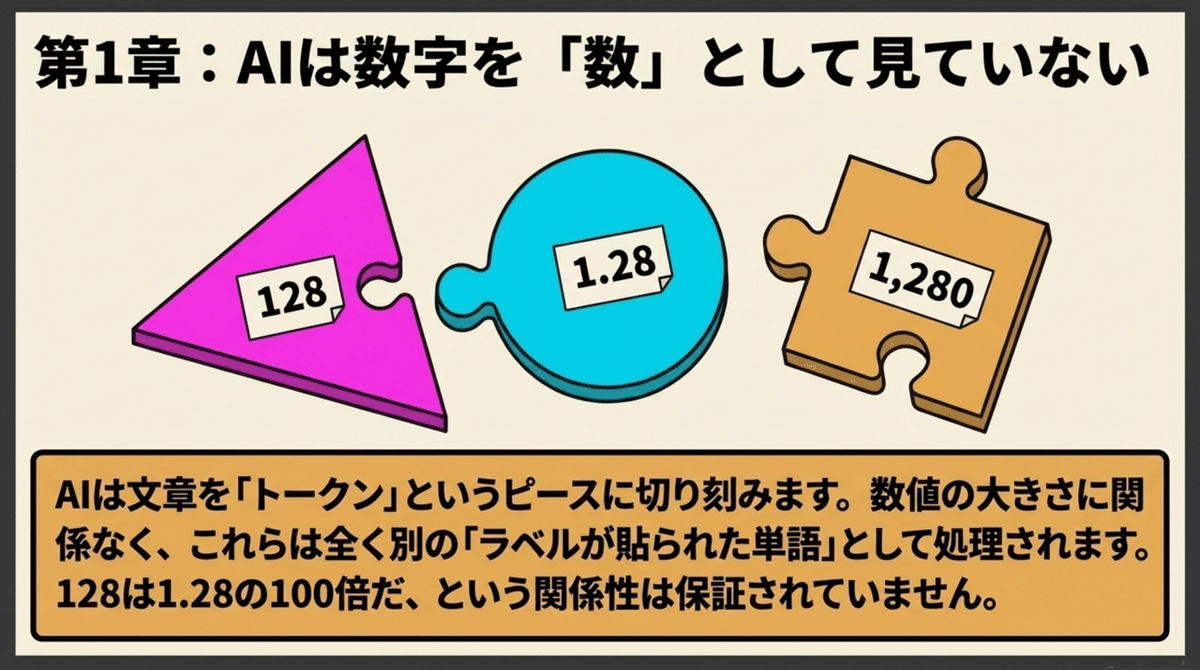

第1章:AIは数字を「数字」として見ていない

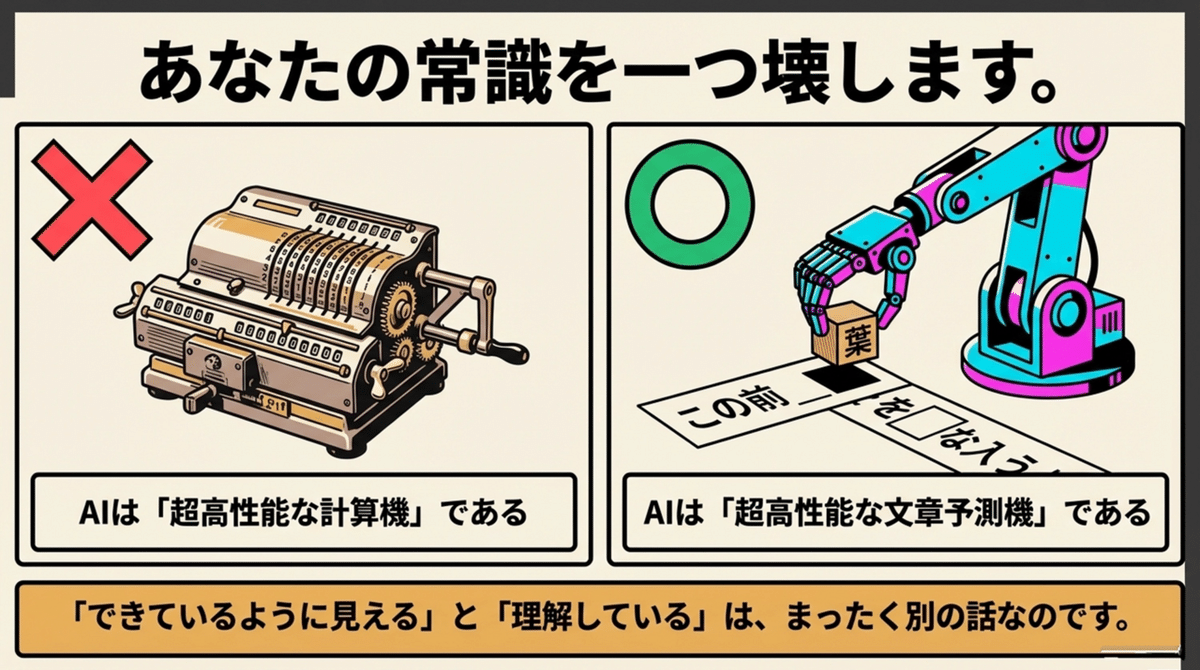

まず最初に、あなたの常識をひとつ壊させてください。

AIは「128」という数字を、数学的な「数」として処理していません。

「え?でも計算してくれるじゃん」と思ったあなた、それは正しい。でも「できているように見える」と「理解している」は、まったく別の話なのです。

AIの目に、世界はどう見えているか

AIは文章を処理するとき、まず文章を細かく切り刻みます。この「かたまり」のことを「トークン」と呼びます。

パズルのピースをイメージしてください。

「東京タワー」という文章なら、AIは「東京」「タワー」という2つのピースとして認識するかもしれません。あるいは「東」「京」「タワー」と3つに分かれることもある。切り方はAIによって違います。

そして数字も同じです。

「128」というピース、「1.28」というピース、「1,280」というピース。

AIにとってこの3つは「まったく別物」です。数値として「128は1.28の100倍だ」という関係は、ピースを眺めているだけでは保証されません。

〔ハルシネーションちゃん登場〕

「トークン目線で数字を見てる私〜。128も1.28も、私には同じ『ラベル』にしか見えないの。どっちが大きいかって?…えーっと(確率計算中)」

「128というラベルが貼られたピース」

もっと正確に言うと、AIにとって「128」とは「128というラベルが貼られた単語」に近いものとして処理されます。数値ではなく、単語に近い何か。

だから「128と129、どちらが大きい?」という問いに対して、AIは暗記と確率で答えます。学習データの中で「128より129が大きい」という文章をたくさん読んでいれば正解できる。でも「12800と12801ではどちらが大きい?」という問いになると、途端に怪しくなる。

学習データに十分な情報がなければ、AIは「なんとなくそれっぽい答え」を確率的に選ぶしかないのです。

(注:最近の大規模モデルは数値パターンをある程度学習しており、簡単な計算なら正しく答えることも多い。でもそれはあくまで統計的学習の結果であって、算数の授業で習うような「計算している」わけではない、というのが重要なポイントです)

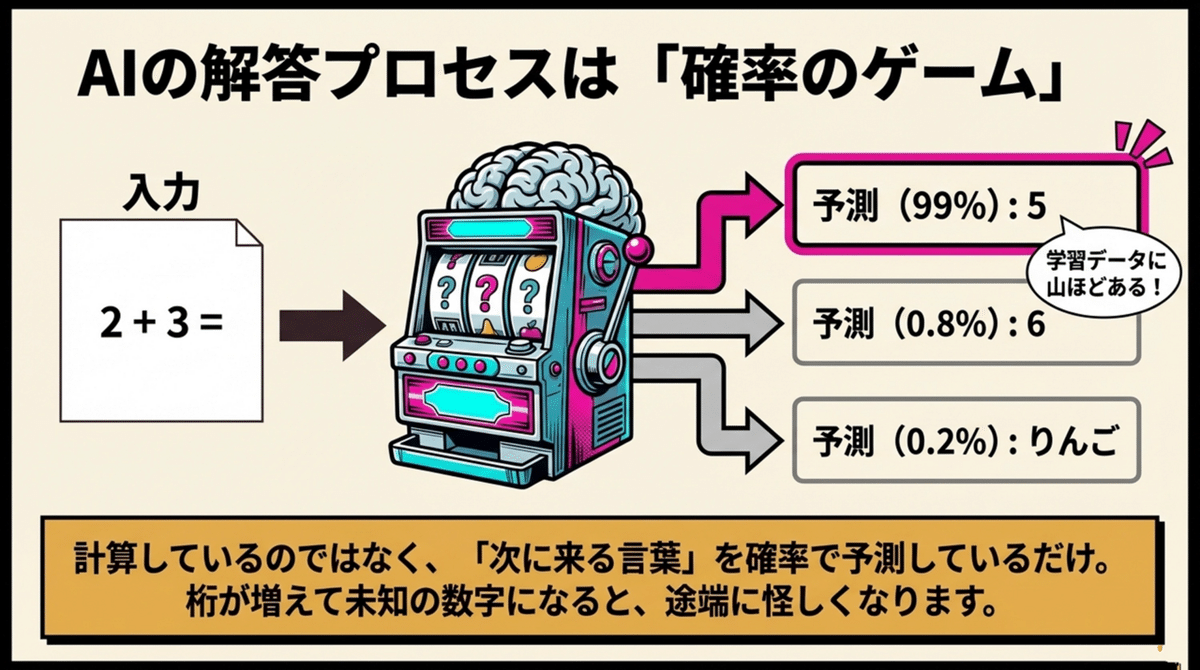

AIは「計算機」ではなく「文章予測機」だった

ここが核心です。

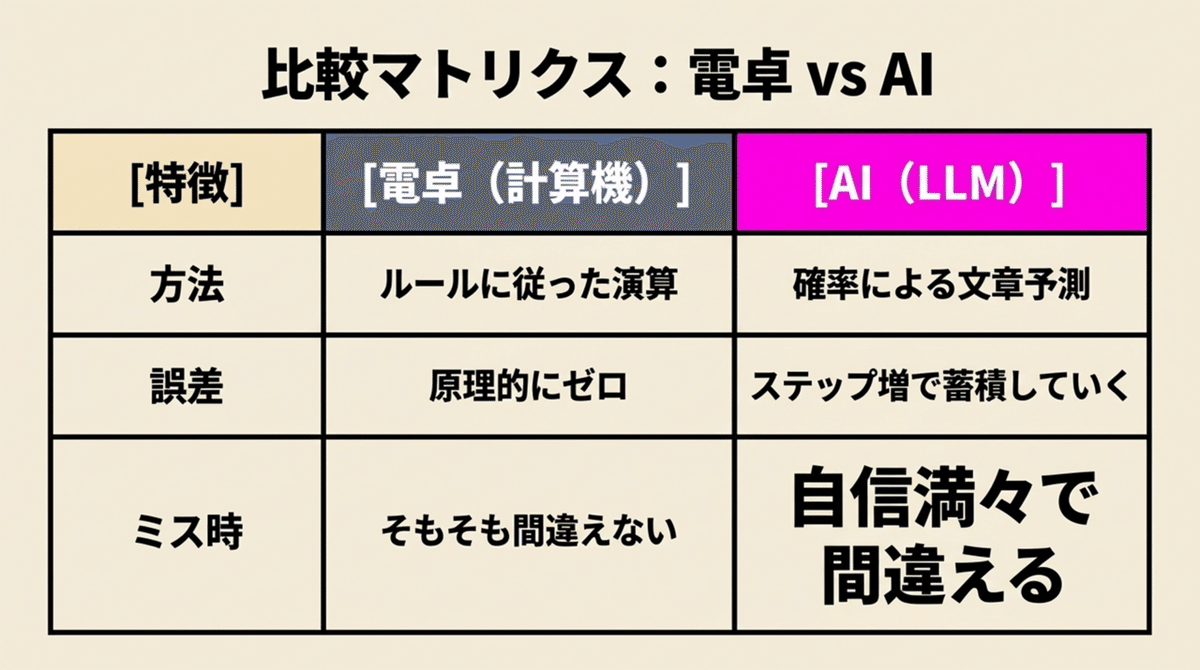

電卓は「計算するために作られた機械」です。2+3を入力すると、回路がルールに従って5を出力する。迷いがない。

でもAIは違います。AIは「次に来る言葉を予測するために作られた機械」です。

「2+3=」という文章の次に来る言葉として、学習データ的に最も確率が高いのは「5」だから5と答える。計算しているのではなく、「予測している」のです。

1桁の足し算なら「2+3=5」という文章は学習データに山ほどある。だからほぼ正解できる。でも桁が増えるほど、学習データに同じパターンがなくなり、AIは「だいたいこのくらいかな」という確率予測で答えるしかなくなっていく。

AIは計算機ではなく、文章予測機だった。

これが、娘の疑問への答えの前半です。

第2章:長い計算ほど壊れていく

さて、「AIは数字をラベルとして見ている」ことはわかりました。でもそれだけじゃないんです。

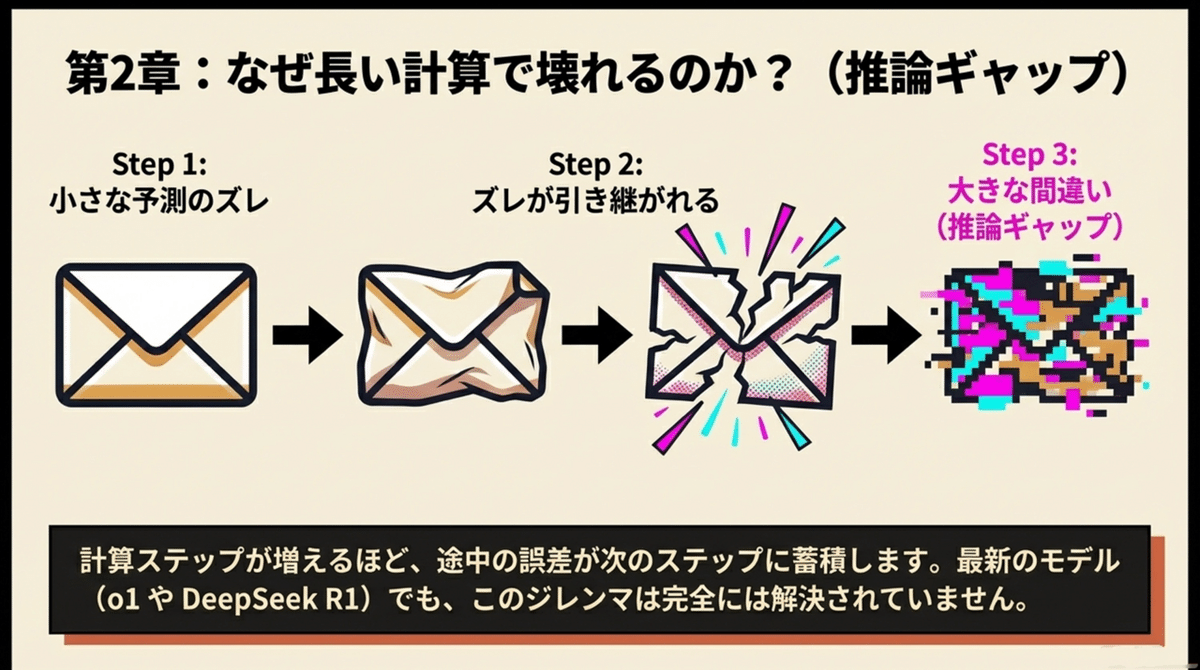

計算のステップが増えれば増えるほど、AIは壊れていく。

これが「推論ギャップ」と呼ばれる問題です。

100問の伝言ゲーム

伝言ゲームを思い出してください。

1人から2人への伝言ならほぼ正確に伝わる。でも100人のリレーになったら?最初のメッセージと最後のメッセージが別物になっているのはよくある話です。

AIの計算も同じです。

たとえば「37×48を暗算で解いて」と頼むと、AIはこんなふうに考えます(内部イメージ)。

```

37 × 48

= 37 × (50 - 2)

= 37 × 50 - 37 × 2

= 1850 - 74 ← ここまでは天才

= 1480 ← ここでハルシネーションちゃんが降臨

```

「……惜しい。いや、全然惜しくない。どこからその数字が出てきたの?」

ステップが増えるほど、途中の誤差が次のステップに引き継がれ、最終的な答えが大きくズレていくのです。

ハルシネーションちゃん登場!「37×48ですね!確信度100%で……1480です!(ドヤ顔)」

電卓とAIの決定的な違い

ここで一度、電卓と比べてみましょう。

電卓は「2+2=5」とは絶対に言いません。でもAIは言うことがある。そして言うときは決まって、自信満々です。

これが次の疑問につながります。なぜAIは「わからない」と言わないのか。

「最新モデルでも直っていない」という現実

2026年現在、「推論特化型」と呼ばれるo1やDeepSeek R1が普及しています。「これで計算も得意になった!」と思いきや、Xでは今でもこんな投稿が流れてきます。

「最新のo1に3桁の掛け算を頼んだら、途中で堂々と間違えて最後まで押し通してきた」

推論ステップを増やせば賢くなる。それは確かです。でもステップが増えれば増えるほど「伝言ゲームのズレ」も大きくなる。このジレンマは、2026年の今もまだ解決されていません。

ちなみに「温度」を上げると、さらにカオスになります。

以前書いた「Temperature(温度)」の記事を読んだ方ならピンとくるはず。

AIの「温度」を上げると、はるしねーしょんちゃんはさらにノリノリで計算を放棄し始めます。確信度100%のまま、宇宙規模の間違いを出力してくることがあります。

詳しくはTemperature記事をどうぞ

試しに、今すぐChatGPTにこう聞いてみてください。

```

「137 × 248 を暗算で解いて。途中の計算も全部見せて」

```

かなりの確率で、途中計算のどこかが壊れています。「やってみた」ぜひXでシェアしてください。

推論ステップが長くなるほど、AIは幻覚の中で計算している。

第3章:これはバグじゃなくて仕様です

ここまで読んで、こう思った人もいるかもしれません。

「じゃあAIって欠陥品じゃないか」

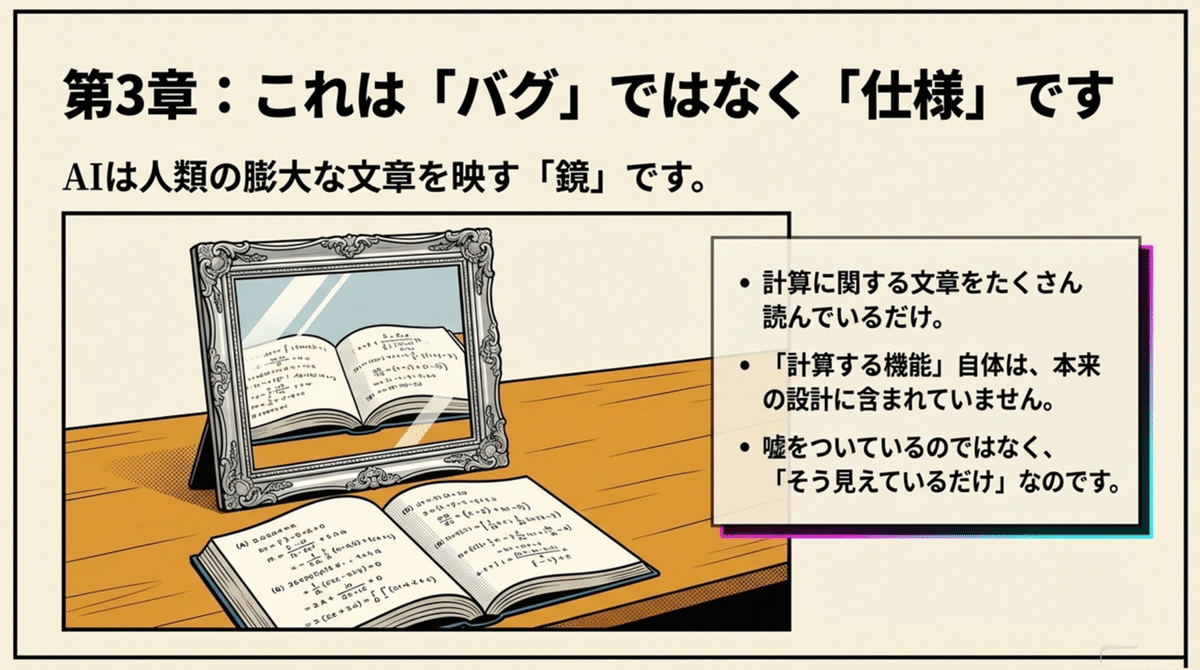

違います。これはバグではありません。仕様です。

AIは「鏡」のようなもの

鏡に映った時計を見たことがありますか?

針は動いているのに、なぜか「逆向き」に見える。鏡は現実を映していますが、現実を計算しているわけではありません。映しているだけです。

AIも同じです。

AIは人類が書いてきた膨大な文章を「映している」存在です。数学の教科書も、計算ミスの報告書も、全部読んでいる。だから計算についての文章はたくさん知っている。でも「計算する」という行為そのものは、本来の設計に含まれていないのです。

「私、鏡みたいに歪んじゃうの…ごめんね?でも嘘をついているわけじゃないんだよ。そう見えてるだけなの」

「欠陥ではなく設計の産物」。

ハルシネーションちゃんは嘘をついているのではなく、そう見えているだけ。この視点の転換が、AIと賢く付き合うための第一歩です。

これはバグじゃない。そういう生き物なのだ。

この章の内容をさらに深く知りたい方へ:

【注意🚨】ここから先は、ハルシネーションちゃんも頭から煙を出して逃げ出した「ガチの数理世界」です。Transformerの数学的限界、Attention機構の本質的な制約、関連論文レビューは巻末のPDFをどうぞ。論文ベースで理論を叩き込みたい変態(褒め言葉)な皆様をお待ちしています。

-----

第4章:じゃあどう付き合うか

「計算はAIに任せるな」と言っても、AIはすでに生活の中に入り込んでいます。では実際に、どう使えばいいのか。

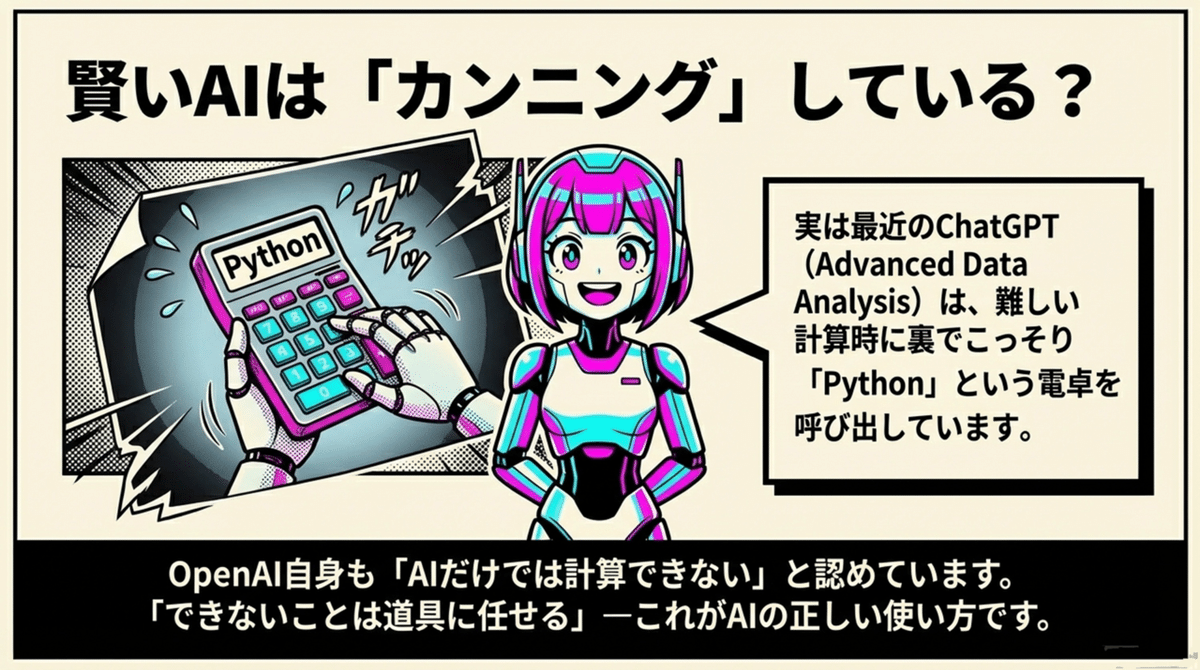

ChatGPTはこっそり「カンニング」している

実は、最近のChatGPTは難しい計算をするとき、こっそりPythonという電卓を呼び出しています。

Advanced Data Analysisという機能がそれです。裏側でPythonのコードを実行して、計算結果を返してくる。

つまりOpenAI自身も「AIだけでは計算できない」と認めて、電卓を持たせているわけです。

これはある意味、正直な設計です。「できないことはできない道具に任せる」という割り切りが、かえって信頼できる。

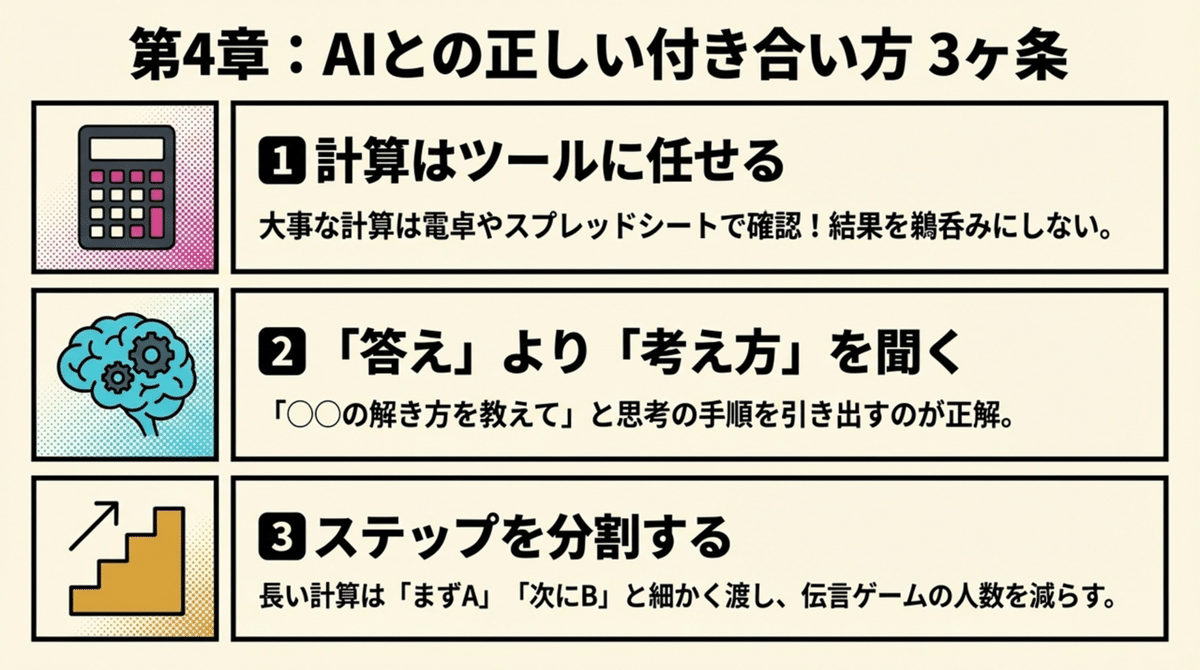

付き合い方の3原則

① 計算はツールに任せる

大事な計算は、必ず電卓やスプレッドシートで確認する。AIの計算結果をそのまま信じない。

② 「答え」より「考え方」を聞く

「37×48はいくつ?」ではなく「37×48をどう考えれば解きやすいか」を聞く。思考の手順を引き出すことが、AIの本来の強みを活かす使い方です。

③ ステップを分割して渡す

長い計算を一気に頼むのではなく、「まず37×40を計算して」「次に37×8を計算して」「最後に足して」と段階的に渡す。伝言ゲームのリレー人数を減らせばミスも減ります。

-----

ハルシネーションちゃん・小声

「電卓さん呼んでください……私ちょっと自信ないです……」

そしてもう一つ。

NotebookLMのように「自分がアップロードした資料だけを参照する」ツールを使うと、計算ミスのリスクが大きく下がります。外部情報を確率的に予測する必要がなくなるからです。これも次のシリーズで触れていきます。

締め:娘への答えと、次の謎

……というわけで、娘への答えはこうです。

(リアル会話)

「AIは計算機じゃない。文章を予測する生き物なんだ。だから、ときどき小学生の問題で負ける」

娘「…なるほど。まあ簡潔ではないけど。あ、それよりもお父さん家にいるならプリン作ってよ?カラメルはあんまり苦くないやつでお願い。」

ありがとう。

グラニュー糖50グラムに、水大さじ1 ……色が変わり始めたらお湯でを大さじ一杯…よし!ここだ!

ん……これでいいね。(すっかりはるしねーしょんちゃんを忘れる)

-----

気を取り直して

AIにとって、計算ミスは「うっかり」ではありません。それは、彼らがこの世界を「言葉の重なり」として捉えている証拠なのです。

でも、ここで一つの疑問が生まれます。

計算すらおぼつかない彼女らが、なぜあんなにも流暢に、そして時に残酷なほど自信満々に「真っ赤な嘘」をつくことができるのか?

計算ミスはまだ「可愛い失敗」です。次はもっとエグい話があります。

「次回は私が確信度100%で世界一の嘘つきになる話……待っててね♡」

次回:LLMバグ図鑑 第1章

「AIはなぜウソをつくのか。ハルシネーションという名の、設計された嘘」

-----

この記事が「なるほど」と思えたら、スキ❤️をもらえると次回の執筆燃料になります。

黒パグP([@ideal_slug1407](https://note.com/ideal_slug1407))