この記事は会員限定です。会員登録(無料)すると全てご覧いただけます。

AIコーディングの最前線は、単一モデルで開発する時代から、複数の専門家(AIエージェント)が協調して開発するマルチエージェント開発の時代へと移り始めている。OpenAIの開発環境「Codex」でも「サブエージェント」という機能が登場し、メインのAIエージェントが複数の補助AIエージェントを使ってタスクを分担する構成が現実的になりつつある。

こうした流れの中で、「GPT-5.4 mini」および「GPT-5.4 nano」が2026年3月17日(米国時間)に発表された。これらは、フラッグシップモデルであるGPT-5.4の知能を、より高速かつ効率的に活用するために設計された小型モデルだ。特にminiは、「サブエージェントとして複数を並べて使うことを前提とした戦略的モデル」として位置付けられている。

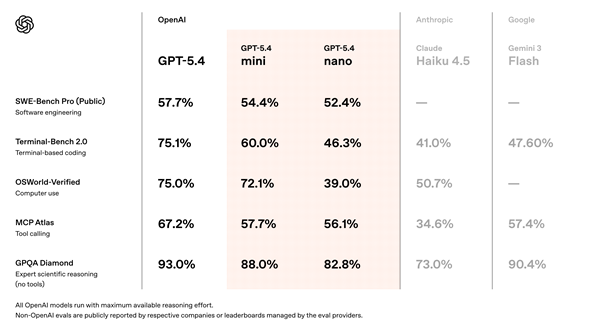

GPT-5.4 mini/nanoとフルモデル(GPT-5.4)の主要ベンチマーク比較(OpenAI公式Xポストより引用)

GPT-5.4 mini/nanoとフルモデル(GPT-5.4)の主要ベンチマーク比較(OpenAI公式Xポストより引用)ソフトウェア開発(SWE-Bench Pro)やターミナル操作(Terminal-Bench)、コンピュータ操作(OSWorld-Verified)、AIによるツール利用(MCP Atlas)、高度な知識問題(GPQA Diamond)など、実際の作業に近い能力を測る指標をまとめたもの。miniはフルモデルより性能は一段下だが、実務で使える水準に達している。

※ただし、このベンチマークは各モデルで利用可能な最大の思考レベル(reasoning_effort)設定で測定された結果であり、実際にminiを低い思考レベル設定(lowなど)で運用する場合とは性能が異なる可能性がある。また、他社モデルのスコアは各社や評価機関が公開している数値を引用しており、測定条件が完全に一致しているわけではない点にも注意が必要である。

OpenAIの公式説明では、GPT-5.4 miniはフルモデルの能力を小型モデルに持ち込み、ベンチマークでもGPT-5.4に「近い」結果を示すとされている。ただし、この「近い」という表現には注意が必要で、実際の数値(上の図)を見ると、特にコーディング系では数%~10%程度の差があり、最近のモデル競争が1~2%差であることを考えると、決して無視できる差ではない。

しかも、この数値はそのままうのみにはできない。図の注意書きにもある通り、このベンチマークは各モデルで利用可能な最大の思考レベルで測定された、いわばフルパワー状態での比較である。APIや開発ツールでの実運用では、コストや速度を優先して低い思考レベルに設定する、あるいは自動的にそのように設定されるケースも多く、この場合はここで示された性能より低くなる可能性が高い。

こうした前提を踏まえると、miniは性能を抑える代わりにコストダウンと高速化を図ったモデルと見るべきであり、「安くてそこそこ賢い」ではなく、用途を絞って使うべき軽量モデルと理解するのが適切だろう。

――ここからは『Deep Insider Brief』恒例の“ひと言コメント”として、筆者が実際にサブエージェント開発を試して感じたリアルな手応えをお伝えする。続いて、GPT-5.4 miniとnanoの特徴や価格体系について整理していく。

Deep Insider編集長の一色です。こんにちは。

筆者も早速、OpenAI Codex CLIでメインエージェントに「GPT-5.4」、サブエージェントに「GPT-5.4 mini」を割り当てて構成し、マルチエージェント開発を試してみました。結論から言うと、例えばサブエージェントを3つ用意すれば開発コストは単純に3~4倍に膨らみます。そのため、サブエージェントを「mini」にして3分の1程度のコストで回すというのは、非常に現実的な選択だと感じました。

一方で、マルチエージェント開発はまだ登場したばかりで、現時点では「難易度が高い」というのが正直な感想です。各エージェントに役割を持たせ、それらを連携させるには一定のノウハウが必要です。個人的には、Codex側が「どの役割のサブエージェントを何体用意すべきか」を自動で提案してくれるような進化に期待しています。

マルチエージェントによって開発を多角的に進めることで、品質向上が期待できるといわれています。ただし、筆者自身もまだ試し始めた段階であり、複数のminiでどの程度品質が向上するかを定量的に語れるほどの経験はありません。それでも、この開発スタイルは今後スタンダードになっていく可能性が高いと感じています。

コミュニティーの声(Redditへの書き込みやYouTube動画での評価)を見ると、特にスピードに対する評価が高いようです。例えば、Web検索したデータをマークダウン形式で整理するようなタスクでは、フルモデルと同等の品質を保ちながら2倍以上の速度で出力されたという報告もあります。超小型の「nano」についても、単純なデータ分類などでは十分な精度を発揮するとの報告があり、定型タスクの大量処理に向いているといえます。

一方で不満の声もあります。例えば価格面で「GPT-5 mini」と比較すると、今回の「GPT-5.4 mini」は約3倍の値上げとなっているという指摘が見られました(詳細は後述)。

現時点での使い分けとしては、UI(ユーザーインタフェース)デザインや高度な思考が求められるフロントエンド開発には引き続きフラッグシップの「GPT-5.4」を使い、バックエンドのロジック構築やテスト、セキュリティ監査といった並列化しやすい作業には「mini」をサブエージェントとして投入するのが有効だと感じています。

さて、GPT-5.4 miniは、既にGitHub CopilotやCursorといった主要なAI開発ツールで利用可能となっている。また、開発者向けにはOpenRouterなどのAPIプロバイダー経由でも提供が始まっている。

先ほどひと言コメントで触れた価格差について、主なポイントを以下に整理しておく。

- GPT-5.4 mini

- 「GPT-5.4」に対する価格倍率

- 入力・キャッシュ入力・出力トークン: 約3分の1(約0.3倍)

- 「旧GPT-5 mini」に対する価格倍率

- 入力・キャッシュ入力: 3倍

- 出力トークン: 2.25倍

- 「GPT-5.4」に対する価格倍率

- GPT-5.4 nano

- 「GPT-5.4」に対する価格倍率

- 入力・キャッシュ入力: 約12.5分の1(約0.08倍)

- 出力トークン: 約12分の1(約0.083倍)

- 「GPT-5.4」に対する価格倍率

それでは、今回のリリースで追加された主な機能や仕様を整理しておく。

その他の特徴

モデルスペックと新機能

- 高速・低レイテンシ設計:【mini】小型モデルとして高速応答と効率性を重視して設計されており、軽量なタスクでは素早く結果を返せる

- サブエージェント用途への適性:【mini】軽量かつ十分な思考(リーズニング)性能を持ち、メインAIエージェントを補助するサブエージェント用途に適している

- 超低コストモデル「nano」:【nano】GPT-5.4 nanoはシリーズ中で最も高速かつ低コストなモデルで、分類・抽出・要約といった単純で定型的な処理に適している

- 思考プロセス(リーズニング)の制御:【mini/nano共通】reasoning_effortパラメーターにより思考の深さ(none/low/medium/highなど)を制御可能

- マルチモーダル対応:【mini/nano共通】画像入力に対応しており、スクリーンショットを用いた解析やデバッグ補助といった用途にも利用できる

- 40万トークンコンテキスト:【mini/nano共通】最大約40万(400K)トークンのコンテキストに対応し、大規模なコードや長文データの処理が可能

OpenAI APIの価格表(gpt-5.4-mini利用時)

- 100万トークン当たりの料金:

- 入力トークン: 0.75ドル

- 出力トークン: 4.50ドル

- プロンプトキャッシュ利用時の料金(100万トークン当たり):

- 入力トークン: 0.075ドル

- ※プロンプトキャッシュとは、指示文などの入力(プロンプト)をキャッシュして再利用する仕組み。キャッシュされた入力(Cached input)は再計算が不要なため、通常の入力より低コストで利用できる

OpenAI APIの価格表(gpt-5.4-nano利用時)

- 100万トークン当たりの料金:

- 入力トークン: 0.20ドル

- 出力トークン: 1.25ドル

- プロンプトキャッシュ利用時の料金(100万トークン当たり):

- 入力トークン: 0.02ドル

※価格は変更される可能性があるため、利用の際はOpenAI公式ドキュメント「API 料金」を必ず確認してほしい。

情報元

Copyright© Digital Advantage Corp. All Rights Reserved.