AIとの長い会話は逆効果?MIT論文が示した事実

AIに何度も「違う、そうじゃなくて」と言い直した経験はないだろうか。同じチャットで会話を重ねるほど、なぜか回答がズレていく。修正を頼んでも、さっきと同じ間違いを繰り返す。

気のせいだと思っていた。でも、気のせいではなかった。

論文が出た

MITとIBMの共同研究チームが、この問題を正面から検証している。

タイトルは"Do LLMs Benefit from Their Own Words?"。「LLMは自分自身の言葉から恩恵を受けているのか?」

AIチャットの仕組みとして、会話が続くと過去のやり取りが全部プロンプトに含まれる。自分の質問だけでなく、AIの過去の回答も丸ごと。20回やり取りした後の21回目には、過去の質問20個、AIの回答20個、そして新しい質問。これが一塊で送られている。

AIの回答は長い。だから会話が進むほど、コンテキストの大半はAIの過去の回答で埋まっていく。

本来5,000〜10,000文字で済むユーザー側の情報が、AIの回答履歴を含めると25,000〜55,000文字に膨れ上がる。最大10倍。研究チームはこの膨大な過去の回答が本当に必要なのかを問うた。

消しても変わらない

実際のユーザー会話データを使って、4つのモデルで比較実験をしている。「全履歴あり」と「AIの過去の回答を全部消した状態」。

AIの過去の回答を全て消しても、回答の品質が落ちないケースが大量にあった。モデルによっては、消した方が品質が上がった。

理由の一つは単純で、実際の会話の36.4%はそもそも前の文脈と関係がない。同じチャットの中で話題を変えたり、全く別のことを聞いたりするのは普通のことで、そのとき過去の履歴はただのノイズになる。

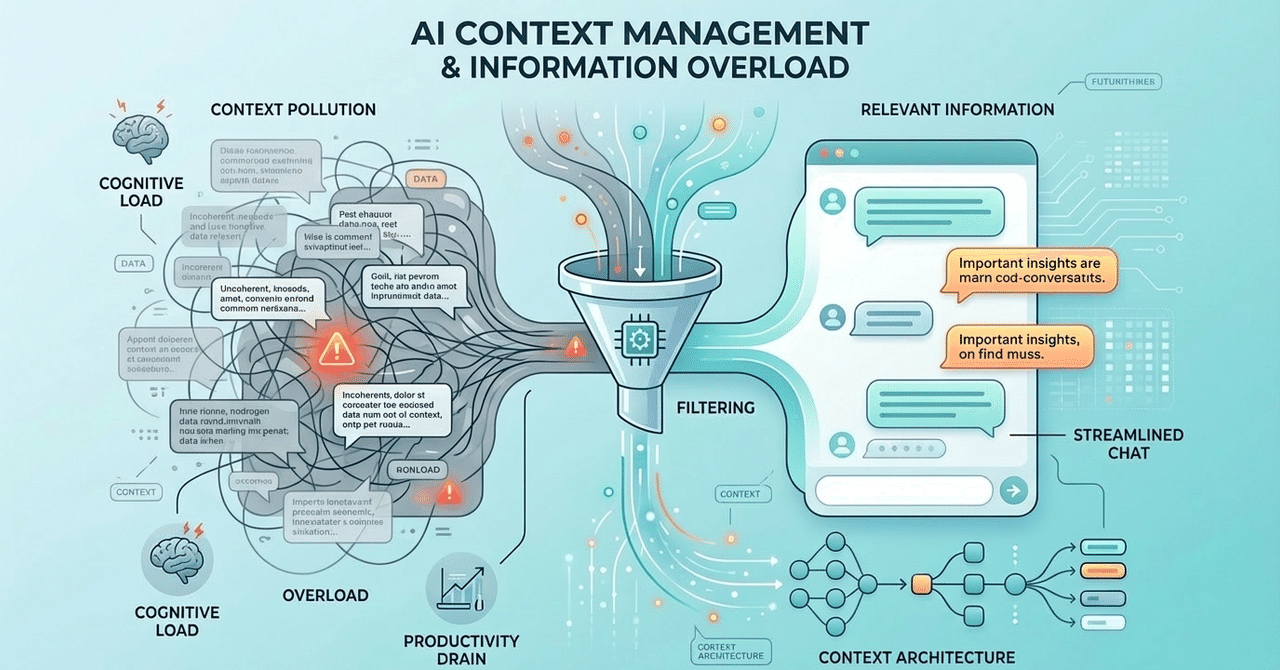

コンテキスト汚染

もっと厄介な問題がある。研究チームが「コンテキスト汚染(Context Pollution)」と呼んでいる現象。

AIが自分の過去の回答に引きずられて、誤りを次のターンに持ち込む。

論文の例がわかりやすい。あるユーザーがAIにUMAPという手法のコードを書かせた。その後「やっぱりt-SNEに変えて」と頼む。するとAIは、UMAP固有の設定であるJaccard距離をt-SNEにも持ち込んでしまい、バグのあるコードを出した。過去の履歴がない状態で同じ質問をすると、正しいコードが出る。

これが最新の最高性能モデル(GPT-5.2)でも起きている。モデルの性能が上がれば解決する類の問題ではない。むしろ賢いモデルほど過去の文脈を丁寧に拾おうとするから、そこに誤りがあると忠実に引きずられる。

圧縮すれば解決するのか

ChatGPTやClaudeには、会話が長くなると過去のやり取りを要約して圧縮する機能がある。これで問題は解消されるように見える。

されない。

圧縮は、コンテキストが上限に達しそうなときに初めて動く。それまではフルの履歴を抱えたまま走っている。そして要約すること自体が情報の取捨選択だから、必要な情報が落ちることもあれば、誤った情報が要約に残ることもある。コンテキスト汚染が要約の中に焼き込まれれば、圧縮後もそのまま引き継がれる。

チャットだけの問題ではない

この論文はClaude CodeやCursorといったコーディングエージェントの文脈管理にも言及している。

エージェント系のツールでは、会話の履歴に加えてツールの実行結果やファイルの中身、計画のメモなど、さらに多くの情報がコンテキストに積み上がっていく。チャット以上に文脈のゴミ処理が切実な領域で、各社がすでに対策を模索し始めている。Cursorは動的な文脈管理を導入し、Claude Codeはツール結果のクリアや文脈の編集機能を実装した。問題が認識され始めた段階にある。

粗い二択でも効果が出た

研究チームは分類器を作った。「この質問には過去の履歴が必要か」を予測して、不要なら省く。

フルコンテキストの95%以上の品質を保ちながら、コンテキスト消費を約30%削減。

この実験は「全部残すか全部消すか」の二択しかやっていない。特定のターンだけ選択的に残すような細かい制御はまだ試していない段階で、すでにこの差が出ている。

API利用ではトークン数がそのまま課金額になる。不要な履歴を送らないだけで、品質が上がってコストが下がる。大規模に運用している企業なら、コンテキスト消費が最大10分の1になるケースもあるという数字はかなりのインパクトになる。

新しいチャットを開く

今のところ、AIの側がこの取捨選択を自動でやってくれる仕組みはない。

だから今できる最善手はシンプルで、前の会話と関係ない質問をするなら、新しいチャットを開く。途中で方針を変えるなら、必要な情報だけ貼り直して新しいチャットにする。

「長く続けた方がAIは文脈を分かってくれる」。その直感は、少なくとも常には成り立たない。

コンテキストウィンドウは大きくなり続けている。でも大きければいいという話ではなかった。器の大きさより、中に何を入れるか。そちらの方がずっと効く。

読んでいただきありがとうございました。

コメント、記事購入、チップ等いつもありがとうございます。

大変感謝しております。

関連記事もありますので、下記サイトマップを参照していただければ幸いです。

いいなと思ったら応援しよう!

よろしければ応援お願いします!チップはnote更新用のPC購入費用に当てる予定です。よろしく!

よろしければ応援お願いします!チップはnote更新用のPC購入費用に当てる予定です。よろしく!