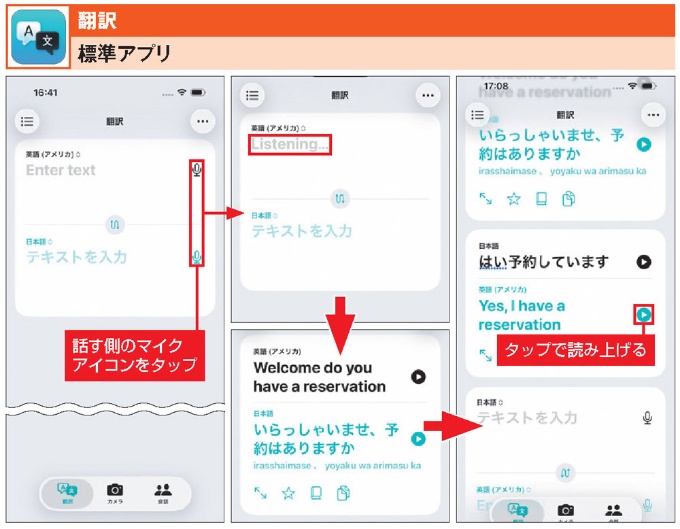

ライブ翻訳はApple Intelligenceの機能だが、対応していないiPhoneでも翻訳機能が全く使えないわけではない。その場合は、標準の「翻訳」アプリを活用するとよい(図1)。

このアプリはApple Intelligence非対応モデルでも利用でき、テキストや音声を入力して翻訳するなど、ユーザーが操作して使う機能を備えている。キーボード入力や音声入力、カメラで撮影した文字の翻訳などを通じて、翻訳結果を確認しながら意味を把握するといった辞書に近い使い方が基本になる。

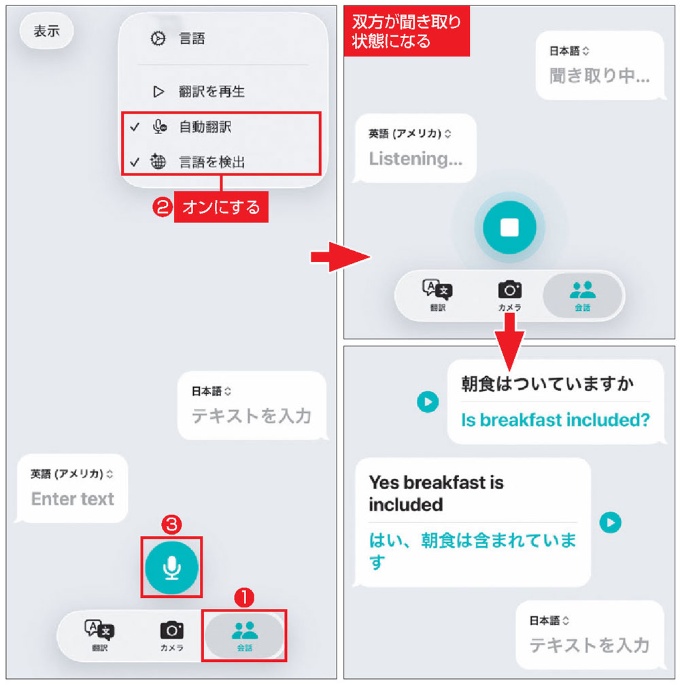

音声入力も可能で、人との会話にも使える。ただし、その場合は話す言語に対応したマイクアイコンをタップしてから発話する必要があり、やや手間は掛かる。こうした場面では、画面下部のメニューから「会話」を選ぶと、対話向けに最適化されたユーザーインタフェースに切り替わり、操作しやすくなる(図2)。

画面右上の「…」から「自動翻訳」「言語を検出」をオンにしておくと、マイクボタンをタップするだけで双方の言語が聞き取り状態になり、発話した側の言葉が自動的に翻訳される。順番に話す必要はあるものの、相手と横並びになってiPhoneの画面を見ながら会話する状況では、違和感なく使えるだろう。

画面左上の「表示」から「対面」に切り替えると、画面の上半分が逆さまになり、対面時に互いが自分側から内容を読めるレイアウトに変わる。会話の状況に応じて使い分けよう。

次のページ

ライブ翻訳にAirPodsを組み合わせると何がで...この記事は会員登録で続きをご覧いただけます