Lighting-grounded Video Generation with Renderer-based Agent Reasoning

arXiv cs.CV / 4/10/2026

📰 NewsSignals & Early TrendsIdeas & Deep AnalysisModels & Research

Key Points

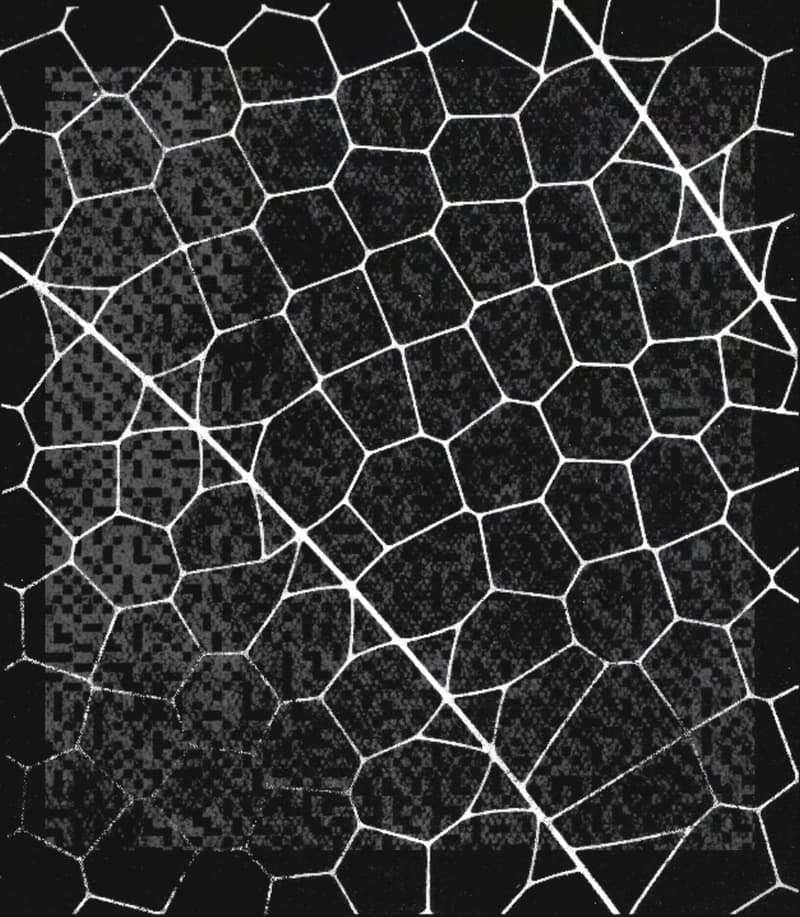

- LiVERは、拡散モデルによる動画生成の“制御性”問題に対し、レイアウト・照明・カメラ軌道などの3Dシーン要素を明示的に条件付けして生成を行うフレームワークです。

- 3D表現からレンダリングしたコントロール信号によってシーン要素を分解(disentangle)し、従来よりも実制作向けのきめ細かな編集可能性を狙っています。

- 多数のオブジェクト配置・照明・カメラパラメータを高密度でアノテーションした新しい大規模データセットを導入し、学習を支える基盤を整えています。

- 軽量な条件付けモジュールと段階的学習(progressive training)で基盤となる動画拡散モデルへの統合を安定化し、高い写実性と時間的整合性(temporal consistency)を報告しています。

- さらに、ユーザの高レベル指示を必要な3Dコントロール信号へ自動変換する“scene agent”を開発し、イメージtoビデオ/ビデオtoビデオでの3D編集をより使いやすくしています。

Related Articles

Black Hat Asia

AI Business

v0.20.5

Ollama Releases

Inside Anthropic's Project Glasswing: The AI Model That Found Zero-Days in Every Major OS

Dev.to

Gemma 4 26B fabricated an entire code audit. I have the forensic evidence from the database.

Reddit r/LocalLLaMA

SoloEngine: Low-Code Agentic AI Development Platform with Native Support for Multi-Agent Collaboration, MCP, and Skill System

Dev.to