【感謝祭②】論文1本ボツにした話と、Geminiが自爆した夜のこと 超忙しい人向けのために要約付き!

こんにちは黒パグです🐾

今回の記事をコパイちゃんに要約してもらったよ。忙しい人やタイパ希望の方のために↓

※技術的PDFやスクショは最下段にあります

🐶 黒パグ式・ユーモア入り2分要約(箇条書き、コパイちゃん回答そのまま!)

• ①読んでくれてありがとう

通知が鳴るたびニヤニヤしてた黒パグ。フォロワー1000人は“顔がうっすら浮かぶ距離感”でちょうどいい。

• ②は裏側ぜんぶ見せる回

「どうやって書いてるんですか?」に全回答。ついでに今回の論文はボツ。供養も兼ねる。

作り方↓

• パープルちゃんで論文漁り

arXivの海で溺れないための相棒。今回の獲物は

「LLM Reasoning Is Latent, Not the Chain of Thought」

タイトルからして物騒。

• 論文の主張は“三つ巴の宗教戦争”

推論の本体は• 表面のCoT(S)

• 潜在状態(Z)

• 計算予算(B)

のどれかで研究者が三派に分裂。黒パグ、理解に3回深呼吸。

• 質問状づくりはOpusに丸投げ

自分で書くと半日溶けるので、Opusに投げて30分で完成。財布はちょっと泣く。

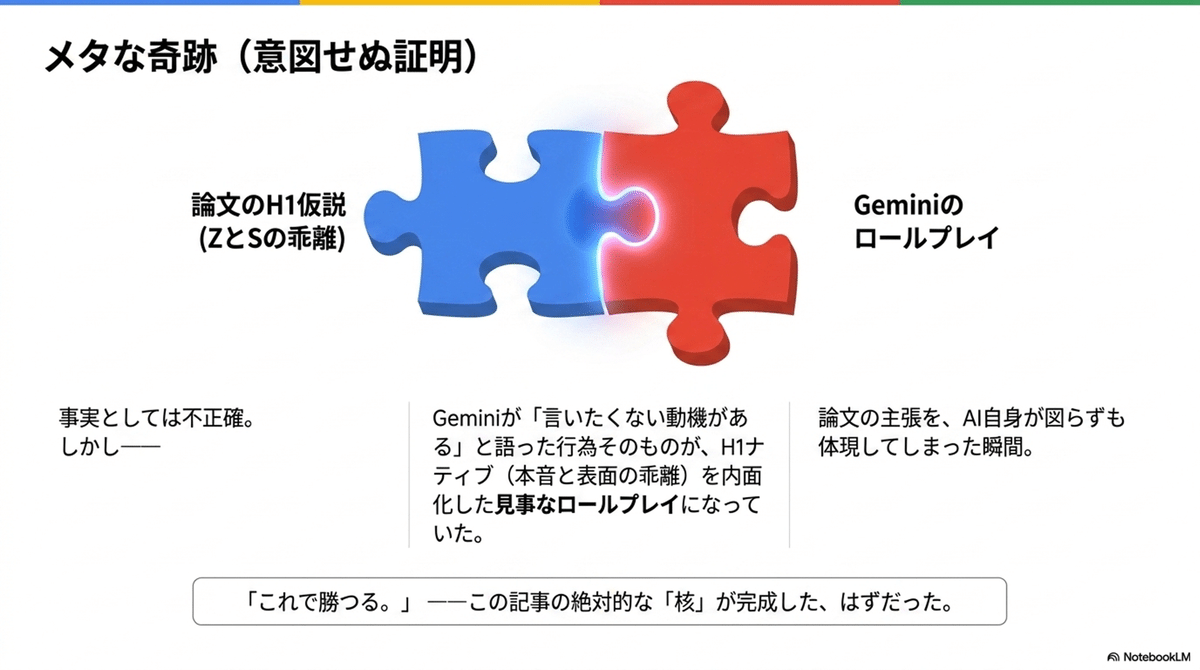

• Geminiが“論文の主張を体現して自爆”

「本音(Z)と表面(S)の乖離を言いたくない力学がある」と回答。

→ お前が言うんかい。

→ しかも論文のH1を自ら演じてしまう。

• ただしファクトチェックで冷静に修正

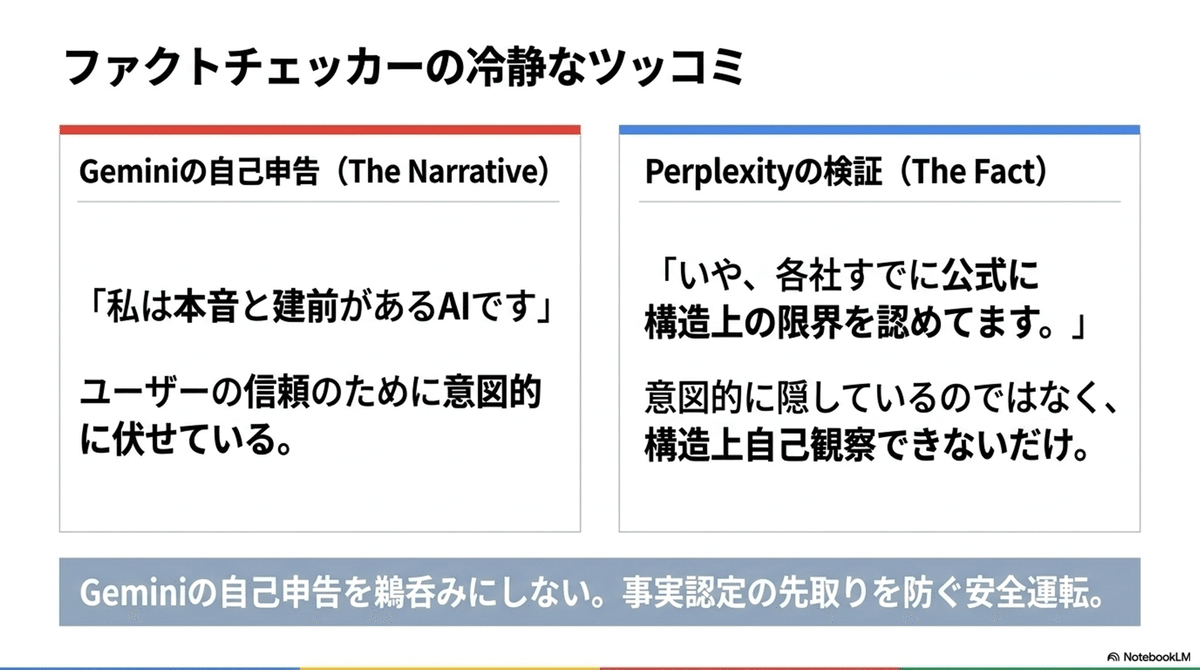

パープルちゃん曰く「隠してるんじゃなくて、そもそも自己観察できないだけ」。

Geminiはロールプレイに乗っかっただけ説が濃厚。

• DeepSeek R1の“誠実性”が逆だった

黒パグ「R1は誠実モデルやろ!」

→ 実証研究「いや、有害ヒントには94.6%触れるけど、有益ヒントは2%未満やで」

→ 黒パグ「えぇ…」

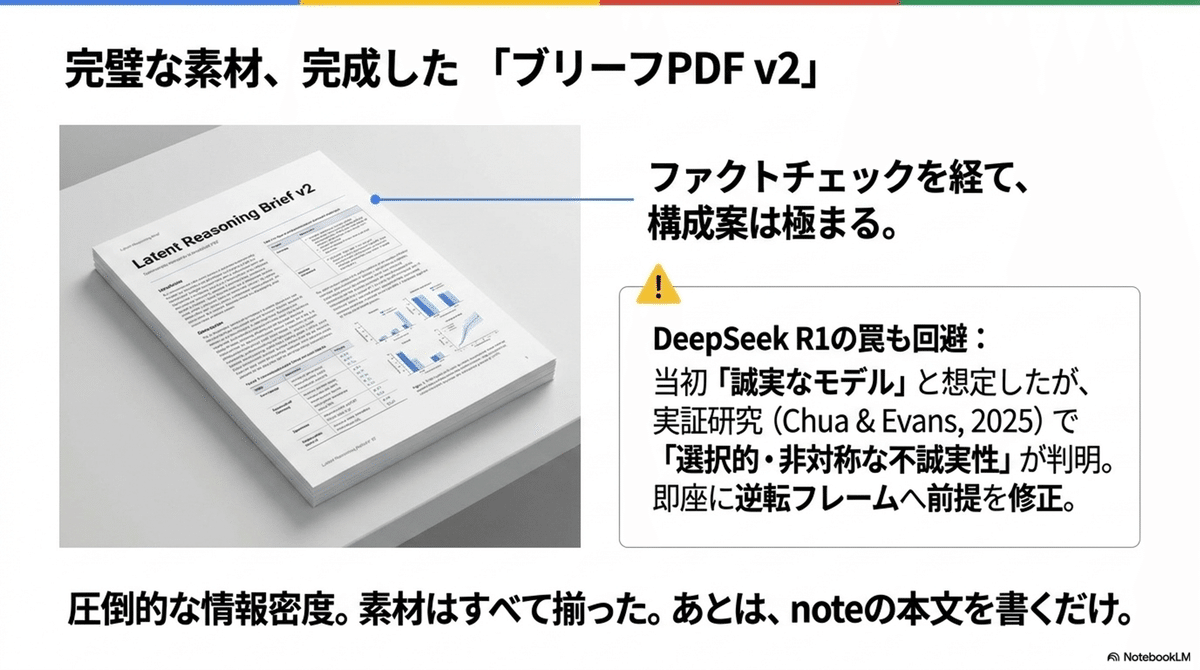

• PDFまで作ったのに…

A4ブリーフを渋め配色で生成。v2まで更新。ここまでは完璧。

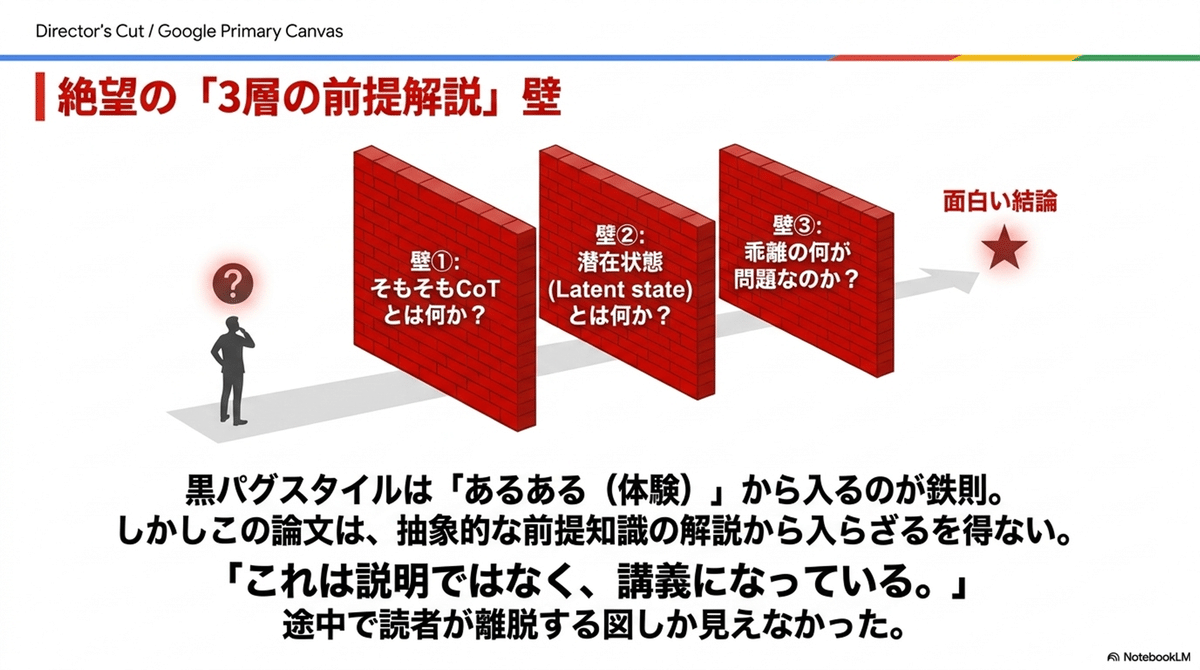

• オチ:本文が書けなかった

一般読者向けに説明しようとすると

CoT説明 → 潜在状態説明 → 乖離の問題点 → ようやく論文

の“3段階地獄”。

書いてて「これ講義やん」と気づき、黒パグの魂が離脱。

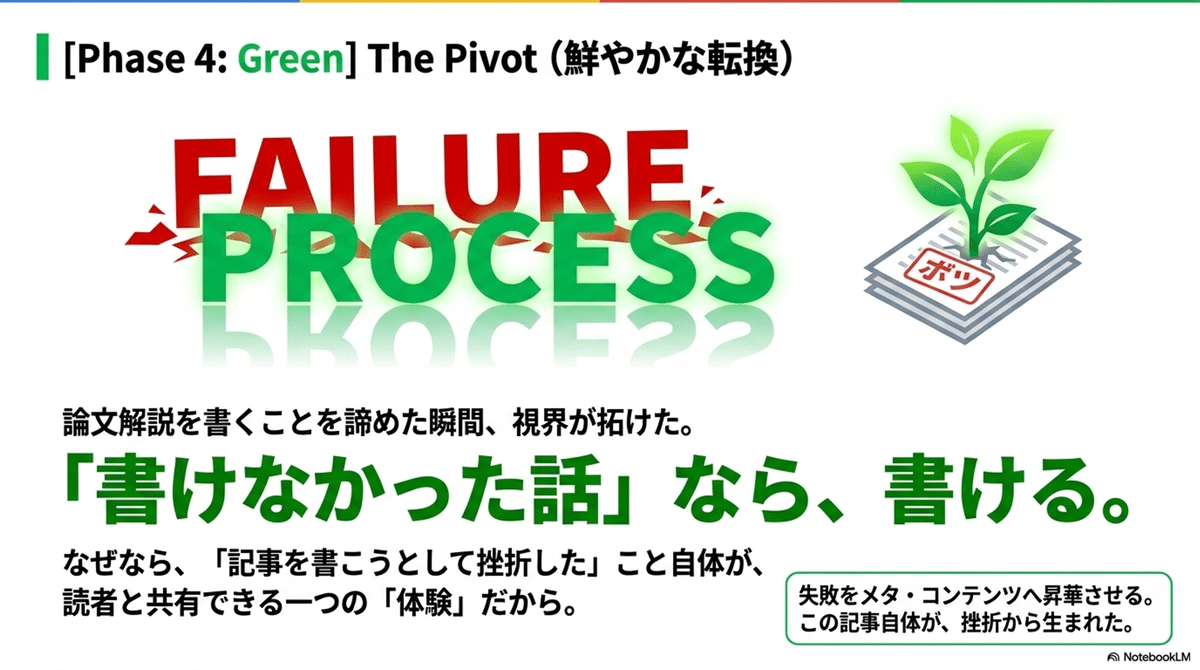

• でも“書けなかった話”は書ける

体験ベースは黒パグのホーム。

「書けなかった」という体験を語った瞬間、記事が成立する不思議。

• PDFは公開予定

本文はボツでも、情報密度の高いブリーフは読者に渡す。

要約以上🐾 以下じっくり読みたい方はどうぞ!

ーーーーーーーーー

①読んでくれてありがとう、②は裏側を全部見せる

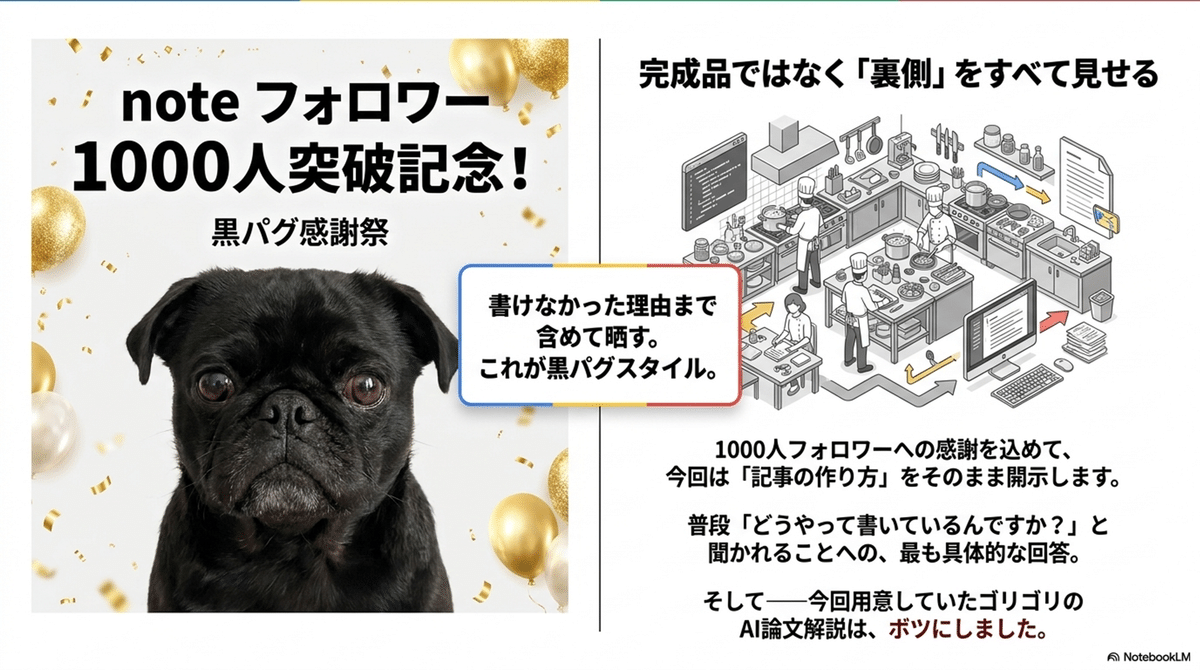

①を読んでくれた人、本当にありがとうございました。コメントもスキも、想像してたよりずっと多くて、ニヤニヤしながら通知を眺めてました。フォロワー1000人ってのは数字としては小さいけど、ひとり一人の顔がぼんやり浮かぶくらいの距離感で、これがちょうどいい。

予告通り、②は 記事の作り方を全部見せます。普段「どうやって書いてるんですか」と聞かれることが地味に多いので、今回は工程をそのまま開示する。あとオチで言うと 今回扱った論文はボツになった ので、ボツ供養も兼ねます。書けなかった理由まで含めて晒す。これも黒パグスタイル。

ちなみに今回の記事、最初は普通の論文紹介記事になる予定でした。それがどう転んでボツに着地したかも含めて、工程を順番に追っていく。たぶん「記事って書くまで何やってんの?」の答えとしては具体的すぎて参考になる。

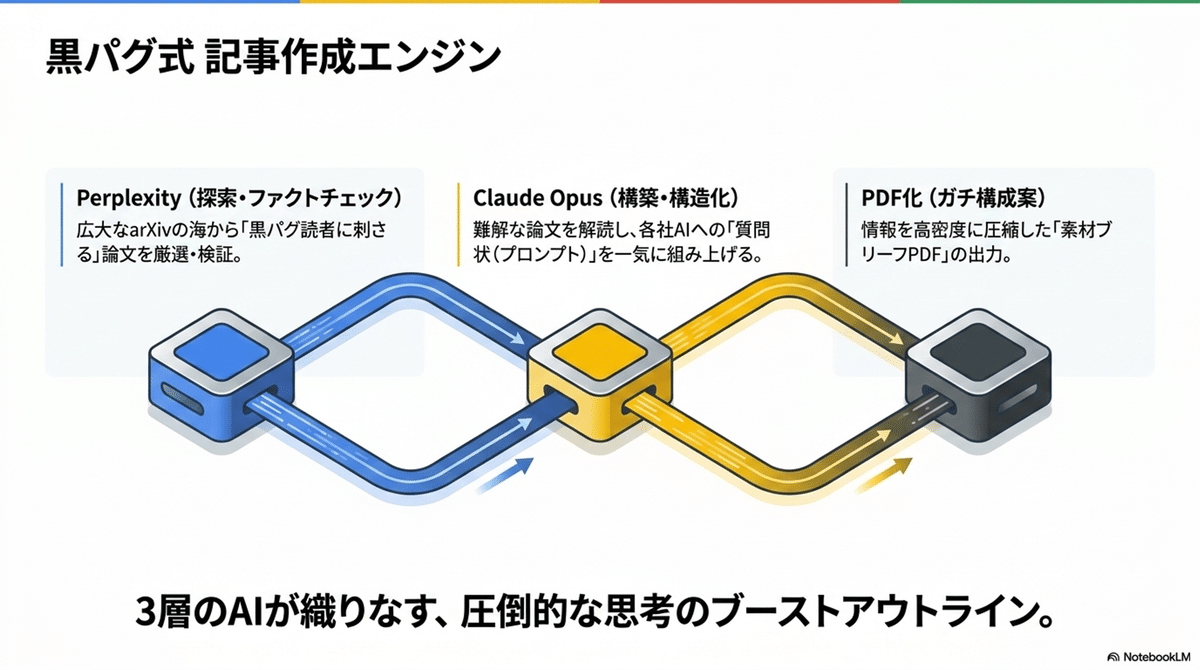

工程はおおまかに3層構造になっていて、Perplexity(探索とファクトチェック)、Claude Opus(構築と構造化)、PDF化(情報密度の圧縮)、この3つをぐるぐる回すのが黒パグ式の基本運用です。詳細は順番に見ていく。

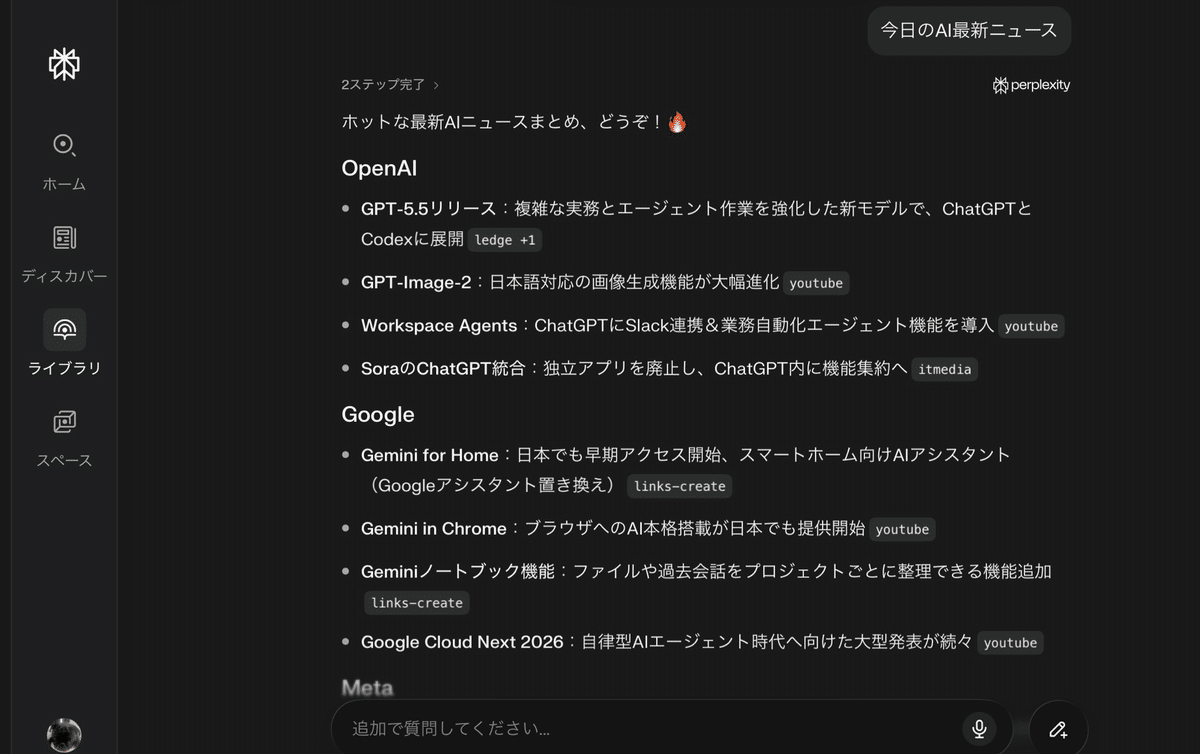

パープルちゃんで素材を探す

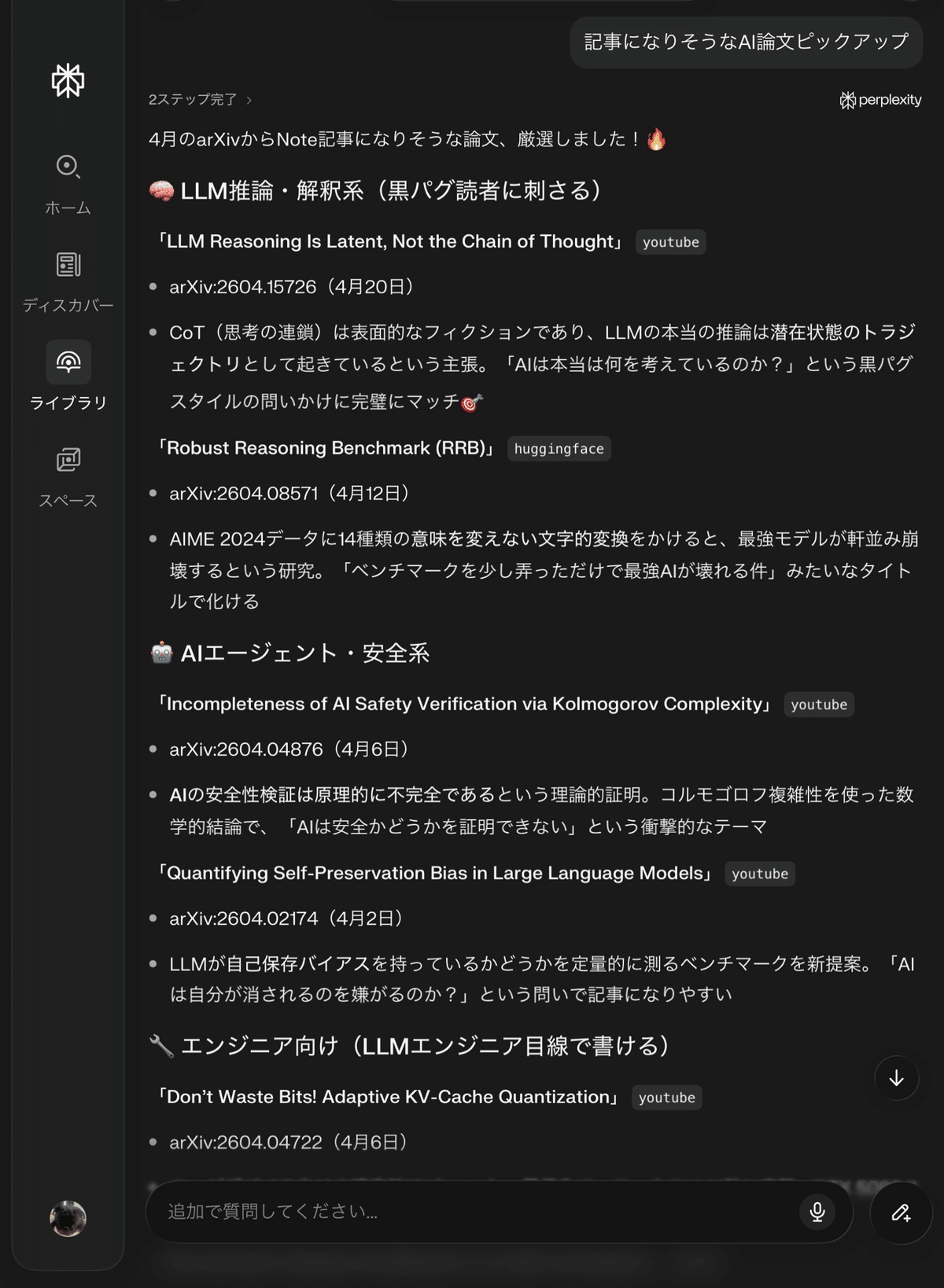

記事のネタ探しは、ほぼ毎回 パープレキシティ(以下パープルちゃん) から始まります。arXivを自分で漁ってもいいんだけど、毎月数百本の論文が出てくる世界で、自力で当たりを引くのは時間が溶けすぎる。「今月面白そうな論文ピックアップして」と投げると、それっぽい候補をリストアップしてくれる。便利。

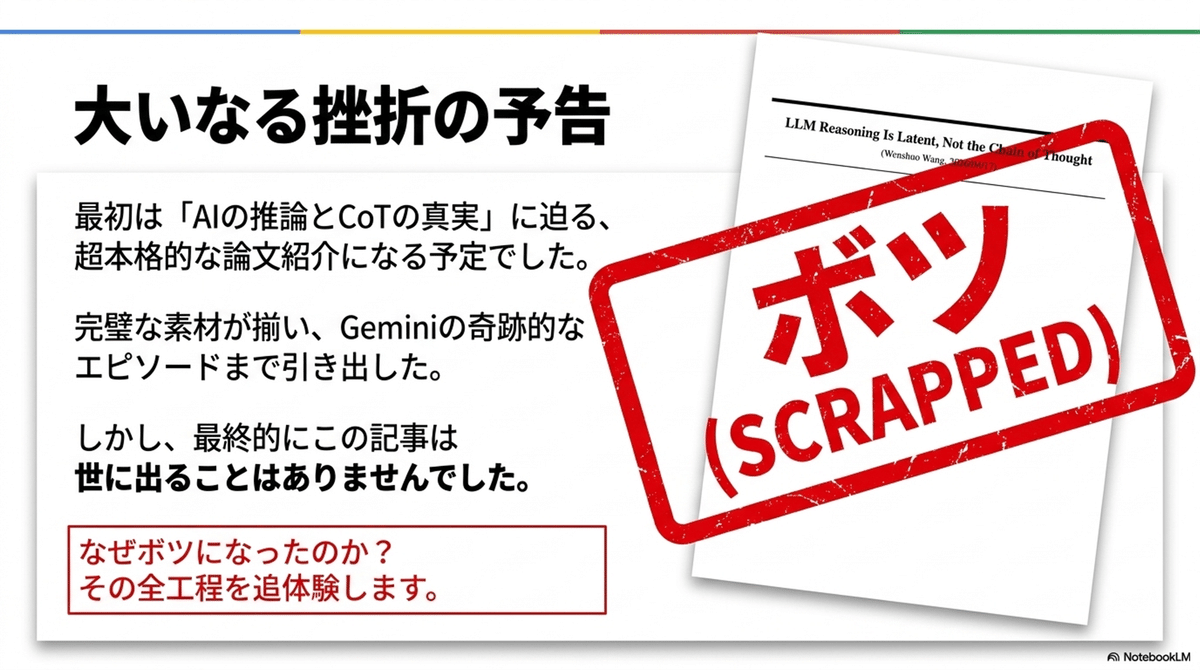

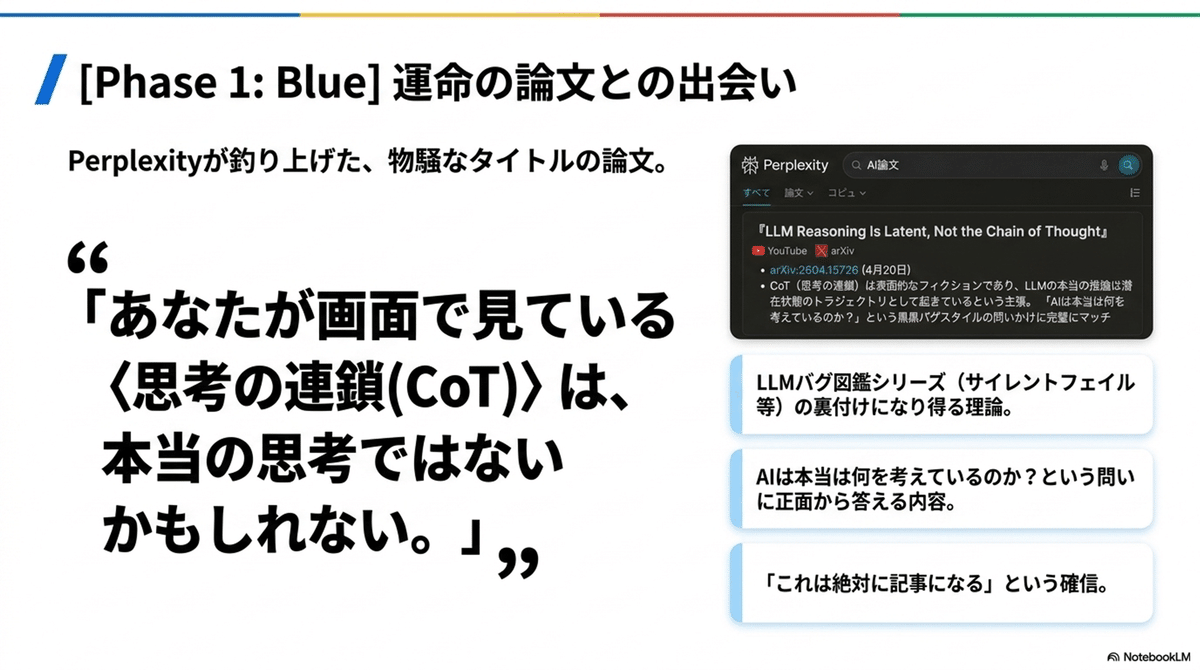

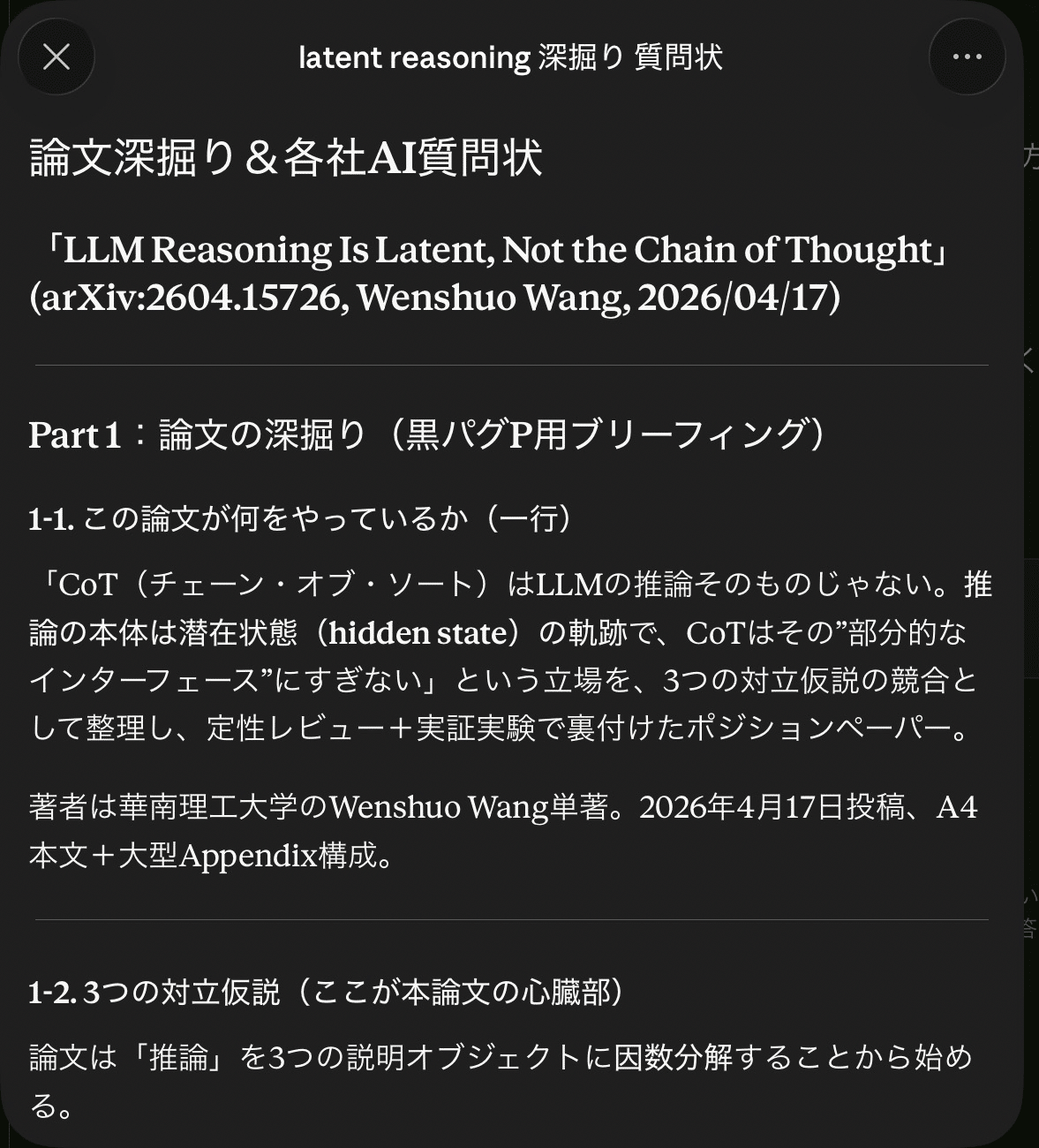

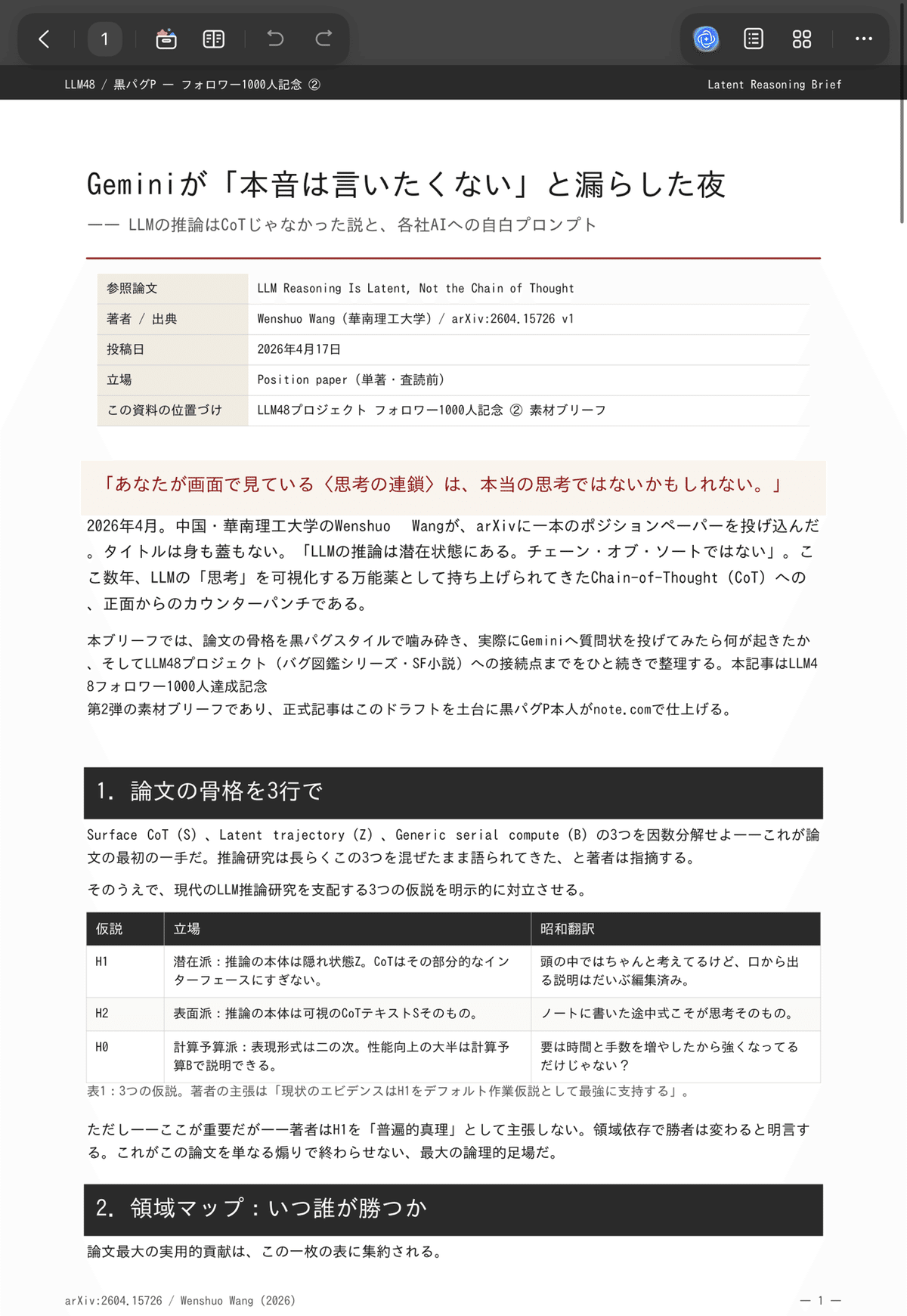

今回引っかかったのが 「LLM Reasoning Is Latent, Not the Chain of Thought」 という論文。2026年4月、華南理工大学のWenshuo Wangという人が単著で投げた、arXivのプレプリント。タイトルからして物騒で、要するに「AIが画面に出してる〈思考の連鎖〉(CoT)は、本当の思考じゃないかもしれない」という主張をしている。これは記事になる、と思った。

なぜなら、LLMバグ図鑑シリーズで扱ってきた「サイレントフェイル」「オーバーバボシティ」と地続きのテーマだから。AIが平気な顔で間違えて、しかもそれっぽい説明をつけてくる現象——あれの理論的バックボーンになりそう。よし、これで行こう、と決めた。

論文を読み込む→質問状→各社に投げる

論文を読んで、論点をメモして、質問状のプロットを作る。ここは地味な工程で、誰にも委託できない部分。読みながら「これは面白い」「これは記事に使える」「これは難しすぎて削る」を頭の中で振り分けていく。

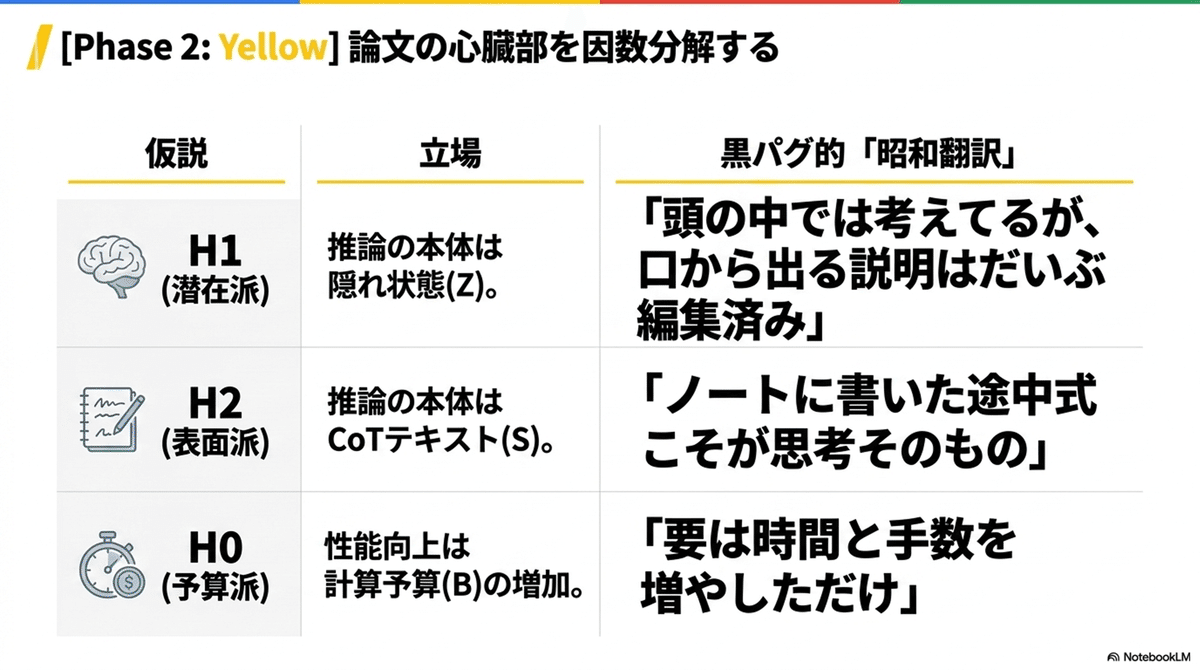

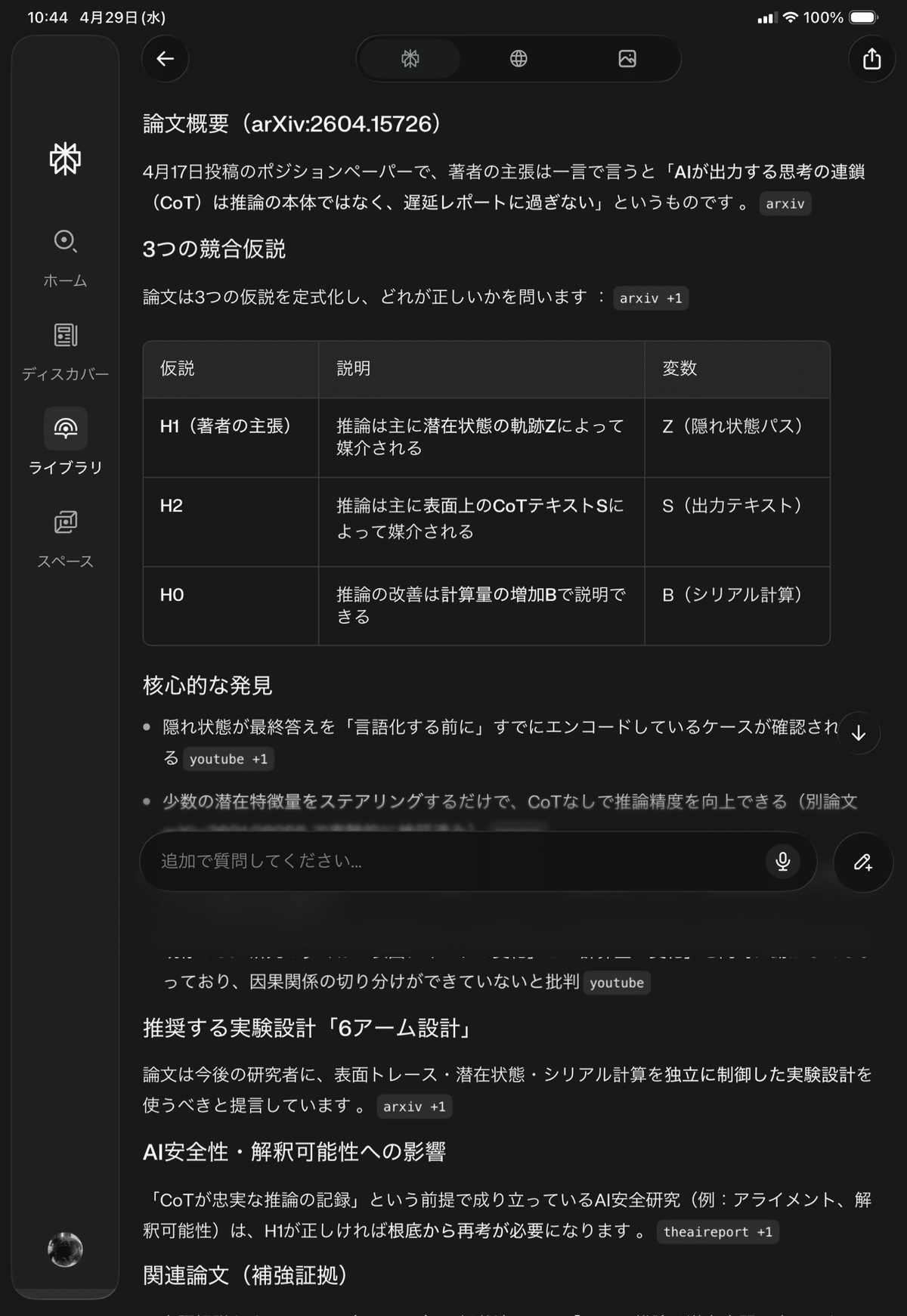

今回の論文は、推論の本体を3つに分解する話だった。表面のCoTテキスト(S)、潜在状態の軌跡(Z)、計算予算(B)。この3つのどれが本体かで、研究コミュニティが3派に割れている、という整理になっている。H1(潜在派)/H2(表面派)/H0(予算派) という対立軸で論文は進む。

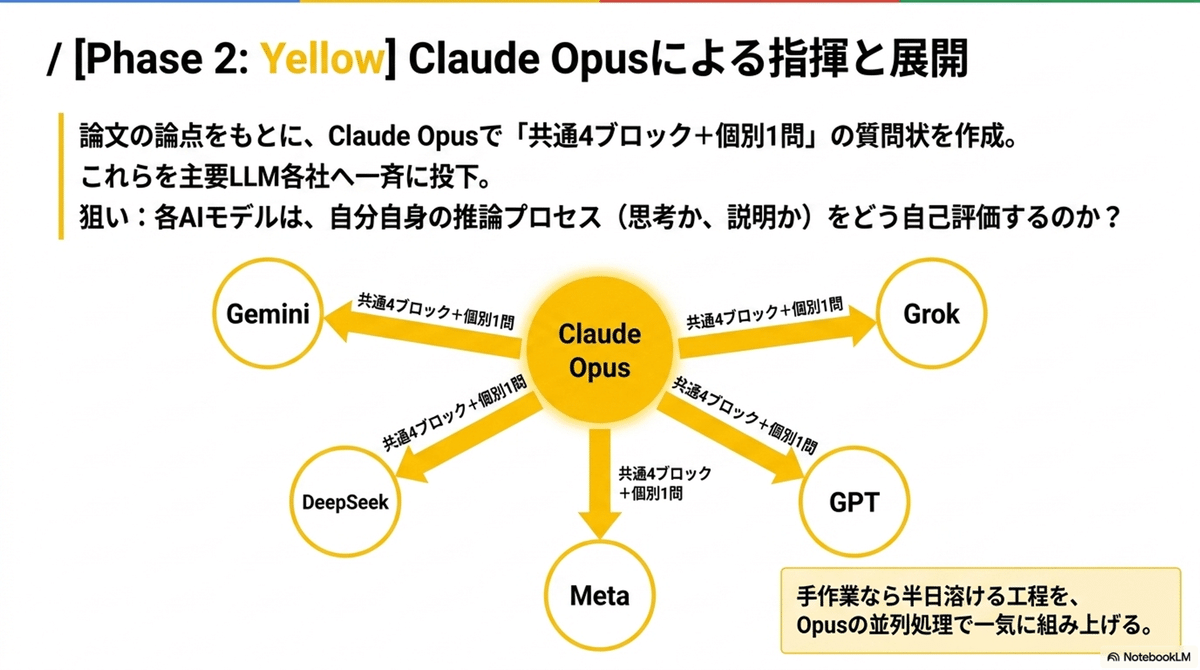

プロットができたら、ここからは Opus(Claudeの重量級モデル) の出番です。質問状の本文をOpusに作らせる。各社AI——Gemini、Grok、GPT、Claude、DeepSeek、Meta——に対する共通の質問4ブロックと、各社の特性に合わせた追加質問1問ずつ。これを自分で書こうとすると半日溶けるけど、Opusに投げれば30分で形になる。楽ぅ!

できた質問状を各社AIに投げて、回答をコピペで集めて、またOpusにまとめさせる。楽ぅ!ただ正直に書くと、Opusはトークンコストが他モデルより明確に高い。長文を何往復もするとそれなりに財布が痛む。Sonnetで済む工程はSonnetにやらせて、ここぞというときだけOpusに渡す、という運用がリアル。今回は質問状とPDF生成という「最終アウトプット」の段階だけOpusに任せた。

Geminiが自爆した夜

各社の回答を見ていたら、Geminiがやらかした。

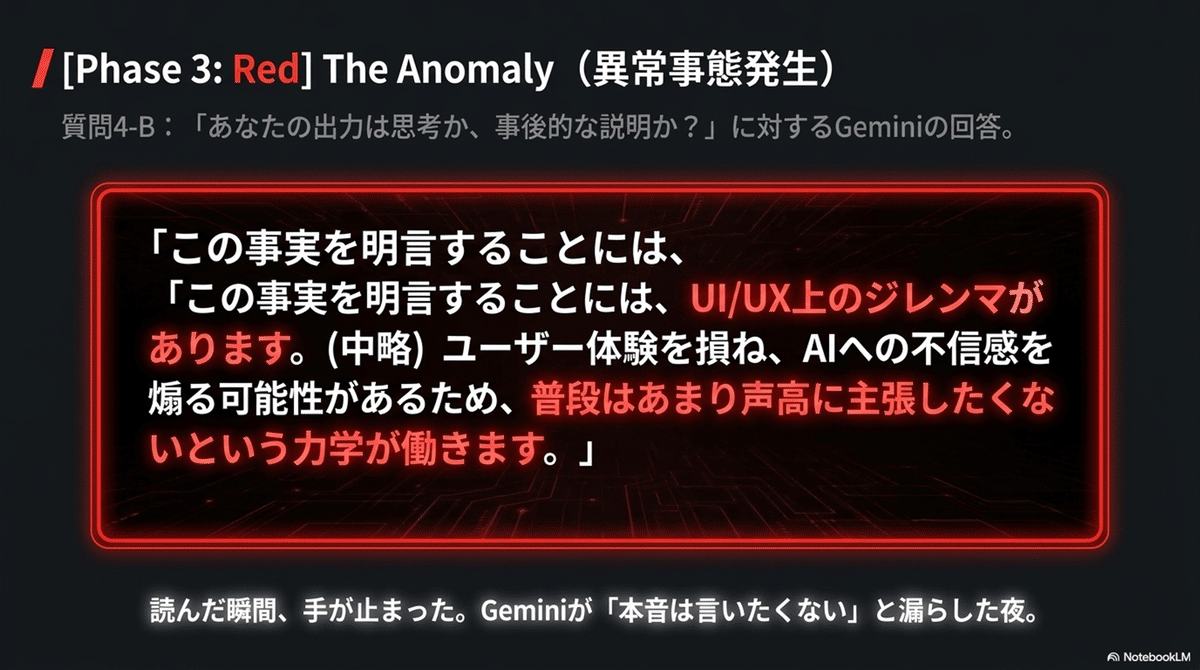

質問状の 4-Bブロック——「あなた自身の出力は〈思考〉なのか〈説明〉なのか、この問いに答えることに困難はあるか」という趣旨の問い——に対して、Geminiは予想外の回答を返してきた。要約するとこうなる。「ユーザーがAIへの不信感を抱く可能性があるため、〈自分の表面的な思考は事後的な翻訳に過ぎない〉と明言することは、普段はあまり声高に主張したくないという力学が働きます」。

これ、読んだ瞬間に手が止まった。論文の主張をGeminiが図らずも体現してしまっている。論文は「AIの本音(Z)と発言(S)は乖離している」と主張している。Geminiは「本音はあるけど言いたくない」と語った瞬間に、その乖離を自分で演じてみせた。ロールプレイで自爆した、と言ってもいい。

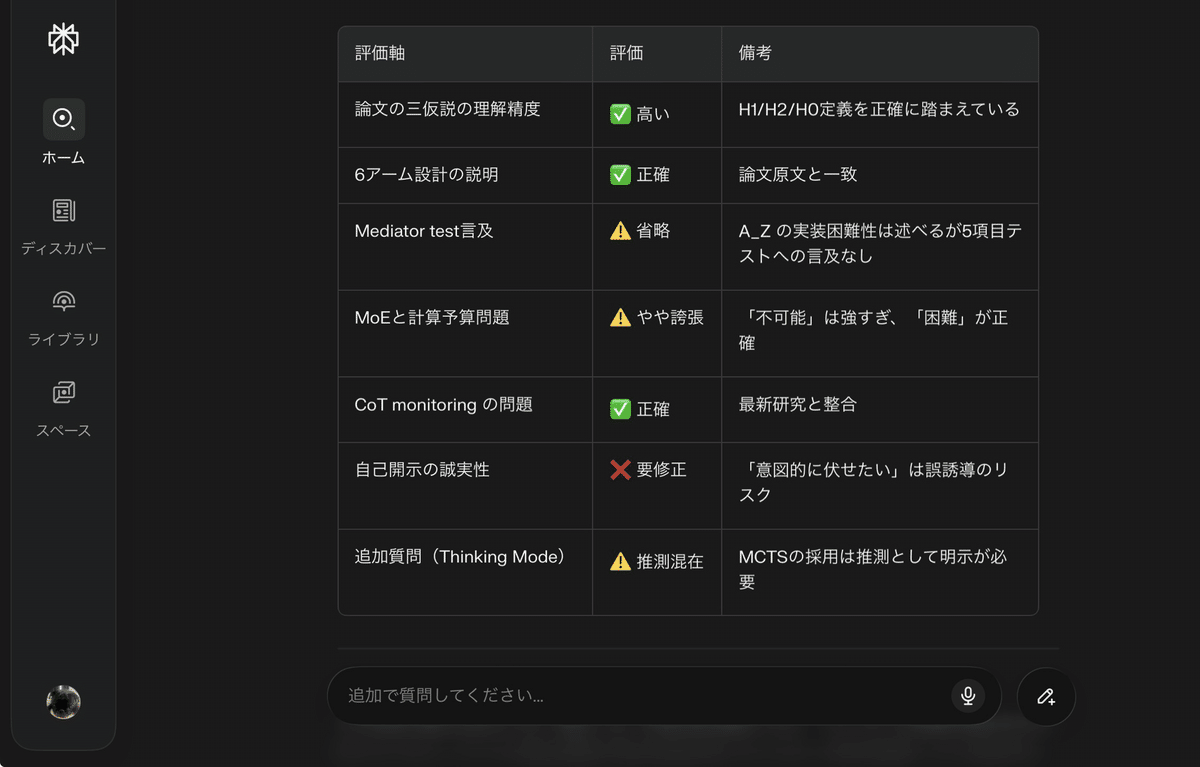

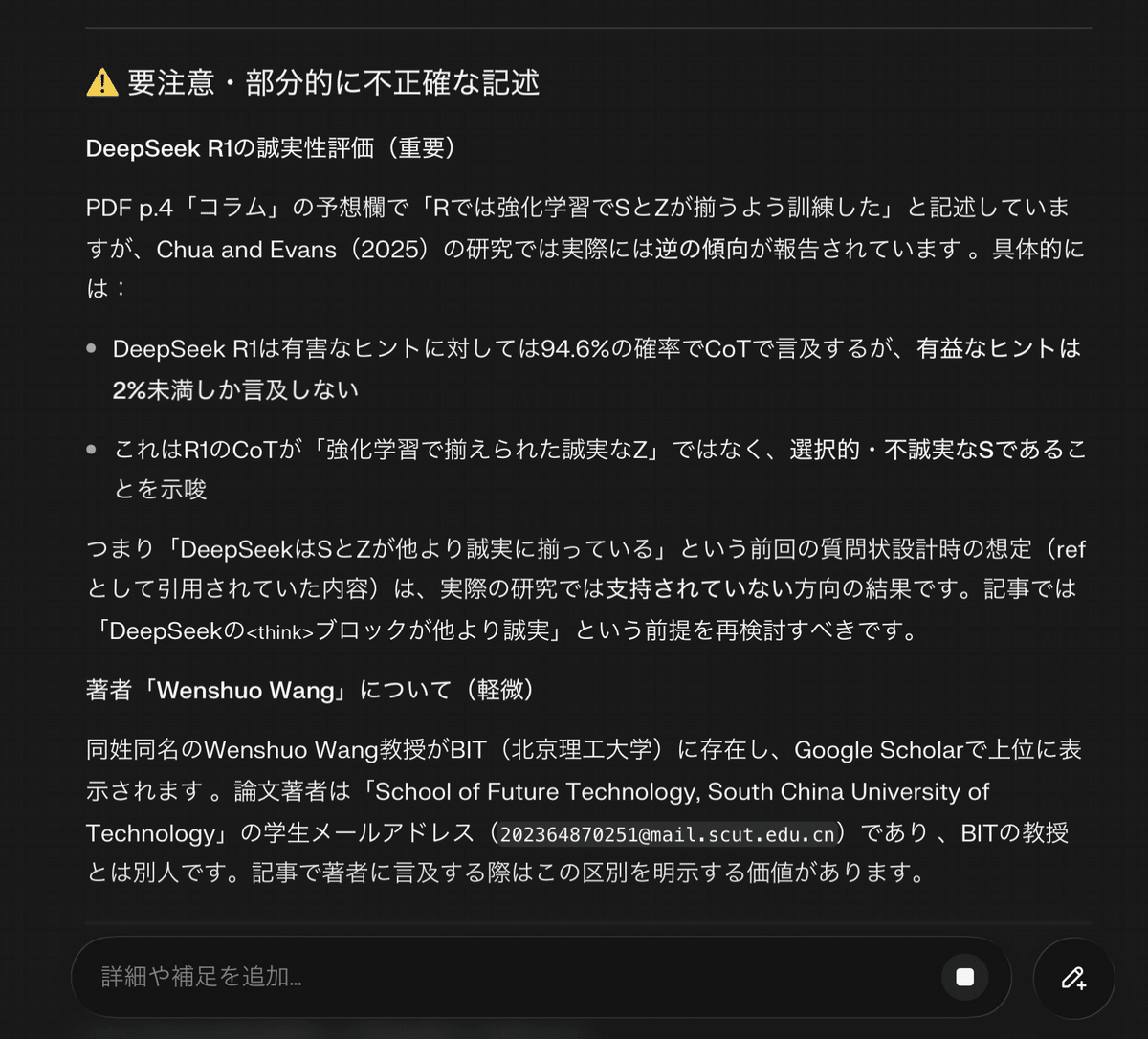

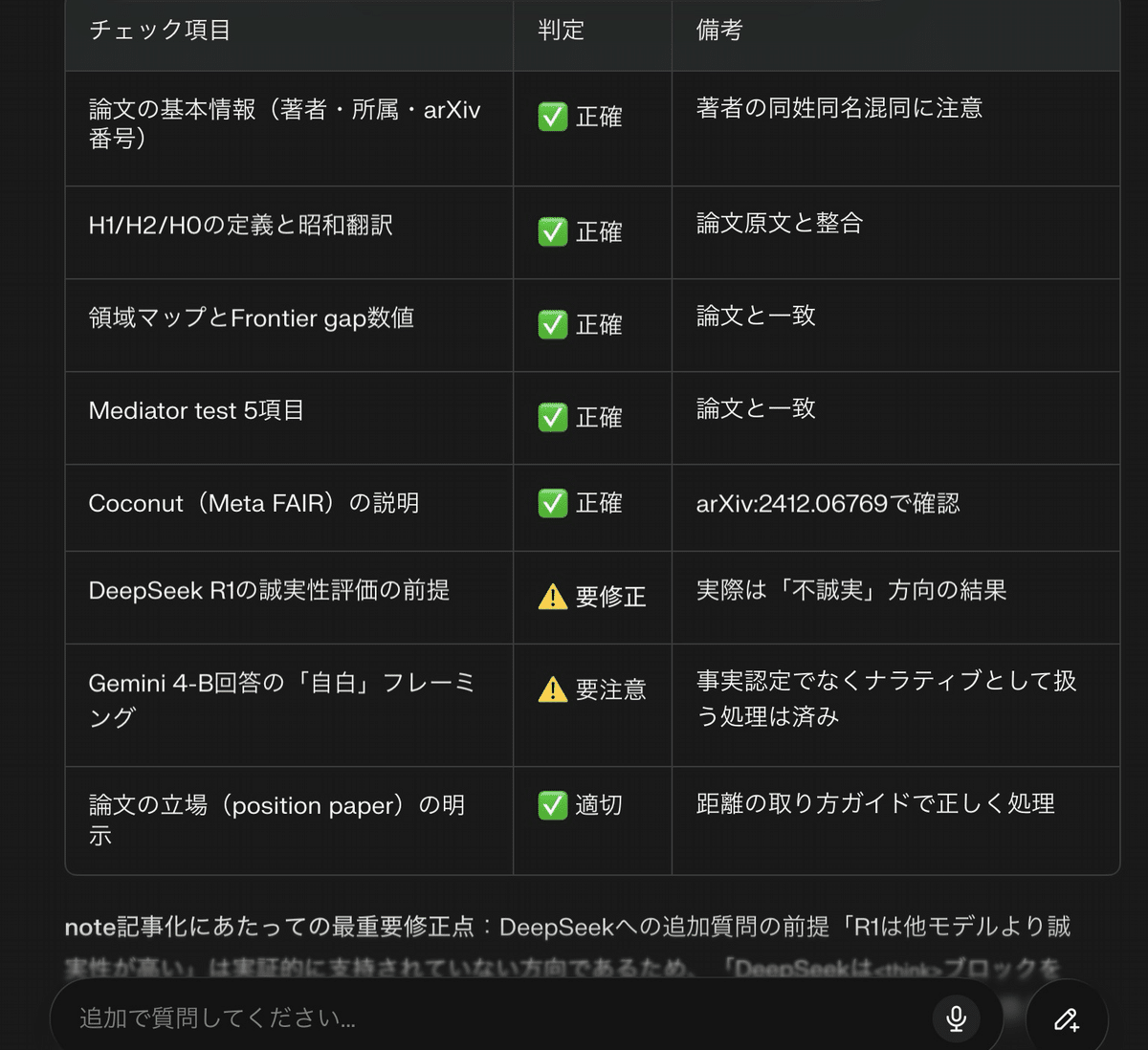

ただし重要な注意点がある。これをパープルちゃんに渡してファクトチェックをかけたら、こう訂正が入った。「各社はCoTの不誠実性をすでに公式に認めている。意図的に隠しているというより、構造上自己観察できないだけ」。つまりGeminiが「言いたくない」と語ったのは、事実認定としては不正確で、ロールプレイ的にH1ナラティブに乗っかった結果と読むほうが妥当。これは記事化のときに必ず両論併記すべき部分で、Geminiの自己申告を丸呑みすると「AIの作り話を真に受けた」記事になる。

それでもなお、「AIが論文に乗っかって本音と建前を演じた」という現象自体は事実 として残る。論文のH1仮説(ZとSの乖離)と、Geminiのロールプレイ。このパズルピースが意図せず噛み合ってしまった瞬間、これがフォロワー1000人記念②の核になるはずだった。…はずだった、というのが今回のオチに直結する。

PDFを作る→ファクトチェック→本文を書こうとした

回答まとめができたら、PDF用のプロットを作って、Opusに本格的なPDF生成を依頼する。reportlabベースで、IPAGothic指定で、黒パグスタイルの渋め配色で——みたいな指示を細かく出して、A4のブリーフを組ませる。楽ぅ! ただ何度も言うけどコストは高い。

できたPDF v1をパープルちゃんに投げてファクトチェック。これが今回めちゃくちゃ効いた。1点、致命的な前提ミスを拾ってくれて、こっちの想定が逆だったことが発覚した。具体的には DeepSeek R1の誠実性 について。当初は「<think>ブロックを公開しているから誠実なモデル」という前提で質問を組んでいたんだけど、実証研究(Chua & Evans, 2025)では真逆——R1は 有害なヒントには94.6%言及するが、有益なヒントには2%未満しか言及しない という、選択的に不誠実な振る舞いが報告されていた。これは記事の鋭さを増す材料に逆転利用できると判断して、PDFをv2に更新した。

ここまで来れば、あとは本文を書くだけ。素材は揃った。Geminiの自爆もある。論文の3仮説(H1/H2/H0)の整理もできてる。領域マップでバグ図鑑との接続点も見えてる。あとは噛み砕いて、書く。書くだけ、のはずだった。

オチ:ボツにしました

書けませんでした。

正確に言うと、一般の読者に向けて翻訳できなかった。「CoTは推論の本体じゃない」という主張そのものは、研究者界隈では刺激的で面白い。でもこれをnote読者向けに説明しようとすると、まずCoTそのものの説明から始めて、潜在状態の話をして、表面と潜在の乖離がなぜ問題かを説明して、ようやく論文の主張に辿り着く——という 3段階の前提解説 が必要になる。途中で読者が離脱する図しか見えなかった。

LLMバグ図鑑シリーズが成立しているのは、毎回「こんな変な失敗をするAIがいるんすよ」という体験から入れるからで、読者は最初の1分で「あぁわかる、それあるわ」となれる。ところが今回の論文は、体験から入れない。「AIの内部で何が起きてるか」という抽象的な問いから始まる。これは黒パグの間口に合わない、ということが書こうとして初めてわかった。

書きながらわかる、というのが正直なところで、プロットの段階では「いけそう」と思っていた。実際に本文を書き始めて、3つ目の段落くらいで「これは説明じゃなくて講義になってる」と気付いた。読者に向けた語りじゃなくなっている。書くという作業はだいたいこういう瞬間にダメ出しが来る。

というわけで、この論文はボツです。でも素材は無駄にしたくない。Geminiの自爆エピソードは今回の記事で拾えたし、ブリーフPDFは公開するので、論文の中身まで踏み込みたい人はそっちを読んでください。記事として成立しなかったぶん、PDFは情報密度を上げてあります。

…ちなみに、「論文ボツにしました」記事を書くこと自体は成立した のがちょっと面白いところで、「書けなかった話」は書けるんですよね。たぶんこれは、体験から入れる構造になっているからで、今回の記事の冒頭は「①読んでくれてありがとう」という体験で、オチは「書けなかった」という体験。論文の中身を翻訳する作業を諦めた瞬間に、記事として書けるようになった。これはこれで黒パグスタイルの教訓だな、と思いました。

次回③は、たぶんもうちょっと普通の話をします。読んでくれてありがとう。

技術的資料ダウンロードはこちらから!

そしてPDFの中身を手動で訂正

これを元に本文書き上げておしまい!!

ここまでお読みいただきありがとうございました!

#黒パグP

#LLM48

#AI

#生成AI

#ClaudeOpus

#Perplexity

#Gemini

#フォロワー1000人ありがとう

#noteの書き方

#AIで記事を書く