DeepSeek ローカル実行完全ガイド2026 — Ollama・LM Studio・vLLMで自分のPCに導入

Zenn / 4/28/2026

💬 OpinionDeveloper Stack & InfrastructureTools & Practical Usage

Key Points

- 2026年版として、DeepSeek系モデルを自分のPCでローカル実行する手順を、Ollama・LM Studio・vLLMの各ルートで案内する実践ガイドです。

- ツールごとの導入・設定の違いを押さえ、環境に応じて最適な実行基盤を選べるように整理されています。

- ローカル推論に必要な運用観点(モデル実行、構成、利用開始までの流れ)を手順化しているため、環境構築のハードルを下げます。

- 生成AIを外部サービスに依存せず手元で動かす選択肢を具体化し、開発・検証の自由度とコスト/制御面でのメリットを後押しします。

DeepSeekのモデルはMITライセンスでオープンソース公開されています。自分のPCやサーバーで動かせば、APIキーなし・月額費用なし・データは自分のマシンの中だけ。

本記事では3つの方法を解説します。

どのモデルを選ぶか

モデル

パラメータ

必要VRAM(Q4量子化)

おすすめ用途

R1 Distill 7B

7B

約5GB

RTX 3060・M2 Pro以上

R1 Distill 14B

14B

約10GB

RTX 3090・M2 Max以上 ⭐

R1 Distill 32B

32B

約22GB

RTX 4090・A100以上

V3 / V4(フル)

...

Continue reading this article on the original site.

Read original →Related Articles

Black Hat USA

AI Business

Write a 1,200-word blog post: "What is Generative Engine Optimization (GEO) and why SEO teams need it now"

Dev.to

Remove Background from Image Free (No Signup): The Practical Guide

Dev.to

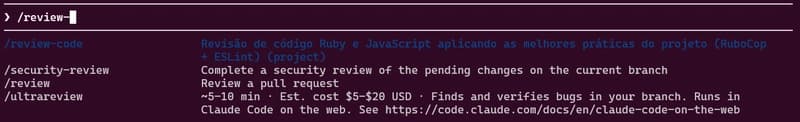

how to use skills from Claude Code A.K.A Claudinho.

Dev.to

Indian Developers: How to Build AI Side Income with $0 Capital in 2026

Dev.to