MiniRAG: エッジデバイス×SLMのための「超軽量」GraphRAGの正体

Zenn / 5/2/2026

💬 OpinionIdeas & Deep AnalysisModels & Research

Key Points

- MiniRAGは、GraphRAGの考え方を「超軽量」に再設計し、エッジデバイス上でもSLM(小型言語モデル)で動かせることを狙った構成だと説明している。

- ふつうのGraphRAGが持ちがちな計算・メモリ負荷を抑えるために、グラフ参照や検索の扱いを絞り込む方針が示されている。

- エッジ環境という制約下での実運用(レイテンシ、資源、スループット)を前提に、RAGの“グラフ化”を最小限のコストで成立させる設計思想がポイントになる。

- MiniRAGの正体(何を軽量化し、何を残すのか)を通じて、今後のエッジ×LLM/ RAGの実装パターンを具体化する解説記事になっている。

はじめに

ルミナイR&Dチームの宮脇彰梧です。

現在はマルチモーダルAIの研究を行う大学院生として、

生成AIやAIエージェントの技術を実践的に探求しています。

最近、SLM(Small Language Models:Phi-3.5やQwen2.5-3Bなど) が熱いですよね。スマホやPC上でローカルに動くAI、夢があります。でも、実際にこれらのモデルで RAG を組もうとすると、壁にぶち当たった経験はありませんか?

「コンテキストウィンドウが狭くて情報が溢れる」

「ノイズの多い検索結果に引っ張られてハルシネーションがおこる」

「既存のGraphRAGは重すぎてローカルで...

Continue reading this article on the original site.

Read original →Related Articles

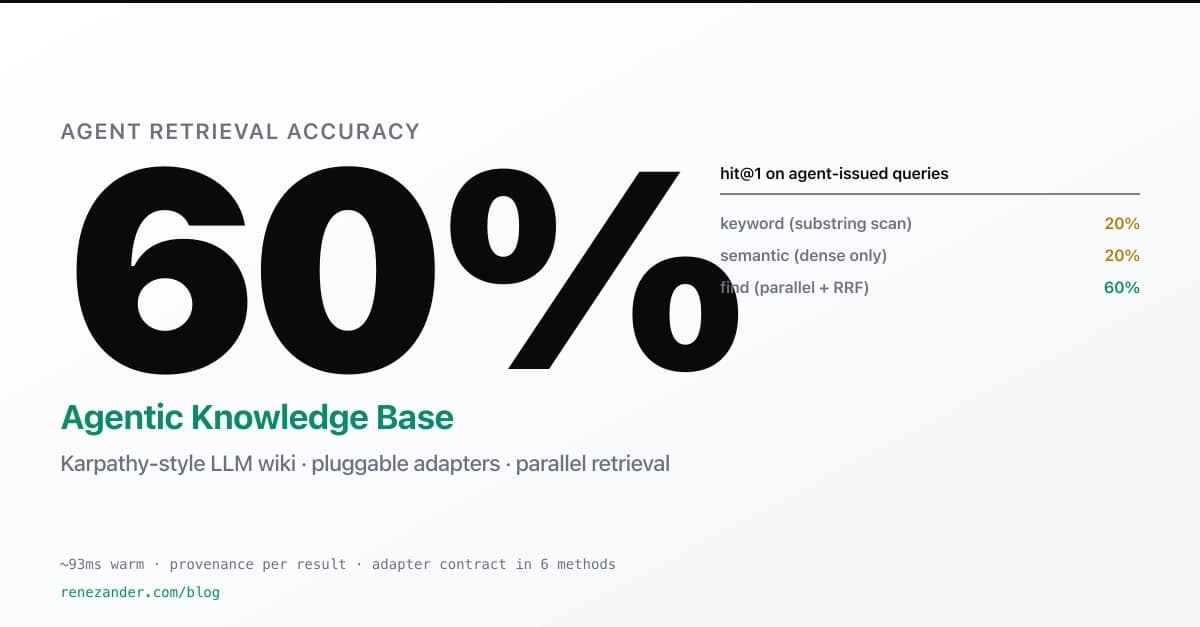

Agentic Knowledge Base — Karpathy's LLM wiki, with adapters

Dev.to

![Building Dynamic Audio with Emotion & Pace: Gemini 3.1 Flash TTS, Angular & Firebase Cloud Functions [GDE]](/_next/image?url=https%3A%2F%2Fmedia2.dev.to%2Fdynamic%2Fimage%2Fwidth%3D800%252Cheight%3D%252Cfit%3Dscale-down%252Cgravity%3Dauto%252Cformat%3Dauto%2Fhttps%253A%252F%252Fdev-to-uploads.s3.amazonaws.com%252Fuploads%252Farticles%252F4trm0f6j041qlxvji2f6.jpg&w=3840&q=75)

Building Dynamic Audio with Emotion & Pace: Gemini 3.1 Flash TTS, Angular & Firebase Cloud Functions [GDE]

Dev.to

Congrats, AI Made Everyone a SaaS Founder. Now what?

Dev.to

The 7 Best Final Round AI Alternatives in 2026: What Engineers Should Actually Pay Attention To

Dev.to

I built "Semvec": A Constant-Cost Semantic Memory for LLMs (Looking for testers!)

Reddit r/LocalLLaMA