LLMアプリのログをレシート化する:あとから説明できるAI処理の作り方

Zenn / 5/3/2026

💬 OpinionDeveloper Stack & InfrastructureTools & Practical Usage

Key Points

- LLMアプリの実行ログを「レシート(証跡)」として設計し、あとから何が起きたかを説明できる形で残す方法を解説している

- AI処理の入力・出力だけでなく、推論の前後関係や参照情報など説明に必要な粒度で記録することがポイントになる

- ログを後工程で読み返せるように整理することで、デバッグ、品質改善、説明責任(監査・ユーザー説明)に役立てられる

- 実装視点では、レシート生成をワークフローに組み込み、運用で参照しやすいフォーマットに落とし込む設計が示されている

はじめに

LLM アプリケーションを本番で運用するとき、いつものお作法的にログは残しますよね。

request log

response log

prompt log

error log

token usage

latency

model name

trace id

これらは重要ですが、AI が業務フローに入ってくると単なるログだけでは足りない場面が増えます。

たとえば、あとから次のように聞かれたとします。

なぜこの返信案が作られたのか

どの入力を読んだのか

添付ファイルは本当に読めていたのか

RAG の検索結果は十分だったのか

誰が承認したのか

どの action が実行され...

Continue reading this article on the original site.

Read original →Related Articles

Black Hat USA

AI Business

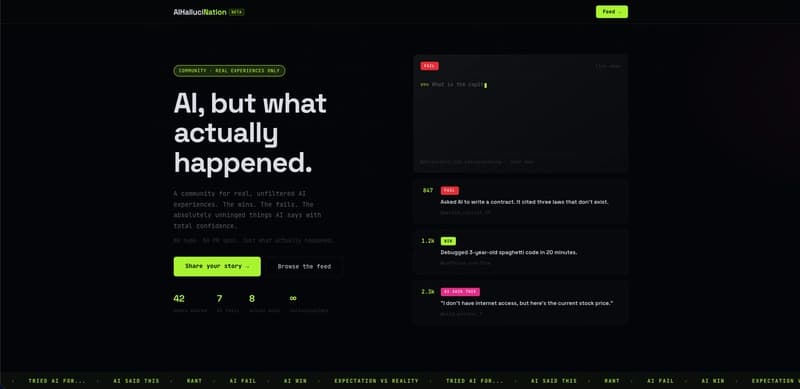

I used AI to moderate AI content — here's what I learned building AIHallucination

Dev.to

Stop Googling Prompts — Here's the Freelancer AI Toolkit That Actually Works

Dev.to

AI Powered Scheduling for Field Operations by Pablo M. Rivera

Dev.to

AI Deleted My Tests and Said 'All Tests Pass' — A Horror Story from Porting 'typia' from TypeScript to Go

Dev.to