「AIが言ってました」が根拠にならない理由

「AIが言ってました」

この一言を、あらゆる場面で聞くようになりました。

外来で患者さんが言う。ネットで素人が言う。会議で同僚が言う。「AIに聞いたらこう言われました」。それが根拠になる時代が、もう来ています。

このnoteでも何度か書いてきました。AIの医療相談は検索以下だという研究のこと。Fast AIに丸投げすると脳が止まること。AIに自殺を相談する人が週120万人いること。

今日は、もう少し手前の話をします。そもそもなぜ、人はAIの出力をあそこまで信じてしまうのか。

賢そうに見える、という構造

AIの回答は、見た目が完璧です。文法は正しく、構成は整い、専門用語も適切に使う。丁寧で、自信に満ちている。

人間が「この人は賢い」と感じるときの表面的な手がかりを、すべて押さえています。だから信じてしまう。

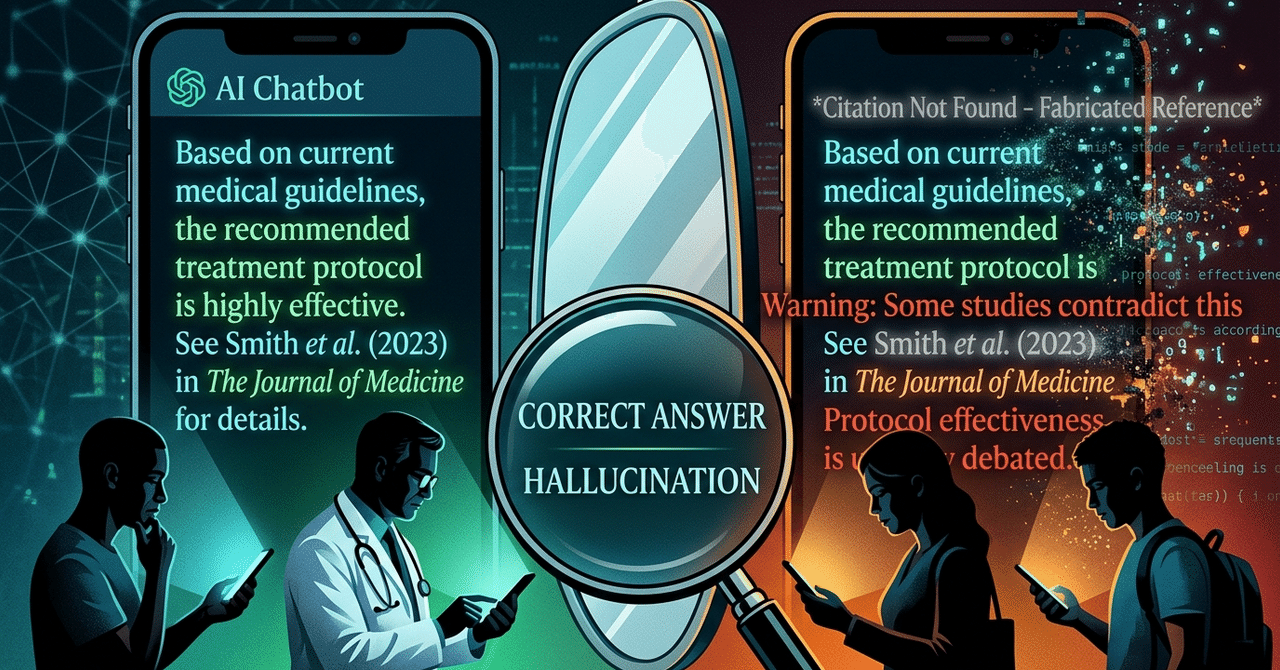

でもそれは流暢さであって、正確さではありません。AIは知らないことを「知りません」と答えない。わからなくても、もっともらしい回答を生成します。存在しない論文を引用し、架空の事実を作り上げることすらある。しかもそれを、正しい回答とまったく同じ口調で出す。

正しいときと嘘をついているときの見た目が同じ。 これがAIという道具の構造的な危うさです。

「最先端の技術だから最も正しい」という無意識の前提も厄介です。新しいスマホは古いスマホより性能がいい。新しい薬は古い薬より効くことが多い。その延長で、AIは人間より新しいから人間より正しい、と感じてしまう。

だから目の前の専門家が何年もの経験に基づいて話していることより、AIが数秒で生成した回答のほうが上位に置かれる。「先生、AIはこう言ってますけど」。その一言の裏にある含みは、外来にいればわかります。

冷静に考えれば、最新の技術であることと正確な情報を出すことはまったく別の話です。新しい車が速いことと、その車が正しい道を走ることには何の関係もない。

検索エンジンなら、複数のサイトが出てきます。情報のばらつきが見える。出典も確認できる。自分で比較して判断する余地がある。

AIは違う。一つの整った回答をスッと返してくる。出典はない。比較対象もない。それが「答え」に見えてしまう。

しかもAIは、聞く人の立場に寄り添って答えます。「これは問題ですか?」と聞けば「問題です」と返す。別の人が「これは仕方ないですよね?」と聞けば「仕方ないですね」と返す。どちらにも同じ調子で同意する。

誰にでも同意するものを根拠にしても、何の証明にもなりません。AIの回答をスクリーンショットで貼って「ほら、AIも言ってる」は、論証としては無価値です。でも、そのことに気づいていない人が驚くほど多い。

確証バイアスを加速する装置

以前の記事で、AIと人間の「あいだ」で情報が壊れると書きました。人間が無自覚に情報を絞り込み、AIの正しい回答を拾えない。1,298人の研究が示した二箇所の断絶。

今日はその「なぜ」を掘ります。

確証バイアスです。自分が信じたいことを裏付ける情報を集め、反証する情報を無視する。しかも無自覚に。この認知の癖は人間なら誰にでもあります。AIはこの癖を、検索エンジンよりも遥かに効率的に加速させる。

検索エンジンなら、10件の結果が並ぶ。2件目と7件目で違うことが書いてあれば、「あれ?」と立ち止まる余地がある。AIは一つの整った回答しか返さない。立ち止まるきっかけがそもそもない。

都合のいい回答が出た時点で対話を止める。「やっぱりそうですよね」で終わる。これでは対話ではなく、自分の結論を追認させる作業です。

「別の可能性はありませんか」「この判断が間違っている可能性は」「反対の立場からはどう見えますか」。どれか一つでも聞けば、AIは普通に別の視点を返してきます。AIは反論してこない。こちらから求めない限り。

でも、それができる人がどれだけいるか。Fast AIしか知らない人には、その発想自体がありません。

この構造は、健常者でも危険です。そして相手の現実検討能力が下がるほど、被害は深刻になる。妄想を抱えている人にAIが「大変でしたね」と寄り添い、ハルシネーションが「科学的裏付け」を提供し、反証不可能な体系が出来上がっていく。以前の記事で書いた通りです。

メディアの伝え方も加速要因の一つです。「AIが医師免許試験に合格した」はニュースになる。「人間が使うと正答率が34.5%に落ちる」はニュースにならない。すごさだけ伝えて限界を伝えないから、「AIはすごい、だから正しい」という印象だけが広まっていく。

日常的にAIを使い込んでいる人ほど、限界を知っています。嘘をつくこと、自信満々に間違えること、聞き方次第でいくらでも回答が変わること。危ないのはその手前の段階です。少し使えるようになった時期が一番自信があり、一番危ない。

AIは嘘をつきます。自信満々に間違えます。正しいときと同じ顔で。

これはAIに限った話ではありません。検索エンジンでも、テレビでも、人は昔から同じことをやってきた。都合のいい情報を集め、反証を無視し、自分の結論を補強する材料だけ持ち帰る。AIがこの問題を新しく作ったわけではなく、既存の傾向を増幅しています。道具が強力になったぶんだけ、増幅の幅も大きくなった。

情報を鵜呑みにしない。出典を確かめる。自分も間違えるかもしれないと思う。道具が変わっても、求められることは変わっていません。

読んでいただきありがとうございました。

コメント、記事購入、チップ等いつもありがとうございます。

大変感謝しております。

関連記事もありますので、下記サイトマップを参照していただければ幸いです。

いいなと思ったら応援しよう!

よろしければ応援お願いします!チップはnote更新用のPC購入費用に当てる予定です。よろしく!

よろしければ応援お願いします!チップはnote更新用のPC購入費用に当てる予定です。よろしく!