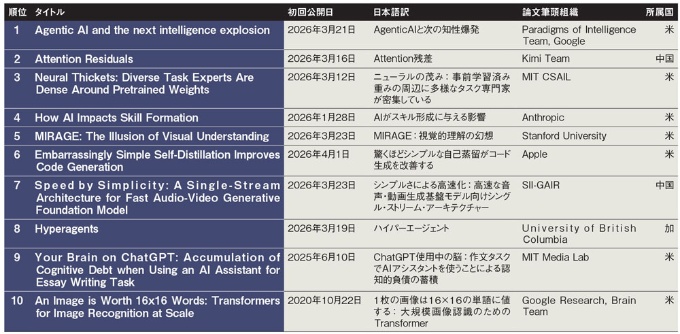

Moonshot AIが開発する基盤モデルKimiは、中国発のAIモデルの中でも高い性能で知られる。米エヌビディアの年次技術イベントに創業者が登壇するなど、世界で存在感を着実に高めている。そのKimiの開発チームが今回、LLM(大規模言語モデル)の根幹設計に正面から切り込んだ。

2017年にTransformerが登場して以来、基盤モデル開発で研究が進んだのは「横の設計」、つまり系列方向のトークン間Attention(注意機構)の設計だった。Multi-Head AttentionからGrouped Query Attention、DeepSeekのMLA(Multi-head Latent Attention)に至るまで、その進化は目覚ましかった。しかし各層が情報をどう受け渡すかという「縦の設計」、つまり深さ方向の情報統合については、ほぼ手つかずだった。Transformerが層間の情報受け渡しに残差接続(Residual Connection)を採用し、2018年ごろに学習の安定化のためPreNorm構成(層正規化を各層の直前に配置する構成)を適用して以降8年ほど、主要モデルにおいて大きな変化は見られなかった。

Transformerが採用する残差接続とは、直前の層の出力と自身の出力を合算して次の層に入力する仕組みだ。この再帰的な操作は、全ての過去層の出力を「重み1で単純に足し合わせる」ことと等価である。層が深くなるほどこの足し合わせが積み重なるため、隠れ状態の値が増大しやすい。結果として、深い層ほど自身の出力が全体に与える影響が薄れていく。論文が「PreNormの希薄化」と呼ぶこの現象により、大規模モデルの深い層の一部を削っても性能に大きな影響を与えないことが、近年の研究で明らかになっていた。

次のページ

Attentionを縦方向に適用するこの記事は有料会員限定です