ランダムフォレスト → XGBoost → LightGBM:進化の流れで理解する機械学習モデル

Qiita / 4/6/2026

💬 OpinionModels & Research

Key Points

- ランダムフォレストからXGBoost、さらにLightGBMへといった代表的な木構造系モデルの進化の流れを、学習の考え方の変化として整理している。

- アンサンブル(多数決/平均)から、勾配ブースティングによる誤差を順次改善する枠組みへと発展していく点が理解の軸になる。

- LightGBMでは効率的な学習手法や分岐の扱いにより、実務で扱いやすい性能・速度を狙う方向性が示される。

- それぞれのモデルの位置づけを「いつ何が選択肢になるか」という観点でも捉え直せる内容になっている。

表形式データに対して機械学習の予測モデルを作るとき、このような疑問を持った経験はないでしょうか。

「結局、ランダムフォレスト、XGBoost、LightGBM、どれを使えばいいんだろうか?」

とりあえずXGBoostを使う。

あるいは「速いらしい」という理由でLightG...

Continue reading this article on the original site.

Read original →Related Articles

From Forecast to Fulfillment: Aligning AI Predictions with Farm Sales

Dev.to

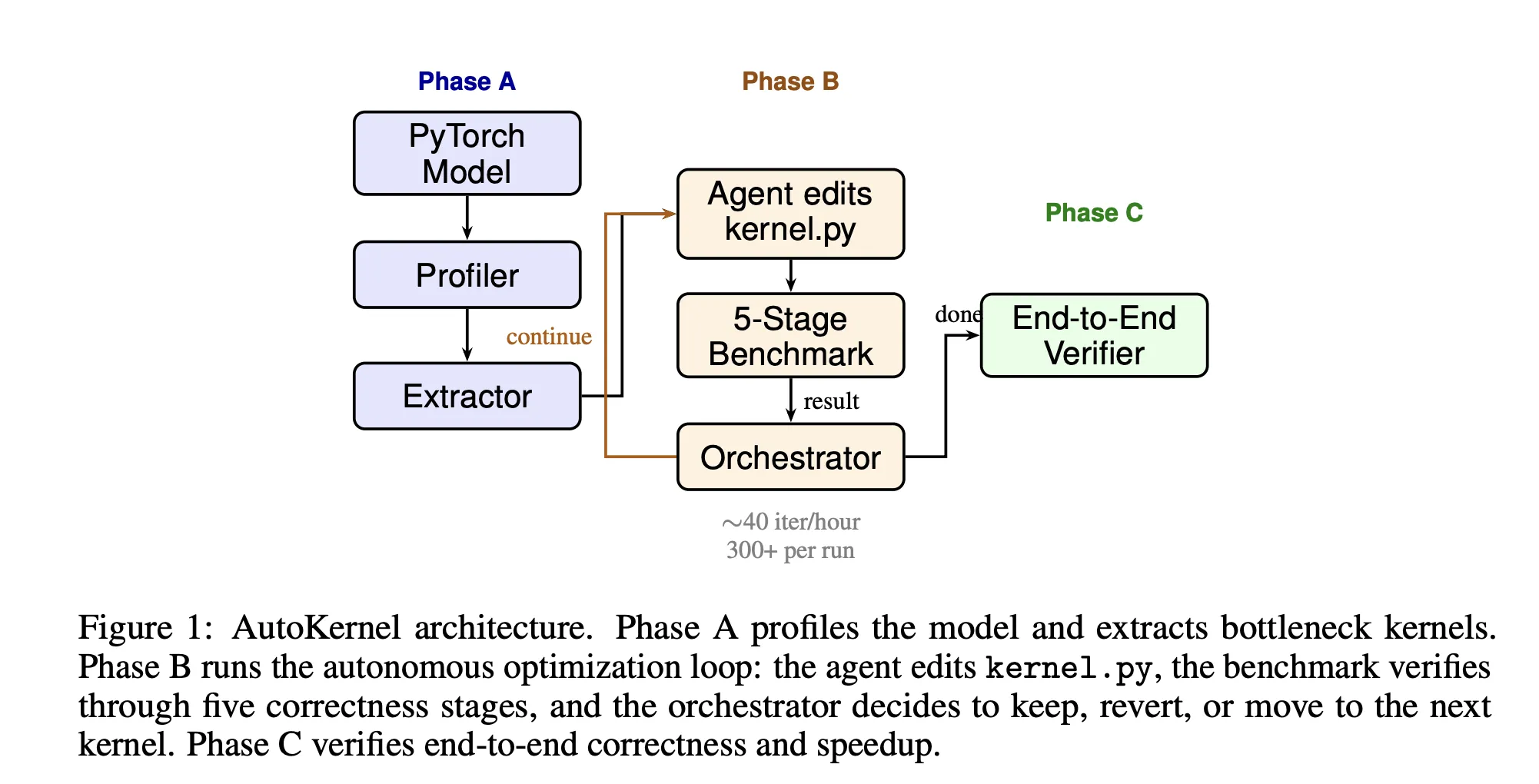

RightNow AI Releases AutoKernel: An Open-Source Framework that Applies an Autonomous Agent Loop to GPU Kernel Optimization for Arbitrary PyTorch Models

MarkTechPost

Alibaba's Qwen team built HopChain to fix how AI vision models fall apart during multi-step reasoning

THE DECODER

HunyuanOCR 1B: Finally a viable OCR solution for potato PCs? Impressive OCR performance on older hardware

Reddit r/LocalLLaMA

Qwen3.5-4B GGUF quants comparison (KLD vs speed) - Lunar Lake

Reddit r/LocalLLaMA