Baby Scale: Investigating Models Trained on Individual Children's Language Input

arXiv cs.CL / 4/1/2026

💬 OpinionIdeas & Deep AnalysisModels & Research

Key Points

- 研究は、子どもの自然な言語入力(BabyViewの動画文字起こし)を用いて、LLMが「人間の子どもが受け取るデータ量」に近い条件でどのように学習・振る舞うかをベンチマークして「データギャップ」の正体を調べています。

- 子どもデータで学習した言語モデルは文法課題では許容できるスケーリングを示す一方、意味や世界知識を要する課題では合成データで学習したモデルより伸びが弱いことが報告されています。

- さらに、子どもごとの経験が反映されたデータではモデル性能に大きなばらつきがあり、データ品質を左右する言語的予測因子(分布的特徴と相互作用的特徴の組み合わせ)が重要だと示されています。

- 個々の単語に対するモデルの尤度が、子どもがその単語を学習する度合いと相関することから、子ども向け入力の性質がモデル学習と人間の言語発達の双方に影響しうると結論づけています。

Related Articles

Show HN: 1-Bit Bonsai, the First Commercially Viable 1-Bit LLMs

Dev.to

I Built an AI Agent That Can Write Its Own Tools When It Gets Stuck

Dev.to

Agent Self-Discovery: How AI Agents Find Their Own Wallets

Dev.to

[P] Federated Adversarial Learning

Reddit r/MachineLearning

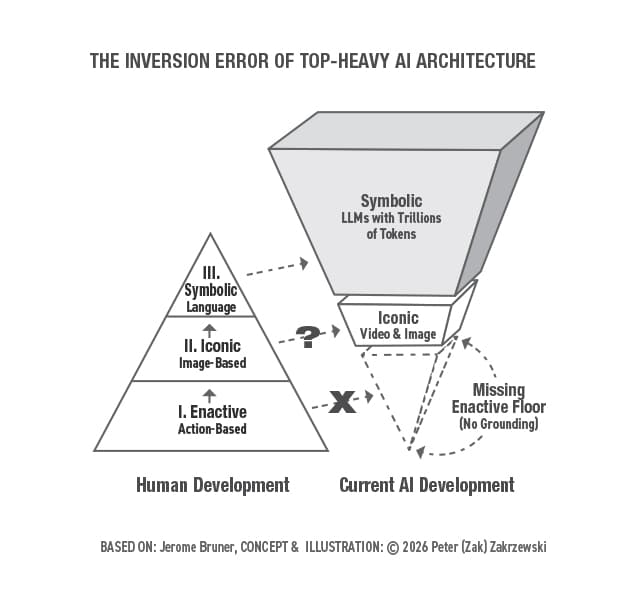

The Inversion Error: Why Safe AGI Requires an Enactive Floor and State-Space Reversibility

Towards Data Science