[論文読解]Attention is All You Need

Qiita / 5/13/2026

💬 OpinionIdeas & Deep AnalysisModels & Research

Key Points

- Transformerアーキテクチャを初めて提唱した歴史的な論文で、従来の主流モデルの限界を背景に位置づけられている。

- Attention(特に自己注意)を中心に据えることで、系列モデリングの性能を大きく押し上げる考え方が示されている。

- 以降のLLMの精度向上につながる“飛躍”をもたらした点が強調されている。

- 本記事は論文読解(メモ)として、Transformerの重要性を概観する導入になっている。

Transformerアーキテクチャを初めて提唱した論文。飛躍的なLLMの精度向上に繋がった歴史的な論文。

1. 従来の主流モデルとその限界

自然言語処理、特に機械翻訳などのシーケンス変換タスクにおいて、Transformerが登場する前はAttentionを用いたRNN...

Continue reading this article on the original site.

Read original →Related Articles

Anthropic's First Banking Agent Just Went Into AML

Dev.to

How AI Reduced Manual Driver Verification by 75% — Operations Case Study. Part 2

Dev.to

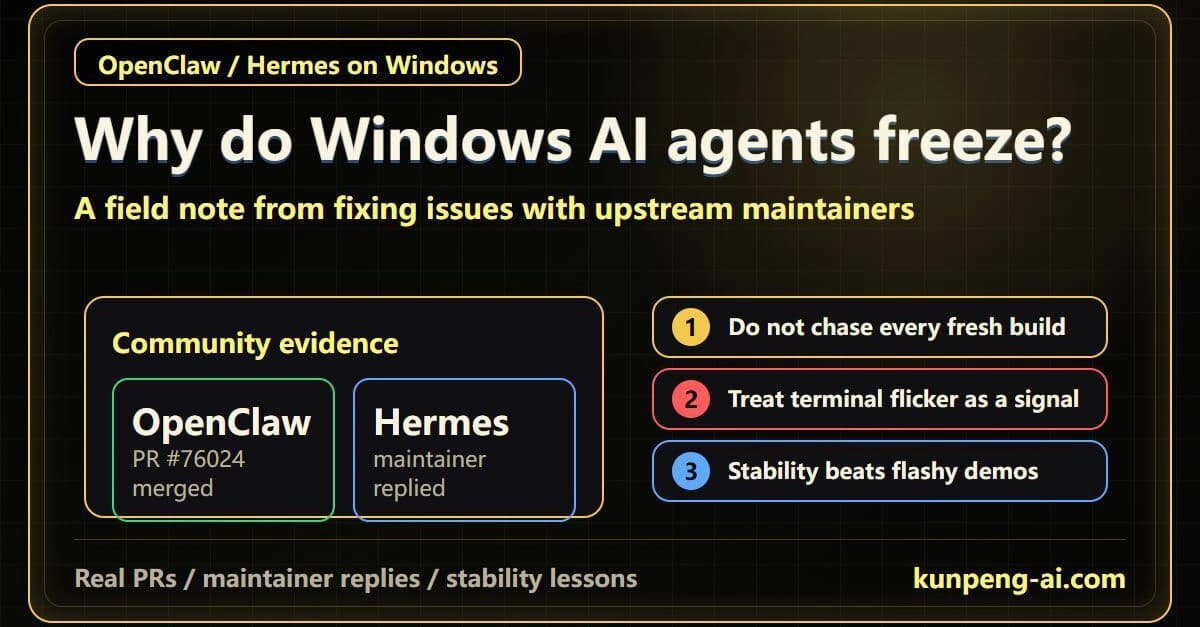

Windows agents keep freezing: lessons from an OpenClaw merge and a Hermes maintainer reply

Dev.to

Apple Bets Big on Gemini AI to Revolutionize Siri’s Smarts

Dev.to

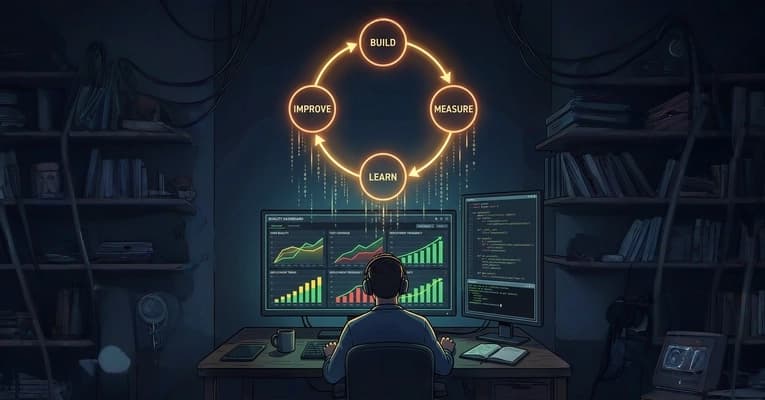

My AI Remembers Its Mistakes. Permanently. Here's the Engineering.

Dev.to