LLM API コスト削減パターン集 2026年版 — Batch API・キャッシュ・モデル選定で月次コストを半減する実装ガイド

Zenn / 4/26/2026

💬 OpinionDeveloper Stack & InfrastructureTools & Practical Usage

Key Points

- Batch APIの活用やリクエスト設計見直しにより、LLM API利用の効率を上げて月次コストを大幅に削減する方法を提示しています。

- キャッシュ戦略(再利用可能な応答や中間結果の保存)を組み合わせることで、同一・類似処理の繰り返しを抑制します。

- モデル選定(用途に応じた適切なモデルの使い分け)を行い、必要な品質を満たしつつ高コストな推論を避ける方針が示されています。

- コスト最適化を「設計(バッチ/ワークフロー)×運用(キャッシュ)×選定(モデル)」の三点セットで実装するガイドになっています。

LLM API コスト削減パターン集 2026年版 — Batch API・キャッシュ・モデル選定で月次コストを半減する実装ガイド

はじめに

複数のLLM APIを使い分けている開発者なら、この悩みを抱えたことがあるはずだ。

「月末の請求を見たら、想定の3倍になってた」

OpenAI、Anthropic、Google... 複数のプロバイダーのAPIキーを持つようになると、「どのプロバイダーにいくら使ったか」の把握が急に難しくなる。

各プロバイダーのコンソールを行き来して、請求を確認するのは時間の無駄だ。もっと悪いことに、複数APIの単価差を意識しないままコードを書いていると、 ...

Continue reading this article on the original site.

Read original →💡 Insights using this article

This article is featured in our daily AI news digest — key takeaways and action items at a glance.

Related Articles

Black Hat USA

AI Business

The Context Window Is a Lie

Dev.to

7 Transaction Types Your AI Agent Can Execute: From Transfers to Contract Deployment

Dev.to

Day 7 of Building GoDavaii: Why My Grandmother's Four Medicines Inspired India's Health AI

Dev.to

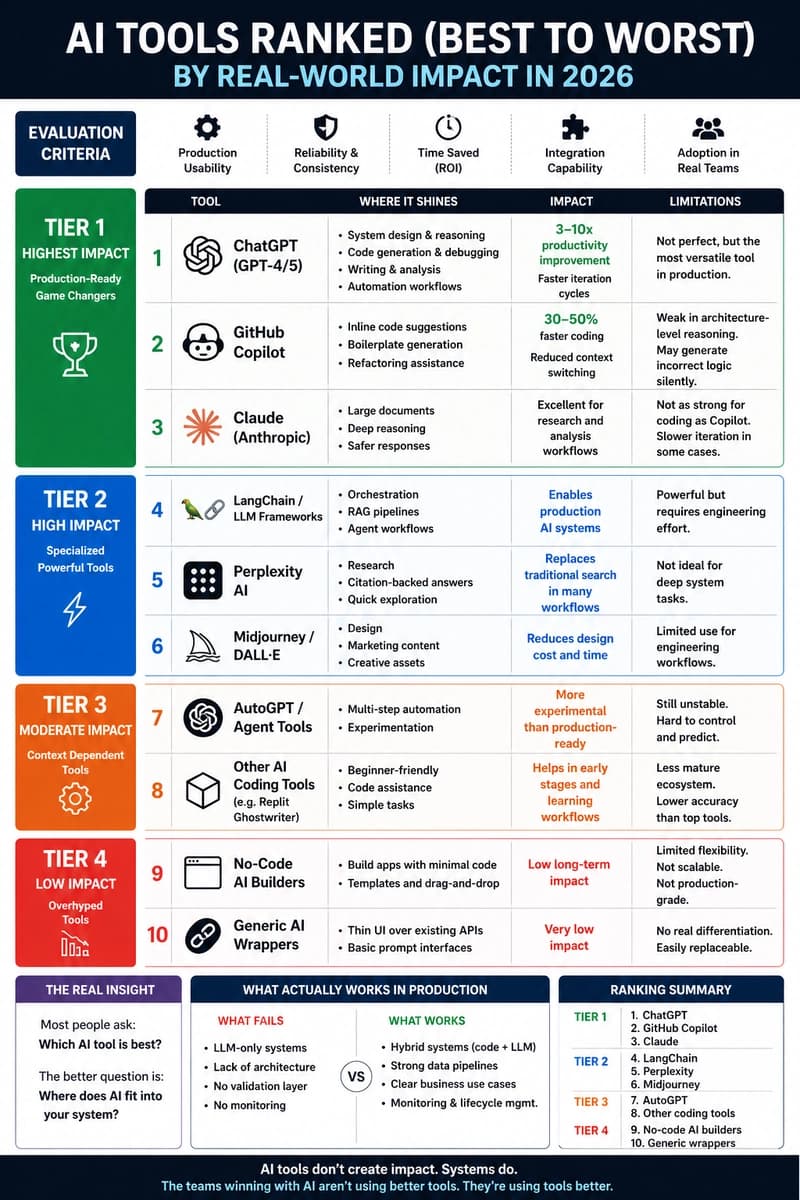

AI Tools Ranked (Best to Worst) by Real-World Impact

Dev.to