![How Visual-Language-Action (VLA) Models Work [D]](https://external-preview.redd.it/fBpt1C8zS6YDW2Lp0_fnNCU2C0Dw1W3tzt7P4g39SHw.jpeg?width=640&crop=smart&auto=webp&s=d9f046e9b38c478cf671d18df1b23a42fd1613bd) | VLA models are quickly becoming the dominant paradigm for embodied AI, but a lot of discussion around them stays at the buzzword level. This article gives a solid technical breakdown of how modern VLA systems like OpenVLA, RT-2, π0, and GR00T actually map vision/language inputs into robot actions. It covers the main action-decoding approaches currently used in the literature: • Tokenized autoregressive actions Useful read if you understand transformers and want a clearer mental model of how they’re adapted into real robotic control policies. Article: https://towardsdatascience.com/how-visual-language-action-vla-models-work/ [link] [comments] |

How Visual-Language-Action (VLA) Models Work [D]

Reddit r/MachineLearning / 4/26/2026

💬 OpinionIdeas & Deep AnalysisModels & Research

Key Points

- Visual-Language-Action(VLA)モデルは「身体性(embodied)AI」の主流パラダイムになりつつあるが、議論はしばしばバズワード止まりだと指摘されています。

- 本記事は OpenVLA、RT-2、π0、GR00T などの代表的なVLAシステムが、画像と言語入力からロボットの行動へどのように対応づけられているかを技術的に解説しています。

- 行動デコード(action decoding)の主要アプローチとして、トークン化した自己回帰的アクション、拡散ベースのアクションヘッド、フローマッチング(flow-matching)ポリシーの3方式を整理しています。

- トランスフォーマーの理解を前提に、実際のロボット制御ポリシーへ適用する際の「頭の中のモデル(mental model)」を掴める読み物として紹介されています。

- 記事リンクとして Towards Data Science の解説が示されています。

Related Articles

Big Tech firms are accelerating AI investments and integration, while regulators and companies focus on safety and responsible adoption.

Dev.to

How I tracked which AI bots actually crawl my site

Dev.to

Anthropic created a test marketplace for agent-on-agent commerce

TechCrunch

If I work on something in codex, and future models are trained on my interactions, does that mean the next model release will be able to code my project for other users?

Reddit r/artificial

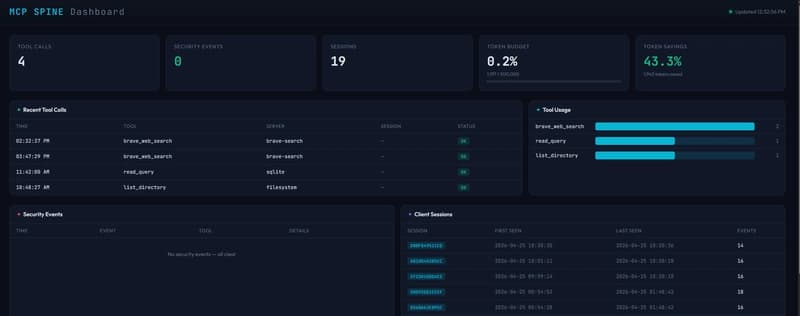

MCP Spine v0.2.5: I Built a Full Middleware Stack for MCP Tool Calls

Dev.to