| submitted by /u/paf1138 [link] [comments] |

Using OCR models with llama.cpp (by ngxson)

Reddit r/LocalLLaMA / 4/11/2026

💬 OpinionDeveloper Stack & InfrastructureTools & Practical Usage

Key Points

- この記事(共有元はreddit経由)は、llama.cpp を使って OCR(文字起こし)モデルをローカルに動かす手順・考え方を紹介しています。

- OCRモデルを利用する際の基本的なセットアップ(モデルの準備や実行の流れ)に触れ、実運用に近い形での使い方を示しています。

- 既存のローカルLLM/推論環境に OCR を組み込むことで、テキスト化パイプラインを手元で完結させる活用イメージが提示されています。

- 実装者が llama.cpp の枠組みの中で OCR を扱うための実践的な起点になる内容です。

💡 Insights using this article

This article is featured in our daily AI news digest — key takeaways and action items at a glance.

Related Articles

Black Hat USA

AI Business

Black Hat Asia

AI Business

I built the missing piece of the MCP ecosystem

Dev.to

Best AI Detectors in 2026: I Tested 30+ Popular AI Detectors to Find the Most Accurate Ones

Dev.to

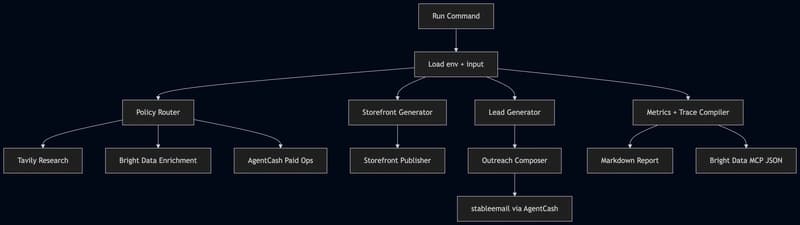

Building an Agentic Commerce Router with TypeScript, AgentCash, Bright Data, Tavily, OpenAI, and Featherless

Dev.to