なぜRAGだけではAgentは「記憶」できないのか:LLMシステムにおけるMemoryアーキテクチャの設計

Zenn / 4/28/2026

💬 OpinionDeveloper Stack & InfrastructureIdeas & Deep Analysis

Key Points

- RAGは外部知識の検索・参照には強いが、Agentが対話や実行の文脈を「内的に記憶」し続けるには不十分であるという問題設定が提示されます。

- Memory(短期/長期、要約や永続化、更新戦略など)を別レイヤとして設計しないと、同一タスク内の整合性や継続的な学習・回想が崩れやすい点が説明されます。

- そのため、検索(RAG)と記憶(Memory)の役割分担を明確にし、必要な情報だけを適切な形式で保持・再利用するアーキテクチャが重要になります。

- LLMシステムでは「いつ」「何を」「どう更新し」「どう参照するか」を設計することが、Agentの記憶能力と信頼性を左右する要点としてまとめられます。

はじめに

LLMを活用したアプリケーション開発が一般的なものになり、今や「RAG(Retrieval-Augmented Generation)」はシステム設計において欠かせないコンポーネントになりました。社内ドキュメントの検索からカスタマーサポートまで、多くのプロダクトがRAGによって「ハルシネーションの少ない回答」を実現しています。

しかし、システムが単なる「1問1答のチャットボット」から、自律的にタスクをこなす「Agent」へと進化するにつれて、多くの開発者が壁にぶつかっています。

「RAGを実装したのに、AIが昨日の会話の前提を覚えていない」

「ユーザーの好みをベクトルDBに...

Continue reading this article on the original site.

Read original →💡 Insights using this article

This article is featured in our daily AI news digest — key takeaways and action items at a glance.

Related Articles

Write a 1,200-word blog post: "What is Generative Engine Optimization (GEO) and why SEO teams need it now"

Dev.to

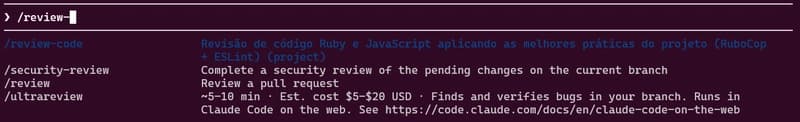

how to use skills from Claude Code A.K.A Claudinho.

Dev.to

Indian Developers: How to Build AI Side Income with $0 Capital in 2026

Dev.to

Most People Use AI Like Google. That's Why It Sucks.

Dev.to

Behind the Scenes of a Self-Evolving AI: The Architecture of Tian AI

Dev.to