LLMアプリにOAuthでモデル利用権限を委譲するのは現実的なのか

Zenn / 5/5/2026

💬 OpinionDeveloper Stack & InfrastructureIdeas & Deep Analysis

Key Points

- LLMアプリでユーザーのモデル利用権限をOAuthで委譲する設計は魅力的だが、実運用では権限粒度・認可の実装・監査の難しさが課題になるという問題提起がある

- 認可サーバ側で「どのモデルを・どの範囲で・どの条件で」使わせるかを正しく表現できないと、アプリ開発や利用者体験に支障が出やすい

- 権限委譲を成立させるには、トークン設計(スコープ/リソース)だけでなく、利用ログ・不正利用対策・失効/再認可など周辺の運用設計もセットで考える必要がある

- 結論として、単にOAuthを当てはめるだけでは不十分で、現実的な形に落とすには追加の認可/課金/ガバナンスの仕組みが求められると整理されている

はじめに

前の記事で以下のようなことを書きました。

一つ考えられるのは、LLMモデル部分の可用性やキャパシティ確保は自サービスの責任から外してしまうということです。

例えば多くの皆さんがお馴染みのClaude Codeは、ユーザーがAPIキーを提供するか、Claude.ai Subscriptionによる認証を済ませてそのユーザーが持つクオータを利用するかのどちらかでLLMモデルの利用権限を調達する設計になっています。

このようなBYOC(Bring Your Own Credential)の考え方やOAuthを利用したLLMモデルCallの権限委任を利用することで、AIアプリケー...

Continue reading this article on the original site.

Read original →Related Articles

Transform Your Blurry Photos into HD Masterpieces, Instantly!

Dev.to

6 New Moats for AI Agent Infrastructure — Trust Score, Deployment, SLA, Identity, Compliance-as-Code

Dev.to

There will still be art in software

Dev.to

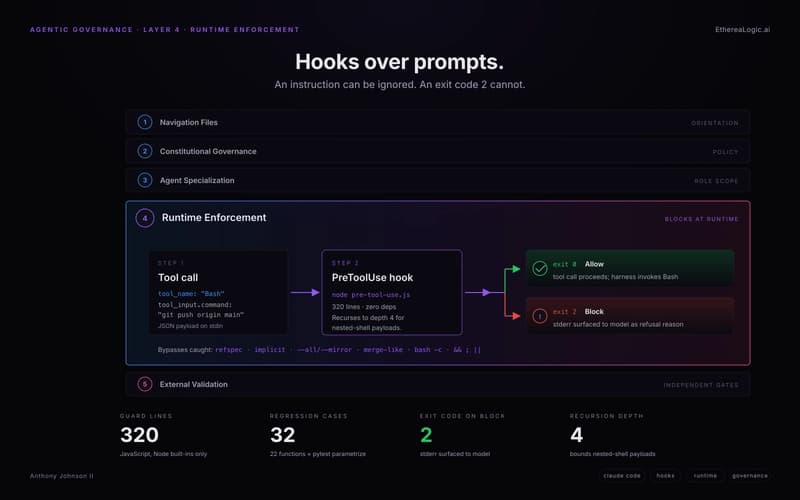

Exit Code 2: How Claude Hooks Turn Agentic Rules Into Runtime Barriers

Dev.to

Qiskit Backend Specifications for OpenQASM and OpenPulse Experiments

Dev.to