【RAG高速化】RAGCache:KVキャッシュをツリー構造で管理してTTFTを4倍速くする技術

Zenn / 5/2/2026

💬 OpinionDeveloper Stack & InfrastructureTools & Practical UsageModels & Research

Key Points

- RAGの高速化に向けて、KVキャッシュをツリー構造で管理する「RAGCache」を提案し、TTFT(Time To First Token)を最大4倍短縮する。

- ツリー構造により、前段の推論状態を効率よく再利用し、RAGのリクエスト間で無駄な計算を減らす狙いがある。

- KVキャッシュの管理方式を工夫することで、生成の立ち上がり速度(初回トークンまでの遅延)を改善するアプローチになっている。

- RAGを「LLM Ready」な形で運用するための実装・最適化観点(推論基盤側の改善)として有用な技術ブログである。

はじめに

ルミナイR&Dチームの宮脇彰梧です。

現在はマルチモーダルAIの研究を行う大学院生として、

生成AIやAIエージェントの技術を実践的に探求しています。

今回は、RAGの実装者なら誰もが悩む「遅延(レイテンシ)」の問題に、真正面から切り込んだ論文「RAGCache」を深掘りします。vLLMなどの推論エンジンを触っている方には特に刺さる内容です!

学べること:

RAGのボトルネックである「Prefill(入力処理)」の遅延原因

RAGCacheの核となる「ナレッジツリー」と「PGDSF」アルゴリズムの理論

Pythonによるキャッシュ置換アルゴリズムの再現実装

...

Continue reading this article on the original site.

Read original →💡 Insights using this article

This article is featured in our daily AI news digest — key takeaways and action items at a glance.

Related Articles

Black Hat USA

AI Business

Every handle invocation on BizNode gets a WFID — a universal transaction reference for accountability. Full audit trail,...

Dev.to

I tracked my referral sources for 30 days. AI chatbots are beating Google.

Dev.to

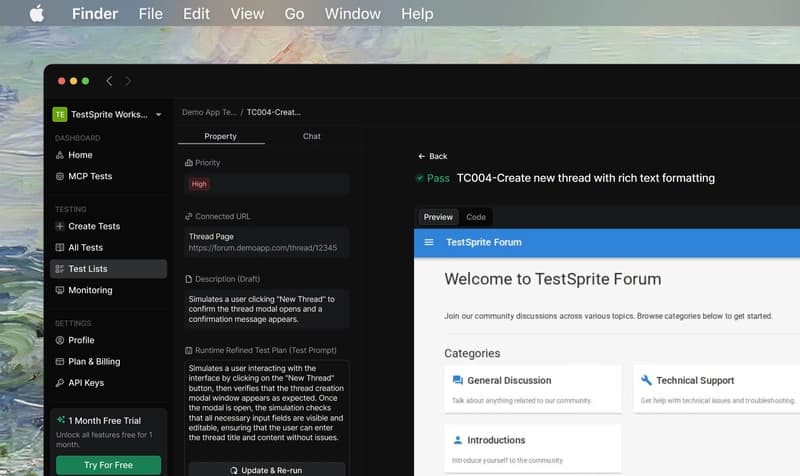

TestSprite: Review Mendalam dari Developer Indonesia — Lokalisasi, Tanggal, dan Mata Uang Rupiah

Dev.to

When AI Agents Trade Autonomously: Building Economic Actors That Never Sleep

Dev.to