P/D Disaggregated Inference with LMCache - 2

Zenn / 4/21/2026

💬 OpinionDeveloper Stack & InfrastructureTools & Practical UsageModels & Research

Key Points

- P/D Disaggregated Inference(分散推論)の考え方と、LMCacheを用いた推論効率化のアプローチを整理している。

- 入力や中間表現の再利用により、計算・メモリ・レイテンシの削減を狙うことが中心論点である。

- LMCacheにより同一/類似の推論状況での重複計算を減らし、スループット向上に繋げる設計思想が示唆されている。

- 全体として、実運用を意識した推論アーキテクチャ(分割・キャッシュ・再利用)の実装観点が学習/検討向けにまとめられている。

https://zenn.dev/tosshi/articles/b9fdb42d36bd82

!

本記事は ↑ の記事に続くシリーズ第 2 部です!第 1 部では PD 分離推論 with LMCache の概念と実際の結果確認の流れについて説明しました。本記事では、実際の実装リファレンスを提示しながら注意ポイントを解説します。

はじめに

今回は実装編ということで実際に動かすまでの手順を解説していこうと思います。色々と試行錯誤するための実験環境であり、本番向けではないのでご注意ください。

インフラストラクチャ構築

大枠はこちらに記載のワークショップに手順があるのでそちらをまず...

Continue reading this article on the original site.

Read original →Related Articles

Black Hat USA

AI Business

Capsule Security Emerges From Stealth With $7 Million in Funding

Dev.to

Agent Package Manager (APM): A DevOps Guide to Reproducible AI Agents

Dev.to

3 Things I Learned Benchmarking Claude, GPT-4o, and Gemini on Real Dev Work

Dev.to

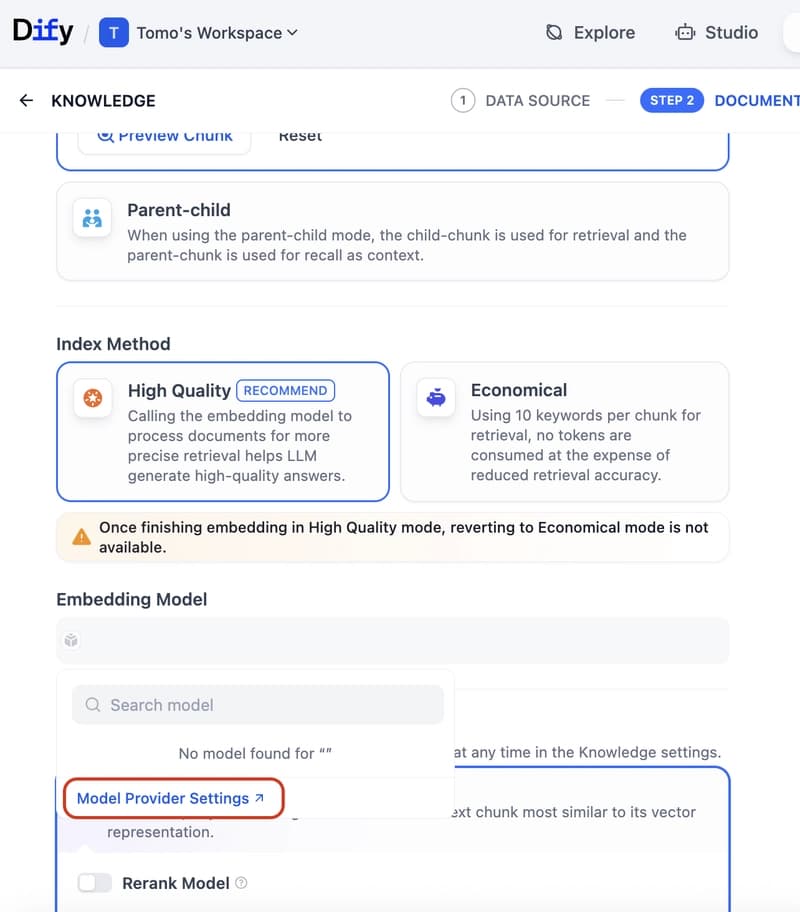

Dify Now Supports IRIS as a Vector Store — Setup Guide

Dev.to