AIがAIを育てる時代、モデルの“出力癖”は監査対象になるのか

Zenn / 5/2/2026

💬 OpinionIdeas & Deep AnalysisModels & Research

Key Points

- AIをAIが学習・生成する「自己増殖的」環境では、モデルが持つ“出力癖”(表現傾向・バイアス・誤りの型)が強化されやすくなる点が論点になる。

- その結果、従来の品質管理や安全性評価だけでなく、監査(audit)の対象として“出力癖”をどう定義し、どう測定・追跡するかが重要になる。

- 監査設計では、モデル単体の性能だけでなく、データ継承や学習ループによる挙動変化(再現性・ドリフト)まで含めて管理する必要がある。

- 実務上は、出力の特徴量化・ログ化、テストケース整備、ポリシー/ガードレールとの紐付けによって、出力癖を説明可能な形で監査可能にすることが求められる。

はじめに

AIがAIの出力を使って、次のAIを育てる。

合成データ、自己蒸留、モデル蒸留、AIによる評価、AIによるデータ生成。

こうした流れは、今後さらに一般的になっていく可能性があります。

そのとき、少し気になることがあります。

AIが出した文章やコードの「意味」が安全なら、本当に安全と言えるのか。

もしかすると、これからは生成物の意味内容だけではなく、

生成元モデルの“出力癖”や統計的なパターンまで、監査対象になるのかもしれません。

この記事では、その可能性を断定ではなく、問題提起として整理します。

きっかけ:AIがAIを育てる時代

大規模言語モデルの開発では、AIが生成...

Continue reading this article on the original site.

Read original →💡 Insights using this article

This article is featured in our daily AI news digest — key takeaways and action items at a glance.

Related Articles

GPT-5.5 Outperforms (and Hallucinates), Kimi K2.6 Leads Open LLMs, AI Strains Climate Pledges, Strategic Thinking in LLMs vs. Humans

The Batch

Big Tech firms are accelerating AI investments and integration, while regulators and companies focus on safety and responsible adoption.

Dev.to

Edge-to-Cloud Swarm Coordination for smart agriculture microgrid orchestration with embodied agent feedback loops

Dev.to

Gemini 3.1 Flash TTS: the next generation of expressive AI speech

Dev.to

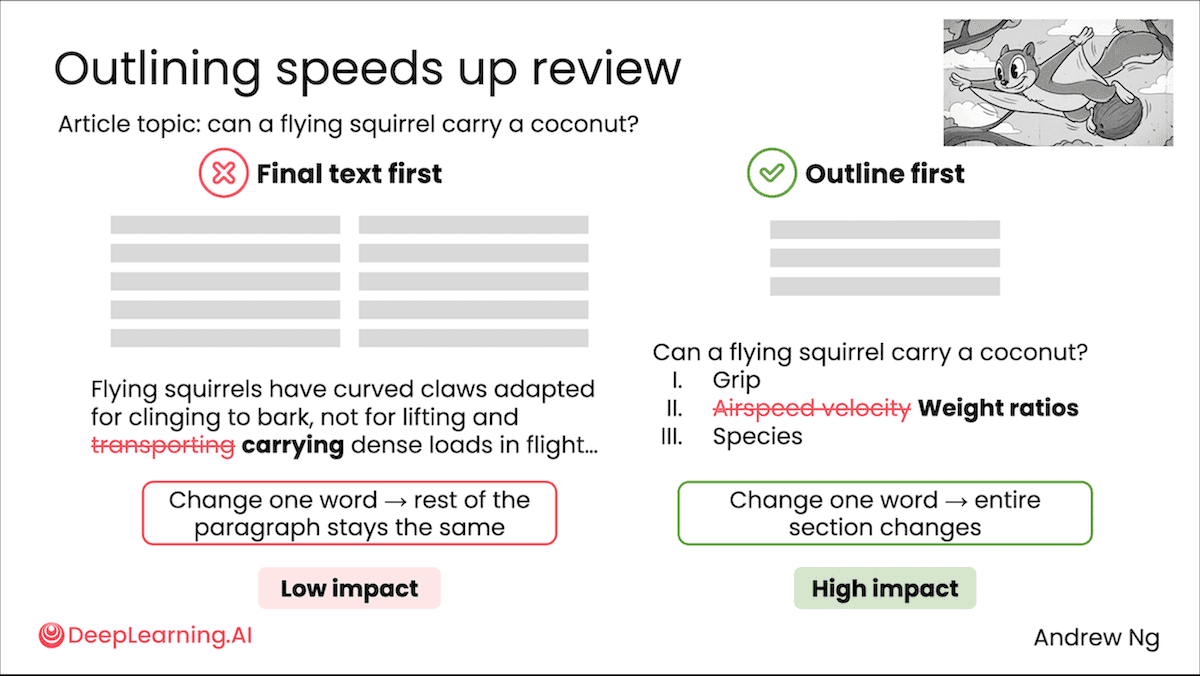

Prompt engineering techniques

Dev.to