Langfuse v4 で LLM アプリを計測・改善する — Sessions / Users / Scores 実践ガイド

Zenn / 4/21/2026

💬 OpinionDeveloper Stack & InfrastructureTools & Practical Usage

Key Points

- Langfuse v4 を用いて LLM アプリの利用状況(Sessions / Users)と品質指標(Scores)を計測し、改善サイクルを回す方法を整理している

- どの単位でログ・計測データを捉えるか(セッションやユーザー単位の設計)を意識して、分析しやすい形に落とし込む

- スコアリング(Scores)を設定して、モデル/プロンプト/実装の変更が成果に与える影響を比較できるようにする

- 収集した計測データを基に、問題箇所の特定から改善方針の決定までを実践的に進めるためのガイドになっている

はじめに

LLM アプリケーションを作っていると、必ず遭遇する壁があります。

プロンプトを変えたけど、本当に精度が上がったのか分からない

ユーザーから「なんか最近おかしい」と言われたが、どの呼び出しが悪かったか追えない

コストが膨らんでいるが、どのユーザー・どの機能が重いのか見えない

最初は print() でログを出していたのが、logging に移り、そのうち SQLite に書き始め、気づけば自前の「なんちゃって LLMOps 基盤」を作っている……というのがよくある成り行きです。筆者もそうでした。

この記事では、Langfuse v4 を使って LLM アプリに「計測と改...

Continue reading this article on the original site.

Read original →Related Articles

Black Hat USA

AI Business

Capsule Security Emerges From Stealth With $7 Million in Funding

Dev.to

Agent Package Manager (APM): A DevOps Guide to Reproducible AI Agents

Dev.to

3 Things I Learned Benchmarking Claude, GPT-4o, and Gemini on Real Dev Work

Dev.to

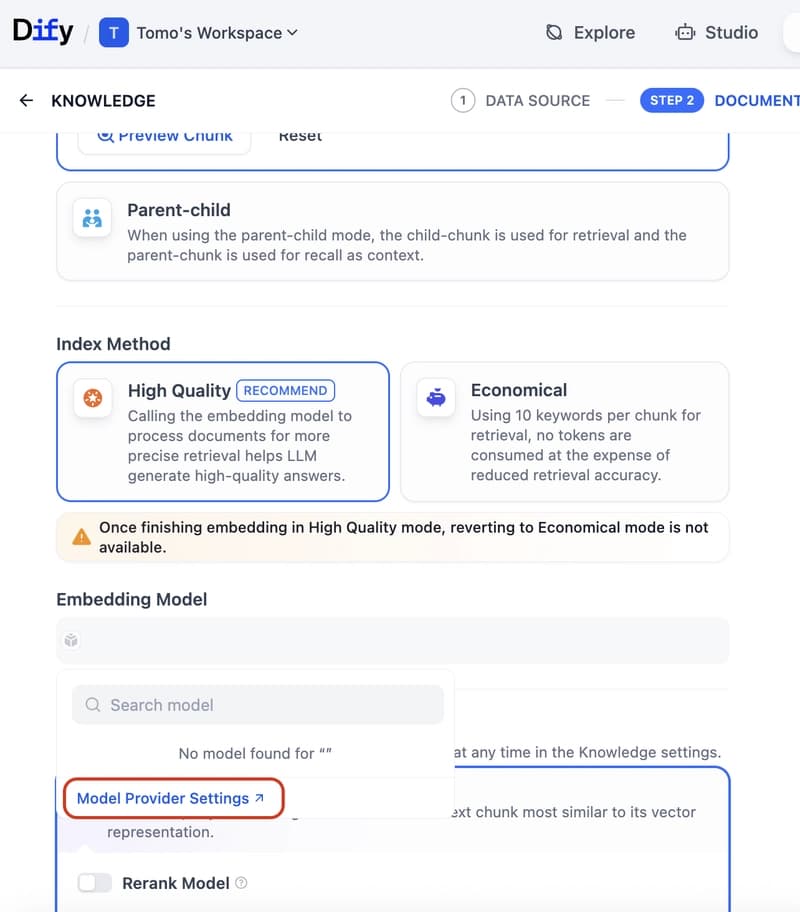

Dify Now Supports IRIS as a Vector Store — Setup Guide

Dev.to