AIとの対話ログ -LLMは確率的なのに、なぜコードが書けるのか-

Zenn / 4/16/2026

💬 OpinionIdeas & Deep AnalysisModels & Research

Key Points

- LLMは確率的に次トークンを生成するのに、なぜ対話の結果としてコードが整った形で出力できるのかを問いとして扱う。

- 生成が「偶然の出力」に見えても、学習データと言語・文法・構文上の制約により、コードらしさ(形式的整合性)が高くなる点を説明する。

- 期待される振る舞い(目的の関数、APIの使い方、文脈整合)に沿うように、確率分布の中で整合的な候補が選ばれているという見立てを示す。

- “確率的”と“実用的な正解”が両立する理由を、モデル内部の確率性だけでなく、外部で使われる文脈・タスク定義・プロンプトなどの要素も含めて考える方向性が示される。

この記事について

この記事はAIとの共同執筆です。ただし、いわゆる「ポン出し」ではありません。AIとの実際の対話をもとに構成されており、筆者が全文を読んだうえで、自分の主張・理解と一致していることを確認しています。

はじめに

「LLMは確率的に出力するのに、プログラミングでは全然ミスらないのはなぜ?」

そんなツイートを見かけて、気になってしまった。どのツイートか見失ってしまったけど、問い自体が頭に残った。

文章なら多少おかしくても「まあ読める」で済む。でもコードは違う。print("hello") を prent("hello") にしたら、それだけで動かない。一文字のミスが即...

Continue reading this article on the original site.

Read original →Related Articles

The AI Hype Cycle Is Lying to You About What to Learn

Dev.to

Big Tech firms are accelerating AI investments and integration, while regulators and companies focus on safety and responsible adoption.

Dev.to

Inside NVIDIA’s $2B Marvell Deal: What NVLink Fusion Means for AI Ethernet Fabrics

Dev.to

Automating Your Literature Review: From PDFs to Data with AI

Dev.to

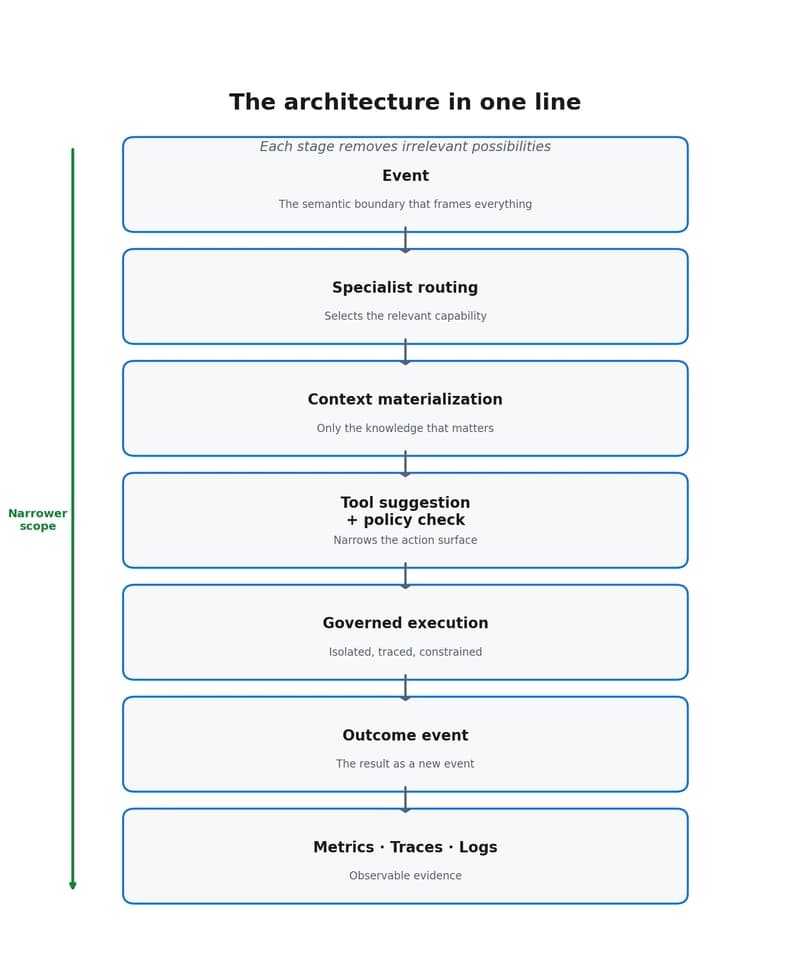

Why event-driven agents reduce scope, cost, and decision dispersion

Dev.to