Preferred Networksは3月19日、既存モデルを下敷きにせず、ゼロベースで構築した大規模言語モデル「PLaMo 3.0 Prime」のβ版をリリースした。中国産モデル「DeepSeek R-1」などの開発手法を参考に、同様の形で開発したモデルとしては国内で初めて、長考によってクオリティーの高い回答(reasoning)が可能な機能を搭載した。現在、無償利用を前提にモニター企業を募っている。

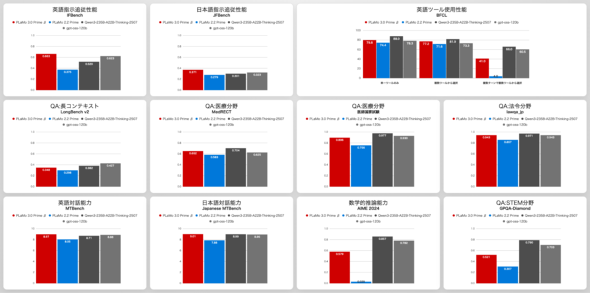

ベンチマークでは日本語・英語による指示への追従性能や対話能力で「Qwen3-235B-A22B-Thinking-2507」や「gpt-oss-120b」(長考の程度は3段階で中)に勝り、医療・法令分野も肉薄。ただし数学や、英語ツールの利用性能のうち、複数の段階で多数のツールから選んで使う能力は大きく劣った。

コンテキスト長は入力64Kトークン・出力20Kトークンと、旧モデル「PLaMo 2.2 Prime」の入力32Kトークン・出力4Kトークンから拡大した。ただしこちらも「DeepSeek V3.2」や「GPT-5.2」といったモデルには劣るため、苦手なタスクへの対応能力と合わせて今後の改善を目指す。

関連記事

GPT-4を超える日本語性能のLLM、PFN子会社がフルスクラッチで開発 無料トライアルを開始

GPT-4を超える日本語性能のLLM、PFN子会社がフルスクラッチで開発 無料トライアルを開始

AIスタートアップ・Preferred Networks(PFN)の子会社であるPreferred Elementsは8月7日、大規模言語モデル「PLaMo β版」の無料トライアルの申し込み受付を始めたと発表した。 PFN、新LLM「PlaMo 2 8B」(仮称) 開発中 パラメータ数1000億→80億に、でも性能は維持

PFN、新LLM「PlaMo 2 8B」(仮称) 開発中 パラメータ数1000億→80億に、でも性能は維持

Preferred Networksの岡野原大輔代表取締役が、開発中の新しい大規模言語モデル「PlaMo 2 8B」(仮称)について明らかにした。同社の既存モデル「PLaMo-100B」の性能を維持しつつ、パラメータ数を約12分の1に削減したという。 中国アリババ、DeepSeekの「V3」越えうたうAIモデル「Qwen2.5-Max」公開

中国アリババ、DeepSeekの「V3」越えうたうAIモデル「Qwen2.5-Max」公開

中国Alibabaは、大規模言語モデル「Qwen」シリーズの最新モデル「2.5-Max」を公開した。 第2のDeepSeekショック? オープンな中国LLM「Qwen3」シリーズが破格の性能で話題 最大モデルはOpenAI o1やGemini 2.5 Proに匹敵、たった4BでもGPT-4oレベルに

第2のDeepSeekショック? オープンな中国LLM「Qwen3」シリーズが破格の性能で話題 最大モデルはOpenAI o1やGemini 2.5 Proに匹敵、たった4BでもGPT-4oレベルに

Alibabaの最新LLM「Qwen3」シリーズが話題。フラグシップモデルはDeepSeek-R1やOpenAIの「o1」「o3-mini」、Google「Gemini 2.5 Pro」など他のトップクラスモデルと並ぶ性能の他、「Qwen3-4B」は非常に小さなモデルでありながらも「GPT-4o」を多くの項目で上回るとしている。全てのモデルがオープンウェイトなので完全ローカルで動作させることが可能。 OpenAIの「o1」と同レベルうたうLLM「R1」登場、中国DeepSeekから 商用利用可

OpenAIの「o1」と同レベルうたうLLM「R1」登場、中国DeepSeekから 商用利用可

中国のAI企業DeepSeekが、米OpenAIの「o1」と同レベルの性能をうたう大規模言語モデル(LLM)「DeepSeek-R1」を公開した。いずれもMITライセンスで、商業利用なども認めている。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

続きを読むには、コメントの利用規約に同意し「アイティメディアID」および「ITmedia AI+メールマガジン」の登録が必要です