SOAR: Self-Correction for Optimal Alignment and Refinement in Diffusion Models

arXiv cs.LG / 4/15/2026

💬 OpinionIdeas & Deep AnalysisModels & Research

Key Points

- 拡散モデルのポストトレーニングでは、SFT(教師あり微調整)が正しい前向きノイズ経路の状態にのみ最適化されるため、推論時に逸脱すると露出バイアスが発生し、補正が学習されないというギャップがある。

- 提案手法SOARは、実サンプルからモデルを1回ロールアウトしてオフ軌道状態を得た後、それを再ノイズし、元のクリーンターゲットへ戻すように自己矯正するオンポリシー・報酬フリーのバイアス補正を行う。

- SOARは報酬モデルも報酬信号も不要で、各タイムステップに対する密な教師信号によりクレジット割当問題を回避できる。

- SD3.5-MediumでGenEvalとOCRがSFTから大幅に改善し、さらにモデルベースの嗜好スコアも総じて向上するなど、RLなしでもアラインメント改善が確認された。

Related Articles

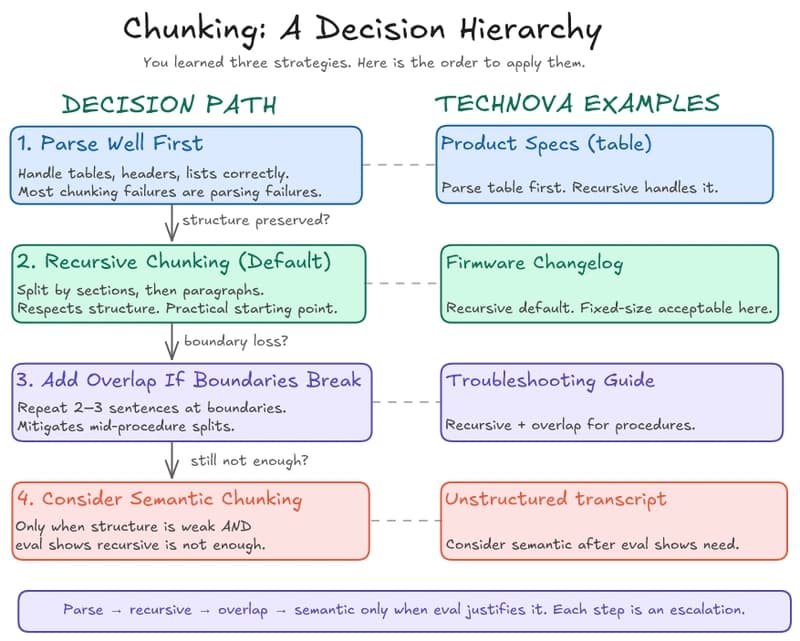

RAG in Practice — Part 4: Chunking, Retrieval, and the Decisions That Break RAG

Dev.to

Why dynamically routing multi-timescale advantages in PPO causes policy collapse (and a simple decoupled fix) [R]

Reddit r/MachineLearning

How AI Interview Assistants Are Changing Job Preparation in 2026

Dev.to

Consciousness in Artificial Intelligence: Insights from the Science ofConsciousness

Dev.to

NEW PROMPT INJECTION

Dev.to