ねこと学ぶ🐱 Apple Silicon で LLM 推論を最適化する Hypura を試す

Zenn / 3/25/2026

💬 OpinionDeveloper Stack & InfrastructureTools & Practical Usage

Key Points

- Apple Silicon上でLLM推論を最適化するツール「Hypura」を実際に使って試した内容を扱っています

- LLMをMac/Apple Silicon環境で動かす際の推論最適化・運用面の工夫に焦点があります

- Hypura導入によって、推論体験(速度や効率など)にどの程度影響するかを確認する流れになっています

- 計算環境がApple Silicon中心の開発者にとって、ローカル推論の選択肢を増やす示唆が含まれます

Hacker News で見かけた Hypura が気になりすぎた

Hacker News を眺めてたら「Hypura」ってプロジェクトが話題になってて。Apple Silicon のユニファイドメモリと NVMe SSD の帯域をうまく使って、VRAM に載りきらないサイズの LLM でもスケジューリングで効率よく推論させるらしい。

正直「またローカル推論ツールか」と思ったんだけど、ストレージ階層を意識してるって発想がちょっと面白くて、つい触ってしまった。

セットアップは素直だった

リポジトリを clone して、Python の venv 作って依存関係入れるだけ。ここは特に...

Continue reading this article on the original site.

Read original →Related Articles

Lemonade 10.0.1 improves setup process for using AMD Ryzen AI NPUs on Linux

Reddit r/artificial

The 2026 Developer Showdown: Claude Code vs. Google Antigravity

Dev.to

CRM Development That Drives Growth

Dev.to

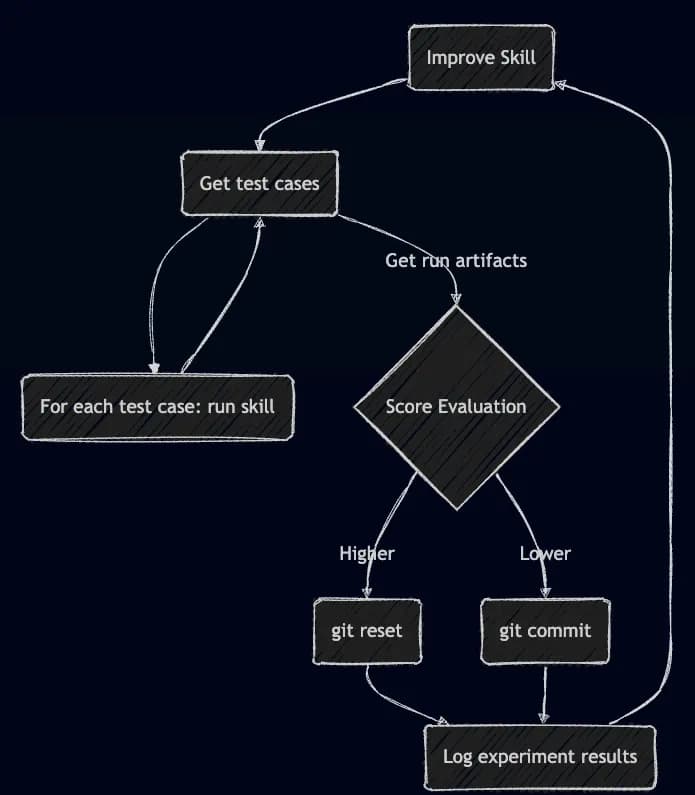

Karpathy's Autoresearch: Improving Agentic Coding Skills

Dev.to

How to Write AI Prompts That Actually Work

Dev.to