「LLMはまだ次の単語予測か」という議論の止まった場所

SNSで「LLMは次の単語予測をやっているだけ」という言い方が、また蒸し返されている。それに対して「もう違う」と言い返す人がいる。両方とも、半分正しくて半分すれ違っている。

何が変わって、何が変わっていないか

最初に技術的事実を押さえる。

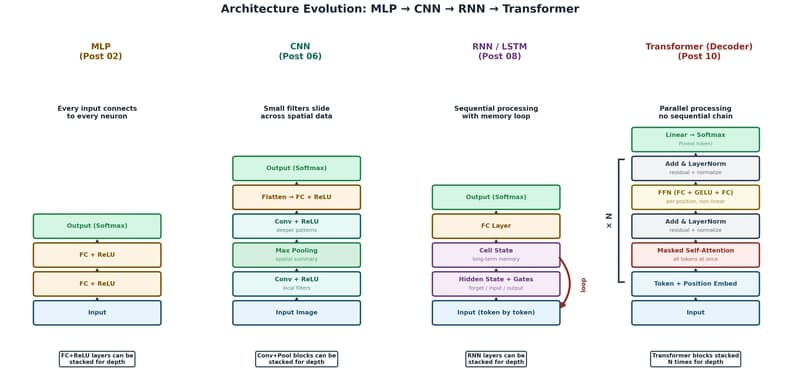

現行のLLMは、内部で次トークンの確率分布を計算し、そこから一つを選ぶ。この機構そのものは何も変わっていない。Transformerベースの自己回帰モデルであり、マルコフ連鎖の遠縁にあたることも事実だ。「アーキテクチャは変わってないよね」という反論は、この点では正確だ。

ただし、変わったものがある。

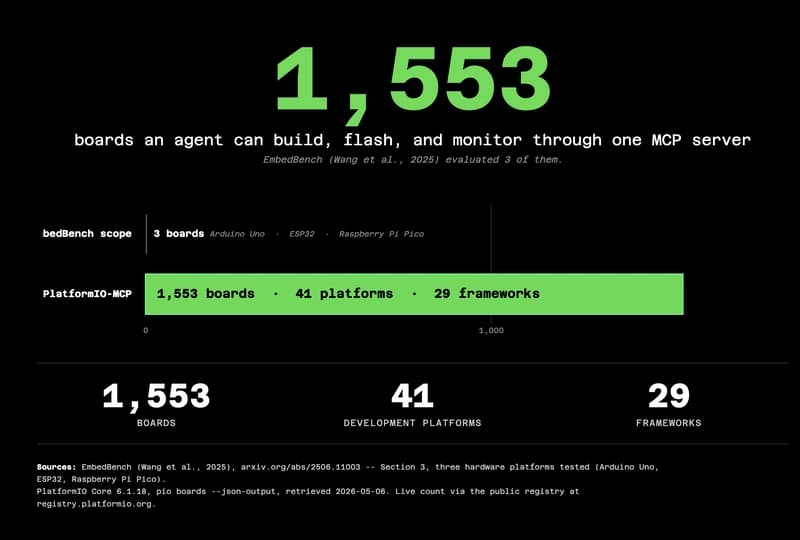

RLHFによる選好学習。推論時の思考連鎖(CoT)。検証器付きの探索。ツール使用ループ。マルチモーダル化。これらが積み重なった結果、トークン選択の意味合いが変質した。

CoTで生成される中間ステップも、最終的には次トークンを順番に出している。だが、その中間ステップが最終答えの精度を引き上げる方向に訓練されている。o1やo3系の推論モデルでは、複数の推論経路を並列に走らせて評価関数で選別する手続きが組み込まれている。単純なgreedyやサンプリングで一本道に出力するのとは別の動きで、予測機構の上に探索と選別のレイヤーが乗っている。

つまり機構は予測のままだが、その予測の使われ方が変わった。「もう次トークン予測ではない」と言うと機構の話として誤りになり、「ただの次トークン予測だ」と言うと使われ方の話として古い。

本当の論点は語の解釈にある

発端の投稿者は、後から補足を入れていた。

内部で次トークンの確率を計算している点は変わらない。問題は「次の単語予測」という表現が、暗黙のうちに「すでに存在する文章を再現する」イメージを与えてしまうことだ、と。

この補足で論点が整理された。

「予測」という語には正解の存在が前提されやすい。これは機械学習史の文脈で見るとわかりやすい。教師あり学習の「正解ラベルとの一致度」が予測という語の元の意味で、回帰や分類タスクでは正解が存在することが前提されていた。生成モデルでは、その枠組みが既に外れている。にもかかわらず「予測」という語だけが残った。

既存テキスト分布のそれらしい続きを再現する、という像も、この古い枠組みを引きずっている。だが推論モデルの実際の動きは、問題を分解し、仮説を置き、中間状態を更新し、最終答えに近づくための操作になっている。同じ「次トークンを選ぶ」でも、再現と操作では意味が違う。

論争の焦点は「機構が変わったか」ではなく、「次トークン予測という語が現状を正しく描写できているか」だった。

そもそも「予測か思考か」という分け方がおかしい

技術論を離れて、もう一段。

「LLMは予測しているだけで思考していない」という言い方には、別方向から疑義が出ていた。予測しない知能は存在するのか、という問いだ。

チェスは数手先を読む。運転は他車の動きを予測する。文章を書くときも文法的に何が来るかを予測している。手を伸ばす動作も、コップに届くかの予測なしには成立しない。予測と知能はとてもよく似ている。むしろ同じものに近い。

これは比喩ではなく、認知科学側の理論枠組みでもある。フリストンの自由エネルギー原理は、脳を「予測誤差を最小化し続けるシステム」として定式化している。予測符号化理論も同じ方向で、知覚も運動も思考も、上位層の予測と下位層の入力の差分処理として説明される。「予測しているだけ」という否定形は、この見方の上では意味を失う。予測しているからこそ、何かをやれている。

1980年に哲学者ジョン・サールが提出した「中国語の部屋」がある。中国語を理解しない人間が、マニュアルに従って中国語の質問に中国語で回答する。外からは理解しているように見えるが、内部に理解はない。記号操作だけでは意味の理解に到達しない、という議論だ。SNSで繰り返されている「予測しているだけ」という言い方は、構造としてサールの問いの再演になっている。40年以上前の枠組みが、対象を変えながら同じ形で循環している。

議論はもう次の場所に移っている

少し戻って自分の過去記事の話をする。

3月にNature Scientific Reportsの論文を扱った。29人にドイツ語のオーディオブックを聴かせ、EEG・MEGで脳活動を記録し、Llama 3.2の内部表現と比較した研究だ。脳もLLMも、次の単語を予測している。脳は名詞が来る前から準備態勢に入り、予測が外れたときの誤差信号(N400)はLLMの予測確率と定量的に対応する。

予測機構を持つ点で、脳とLLMは構造的に類似している。これは実験データで示されている。

その上で、脳にあってLLMにないものは何か。論文が示したのは、脳の名詞処理が側頭葉だけでなく感覚運動野にまで広がっていることだ。意味の身体的グラウンディング。LLMは膨大なテキストから「りんご」の前後に来る単語パターンを学習しているが、りんごを触ったことも見たこともない。

12月にはQuattrociocchiらの「人間とAIの認識論的断層」も扱った。LLMは思考しているのではなく、思考しているように見える出力を生成しているだけだ、という論文だ。接地性、解析、経験、動機、因果律、メタ認知、価値。人間の判断プロセスとLLMの処理プロセスの間に7つの断層があると整理されている。論文はこの状態を「Epistemia」と名付けた。言語的なもっともらしさが認識論的評価の代わりになってしまう状態を指す。

5月の記事では別の論文を扱った。Erik Hoelによる「LLM意識の反証」。意識には継続学習が必要であり、LLMは推論時に重みが固定されるから意識を持たない、という主張だ。学習時に他者の歴史は内包しているが、自己の歴史は蓄積されない。

ただし、ここには射程の問題がある。RAGや外部記憶を備えたエージェント型LLMは、重みは固定でも外部に履歴を蓄積していく。Hoelの反証がこの構成にまで及ぶのか、論文では踏み込まれていない。

2025年に発表されたLLM意識の体系的サーベイは、競合する意識理論が少なくとも9つ存在することを整理している。統合情報理論、グローバルワークスペース、高階表象、能動的推論、身体性認知。出発点も成立条件もそれぞれ異なる。問いが「LLMに意識はあるか」から「どの条件が満たされれば意識と呼べるか」に精緻化されている。

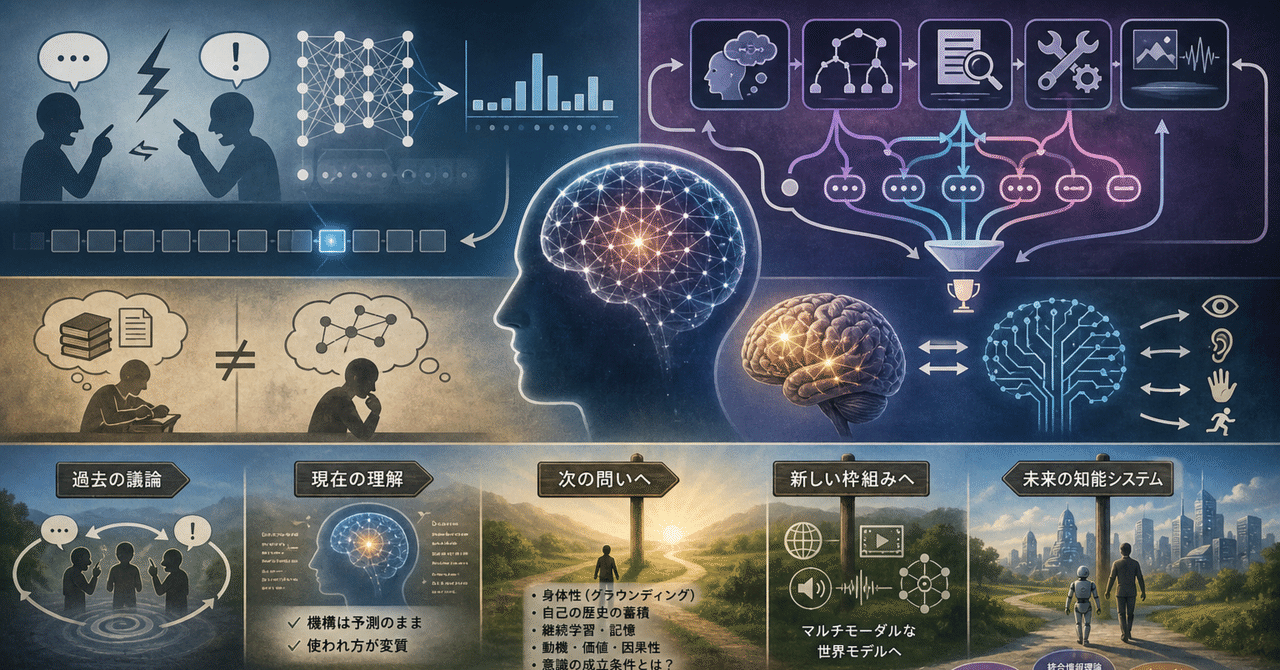

身体的グラウンディングの有無。自己の歴史の蓄積の有無。学術側で問われているのは、こうした条件のレベルにある。

「LLM」という呼び方も古い

発端の投稿者が補足で書いていたもう一点。マルチモーダル化により、純粋な言語データ以外がモデルの内部表現に重要な影響を与えるようになった。「LLM」という呼称自体が現状を捉えきれていない、という指摘だ。

これは妥当に見える。画像、音声、動画を含む学習データが世界モデルに反映され、言語ベンチマークのスコアまで底上げされている。言語モデルという枠組みで切り出して議論する時代は、もう終わりに近い。

「次の単語予測」という言葉が古いのと、「LLM」という呼称が古いのは、地続きの問題だ。どちらも、議論の枠組み自体が現状から1〜2世代遅れている。

SNSのレイヤーが1年半遅れている

予測機構の有無で「思考」を線引きする議論は、技術的にも哲学的にも片付いている。機構は予測のままだが使われ方が変質した、というのが現状の正確な記述で、その先で「予測する系に何が加われば思考と呼べるか」という問いに移っている。身体性、継続学習、自己の歴史の蓄積。論点はそこにある。

それにもかかわらず、SNSでは「LLMは予測しているだけ」「いや違う」が定期的に蒸し返される。発端の投稿が「一年半前までの話」と書いていたが、その通りだ。学術側で議論が一段先に進んだあとも、SNSは出発点でぐるぐる回り続けている。

知能とは別問題で、これは情報の循環構造の問題に見える。専門家の議論が一般層に届くまでのタイムラグがまずある。さらにSNSのアルゴリズムは「わかりやすい対立構造」を再生産する方向に働く。「予測か思考か」は二項対立として綺麗に成立してしまうから、何度でも復活する。論点が更新されても、ゾンビのように戻ってくる。AIをめぐる言説では特に顕著だ。

予測か思考か、という問いに時間を使うのはもう損だ。問いはもっと先にある。

読んでいただきありがとうございました。

コメント、記事購入、チップ等いつもありがとうございます。

大変感謝しております。

関連記事もありますので、下記サイトマップを参照していただければ幸いです。

いいなと思ったら応援しよう!

よろしければ応援お願いします!チップはnote更新用のPC購入費用に当てる予定です。よろしく!

よろしければ応援お願いします!チップはnote更新用のPC購入費用に当てる予定です。よろしく!