KVキャッシュを光で読んだらメモリ転送が16分の1になった

Qiita / 4/8/2026

💬 OpinionSignals & Early TrendsIdeas & Deep Analysis

Key Points

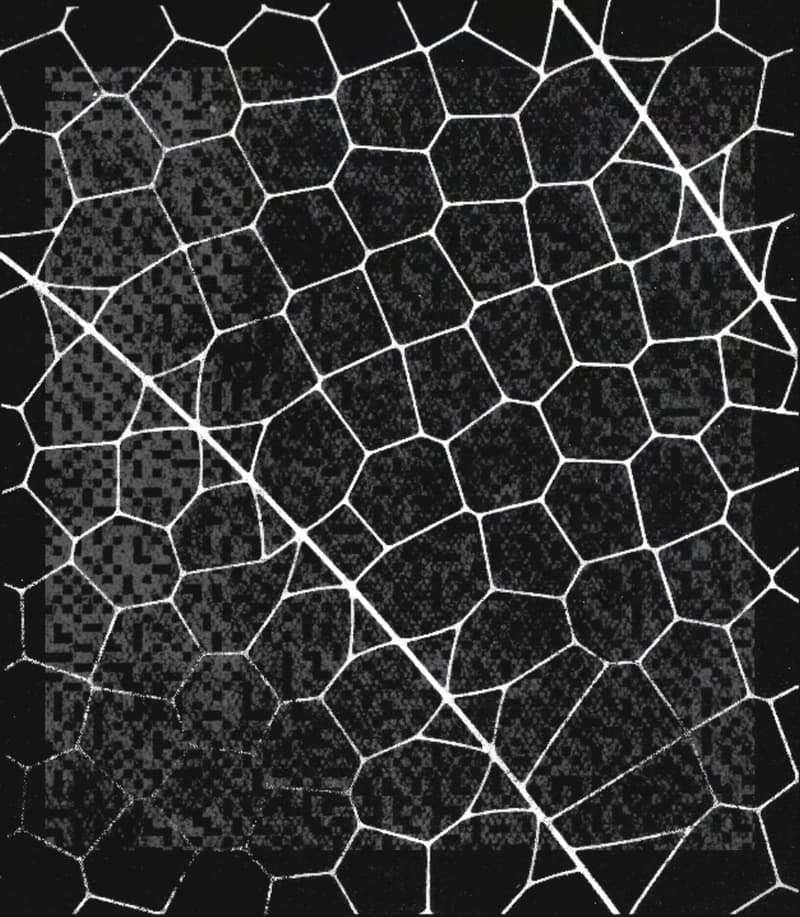

- LLM推論で重要なKVキャッシュを、光を用いて読み出す方式によりメモリ転送量(/負荷)を従来比16分の1に削減できるとする内容です。

- 通常の電子的なメモリ読み出しに代えて光学的な読み出し(光インターコネクト/フォトニクス系のアプローチ)を使うことで、データ転送ボトルネックを大きく緩和する狙いがあります。

- 対象はLLM(KVキャッシュ、推論時の再利用情報)であり、モデル側の学習ではなく推論システムの効率改善に直結するテーマです。

- 半導体/ハードウェア観点(タグにハードウェア・半導体)から、生成AIの性能・コストに影響しうる基盤技術の進展として位置付けられます。

- 投稿日時点での技術検証・示唆として、今後の推論アクセラレータ設計やメモリアーキテクチャに波及する可能性が示されています。

KVキャッシュを光で読んだらメモリ転送が16分の1になった

LLMの長文推論で何がボトルネックか。計算ではない。メモリ帯域だ。

Transformerのデコードステップでは、1トークン生成するたびにKVキャッシュ全体をスキャンする。コンテキスト長nに対してO(n)のメモリ...

Continue reading this article on the original site.

Read original →💡 Insights using this article

This article is featured in our daily AI news digest — key takeaways and action items at a glance.

Related Articles

Black Hat Asia

AI Business

v0.20.5

Ollama Releases

Inside Anthropic's Project Glasswing: The AI Model That Found Zero-Days in Every Major OS

Dev.to

Gemma 4 26B fabricated an entire code audit. I have the forensic evidence from the database.

Reddit r/LocalLLaMA

SoloEngine: Low-Code Agentic AI Development Platform with Native Support for Multi-Agent Collaboration, MCP, and Skill System

Dev.to