A Comparison of Reinforcement Learning and Optimal Control Methods for Path Planning

arXiv cs.RO / 4/15/2026

💬 OpinionIdeas & Deep AnalysisModels & Research

Key Points

- 自律走行を「脅威領域(円形のno-goゾーン)」を回避しつつ目的地へ到達させる経路計画問題として定式化し、従来の最適制御は計算時間が実リアルタイムに間に合わない点を課題として挙げている。

- DDPG(Deep Deterministic Policy Gradient)により、状態(位置・速度)から一連の実行可能な行動へ直接マッピングする学習ベースの制御を提案し、critic/actorの2つのニューラルネットと報酬設計で安全到達を目指す。

- DDPGが「安全な経路が保証される開始点の集合(feasible set)」を学習して、事前にタスク達成可能性を見積もれる点を、ミッション計画への有用な情報として示している。

- 擬似スペクトル法(伝統的な最適制御)と比較した結果、DDPGはより高速に有効な経路を生成できる一方で、到達不能な「infeasible set」も存在し、feasible set内でも経路が必ずしも最適とは限らない。

- 今後の方向性として、報酬関数の改善でfeasible setを拡大すること、擬似スペクトル法で得られるfeasible setの検証、arc-search IPMへの拡張を挙げている。

Related Articles

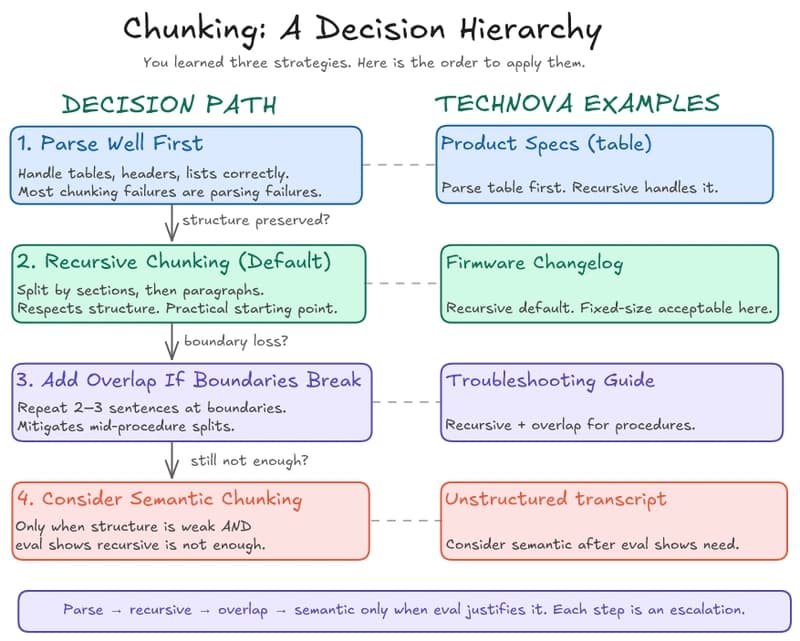

RAG in Practice — Part 4: Chunking, Retrieval, and the Decisions That Break RAG

Dev.to

Why dynamically routing multi-timescale advantages in PPO causes policy collapse (and a simple decoupled fix) [R]

Reddit r/MachineLearning

How AI Interview Assistants Are Changing Job Preparation in 2026

Dev.to

Consciousness in Artificial Intelligence: Insights from the Science ofConsciousness

Dev.to

NEW PROMPT INJECTION

Dev.to