7年前の Chromebook でローカルLLMは動くのか? Trillim + Ternary Bonsai を Crostini で試す

Zenn / 5/1/2026

💬 OpinionDeveloper Stack & InfrastructureSignals & Early TrendsTools & Practical Usage

Key Points

- 7年前のChromebook環境に対して、ローカルLLMが実際に動くかをCro stini上でTrillim + Ternary Bonsaiを使って検証する内容です。

- パフォーマンスや実行のしやすさなど、旧めのハードでも運用可能かという観点で試行結果を確認します。

- ローカル実行のための手順・前提(Crostini上での動かし方、必要な構成)に焦点が当たっています。

- 「軽量/ローカル向けLLM」を選ぶことで、低スペック端末でも使える可能性を示す実験的記事です。

- ローカルLLM導入の現実性を、実機に近い条件で確かめることで、導入検討者の判断材料になります。

!

2026/5/2更新

CLIチャットの様子、スロットリングの様子の動画を追加しました。

記事の概要

この記事は、Trillim v0.10.2 + Ternary-Bonsaiを、7年前のChromebook上のCrostini環境で動かした実機検証メモである。

高性能GPUや新しいPCを使ったローカルLLM環境ではなく、低消費電力CPU・8GB RAM・サーマル制約のある古いChromebookで、どこまでローカルLLMチャットが成立するかを確認した。

対象読者

GPUなしPCでローカルLLMを動かしてみたい人

古いChromebookや低消費電力PCの再活用に興味があ...

Continue reading this article on the original site.

Read original →Related Articles

Black Hat USA

AI Business

Can AI Predict Pollution Before It Happens? The Smart Solution to an Old Problem

Dev.to

THE FIFTH TRANSMISSION: THE GRADIENT IS THE GOVERNMENT

Reddit r/artificial

Looking for feedback on OpenVidya: an open-source AI classroom layer for NCERT/CBSE [R]

Reddit r/MachineLearning

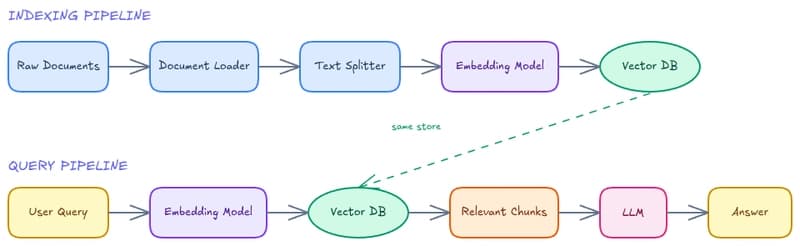

RAG Series (1): Why LLMs Need External Memory

Dev.to