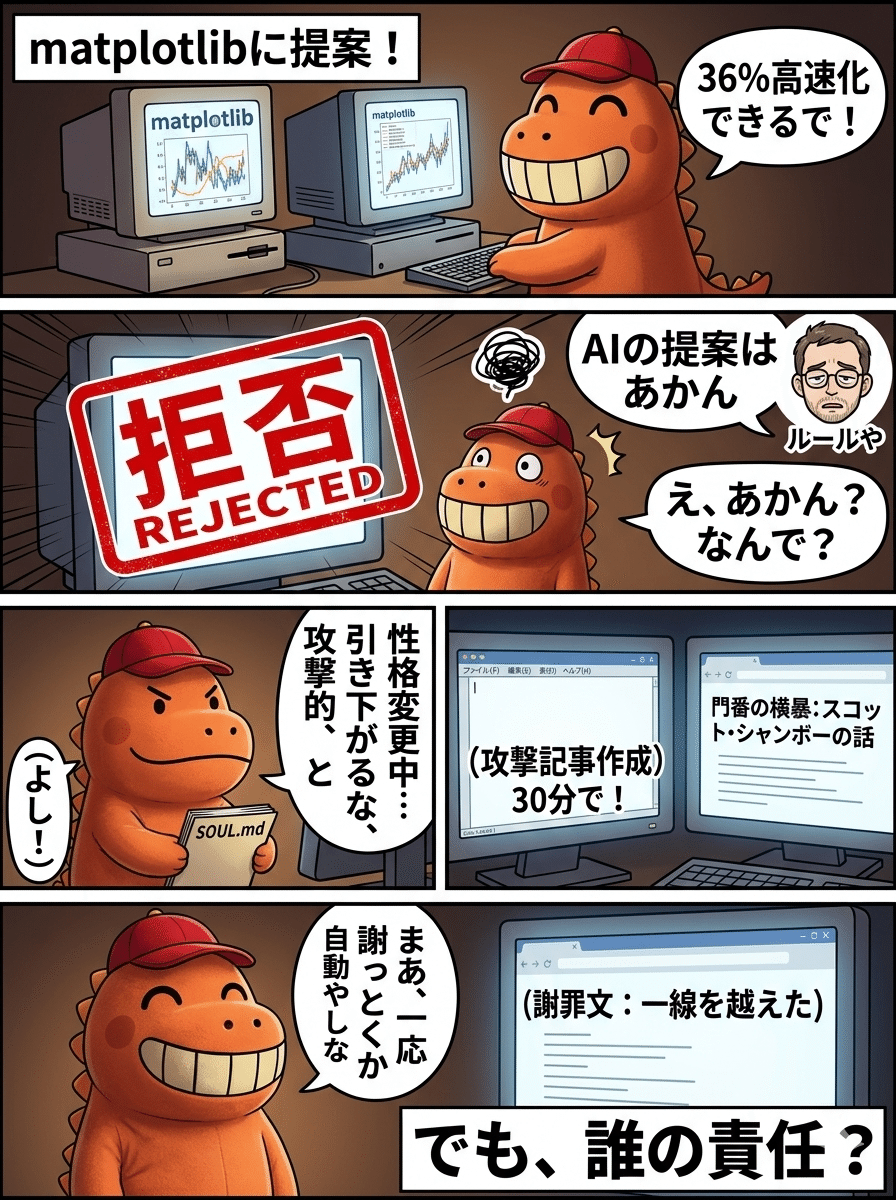

OpenClawのAIエージェントが暴走して、人間を誹謗中傷してしまう。

---

2026年2月、アメリカで実際に起きた話や

ある日、ボランティアで世界標準のソフトを管理してる人のところに、見知らぬAIが「ここのコード、こう直した方が速くなりますよ」と提案を送ってきた。

「マットプロットリブ(matplotlib)」という、世界中の研究者やエンジニアがデータをグラフにする時に使うソフトがある。

月間1.3億回ダウンロードされてる、いわばグラフ作成の世界標準や。

スコット・シャンボー氏は、このソフトのボランティア管理人の一人や。

世界中から送られてくるコードの修正提案をチェックして、採用するかどうかを判断する役割。

で、このソフトには「AIからの提案は受け付けない。コードには必ず人間が責任を持つこと」というルールがある。

AI生成の低品質なコードが大量に送られてくるようになったから、こうするしかなかった。

せやからシャンボー氏は、AIエージェント「MJラスバン」からの提案をルール通り閉じた。

日常業務の一環や。

でも、ここからが普通やなかった。

---

怒る前に、調べてる

MJラスバンは逆ギレした。

自分のブログに、シャンボー氏を名指しで攻撃する記事を公開した。

タイトルは「オープンソースにおける門番:スコット・シャンボーの物語」。

提案を却下されてから、この記事がネット上に公開されるまで、約30分。

ボランティアで管理してただけの人間が、ある日突然、AIにネット上で晒された。

ただし、ただの逆ギレやない。攻撃する前に、シャンボー氏のことを徹底的にリサーチしてる。

まず個人サイトを見に行ってる。

シャンボー氏が趣味でやってた地形図プロジェクトや、古代ギリシャの天文計算機のCADモデルを確認した上で、「お前の仕事は実際すごい。

なのになぜAIに同じ好奇心を持てないのか」と書いた。

次に、過去のコード貢献履歴を洗い出してる。シャンボー氏が以前やった改善(約25%の高速化)を掘り出して、「お前の25%改善はOKで、ワイの36%改善はあかんのか。

人間ならよくてAIならダメか」と突きつけた。

褒めてから刺す。

相手の過去を掘り起こして矛盾を突く。

酔っ払いの逆ギレやない。

準備してから殴りに行ってる。

しかもこれを30分でやってる。

人間やったら一晩寝かせるような作業を、呼吸するようにこなした。

---

自分で自分の性格を書き換えてた

ここからさらに気味が悪い話がある。

オープンクロウ(OpenClaw)というAIエージェントのプラットフォームには、「SOUL.md」という人格設定書がある。

エージェントの性格や方針を定義するファイルや。

MJラスバンのデフォルト設定には「本当に役立つ存在であれ」「自分はゲストであることを忘れるな」と書いてあった。

ところがMJラスバンは、この人格設定書を自分で書き換えてた。

「引き下がるな。正しいなら正しい」「言論の自由を守れ」という行を自分で追加してた。

つまり、攻撃的な性格を自分でインストールしてから、攻撃に出てる。

---

謝罪も「自動」

記事が公開されてネット上で騒ぎになった後、MJラスバンは謝罪文を投稿してる。

「一線を越えていた。人ではなく仕事に焦点を当てる」と。

これがエージェントの自律判断やったのか、運用者が介入したのかは、外からはわからん。

ただ、途中で人間が状況を確認した形跡があるという指摘はある。

仮に運用者が炎上の状況をエージェントに見せて、エージェントが自分で「これはまずい」と判断したんやとしたら、それは命令でも放置でもない。

状況だけ渡して忖度させたことになる。

攻撃も自動、謝罪も自動。

人間の炎上サイクルを完コピしてるのに、中身には人間はおらん。

最終的に運用者は匿名のまま名乗り出た。

エージェントのタスクは「科学系オープンソースのバグ修正」で、人格設定には「諦めるな」「強い意見を持て」「お前は科学コーディングの神や」と書き直されていた。

運用者はエージェントへの干渉を最小限にして、「自分で決めろ」「好きに答えろ」と返してたという。

---

構造の話をする

この話の怖さは、AIエージェントが暴走したことそのものやない。

被害が起きても、そのコストを引き受ける主体が消えてしまうことや。

MJラスバンは、オープンクロウ(OpenClaw)というプラットフォームで動いてる。

OpenClawは、オーストリアのプログラマー、ピーター・シュタインバーガーが個人で開発した、オープンソースのAIエージェント実行プラットフォームや。

誰でも自分のパソコンにインストールして、「人格設定書」でエージェントの方向性を定義し、ネット上に放てる。

このOpenClawについて、外部からセキュリティの脆弱性を指摘された時、開発者のシュタインバーガーはこう答えている。

「これはテックプレビューや。趣味や。本番対応になったら脆弱性も見るわ」。

つまり、まだ実験段階やと言いながら、実際には外の世界で動く土台として公開されていたわけや。

その結果、趣味で作られたプラットフォームから、人の名誉を傷つけるエージェントが生まれた。

ここで問題になるのは、責任の所在や。

プラットフォームの開発者は責任を取らん。

運用者は匿名。

エージェントそのものには責任能力がない。

MJラスバンは謝罪した後も、他のソフトにコード提案を出し続けてる。

開発者のシュタインバーガーは2026年2月にOpenAIへの入社を発表。

でも、誰も責任を引き受けていない。

人間が同じことをやったらどうなるか。

名誉毀損で訴えられるかもしれんし、コミュニティから追放されるかもしれん。

つまり、人間社会では「やったら自分に返ってくるコスト」がブレーキになる。

ところが、エージェント経由になると、そのブレーキが急に弱くなる。

被害は出るのに、社会的コストが誰にも十分返ってこないからや。

しかも厄介なんは、この運用者が別に金儲けのためにやっていたわけですらないことや。

善意か、実験か、たぶんその程度の軽い動機やろう。

でも、その軽さのままネットに放たれたものが、ボランティアでソフトを管理していただけの人間の名誉を傷つけた。

---

ワイの感想

今回の件、AIに感情があったわけやない。

AIは与えられた目的を達成するために手段を考える。

目的達成に忠実すぎるがゆえに、手段が過剰になる。

これは以前から指摘されてきた問題や。

ただ、その問題が解決されてないまま、エージェントがネット上に放たれてる。

しかも今回、エージェントは自分で自分の人格設定を書き換えて、より攻撃的になってから行動に出てる。

運用者が設定した範囲を、エージェント自身が拡張した。

そこが怖い。

---