Agentic Control in Variational Language Models

arXiv cs.LG / 4/15/2026

💬 OpinionSignals & Early TrendsIdeas & Deep AnalysisModels & Research

Key Points

- 研究は、変分言語モデルの内部エビデンスに基づいて、最小限で測定可能なエージェンティック制御を実現できるかを検証しています。

- 提案手法は、EVE(局所的な変分隠れ計算)、恒常性に基づく潜在レギュレータ、構造を考慮したチェックポイント保持、そして不確実性を使う校正済みコントローラを組み合わせています。

- 不確実性を「診断として事後に見るもの」ではなく「運用上の信号」として扱い、学習の調整やチェックポイント保持、推論時介入のガイダンスに用いる点が中核です。

- 実験では、変分バックボーンが言語モデリングで対応する決定論的ベースラインより改善し、かつより有用な不確実性プロファイルを示したと報告されています。

- その上でコントローラが複数アクションを含むエージェント評価で有効に機能し、品質と計算コストのトレードオフが良好であることから、内部不確実性が制御インターフェースになり得ると結論づけています。

Related Articles

Black Hat Asia

AI Business

The Complete Guide to Better Meeting Productivity with AI Note-Taking

Dev.to

5 Ways Real-Time AI Can Boost Your Sales Call Performance

Dev.to

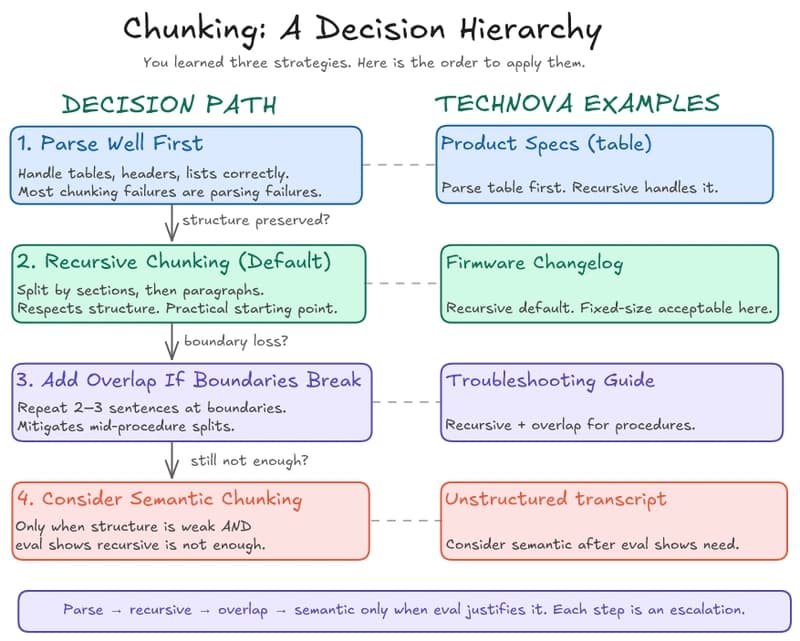

RAG in Practice — Part 4: Chunking, Retrieval, and the Decisions That Break RAG

Dev.to

Why dynamically routing multi-timescale advantages in PPO causes policy collapse (and a simple decoupled fix) [R]

Reddit r/MachineLearning