PAINT: Partner-Agnostic Intent-Aware Cooperative Transport with Legged Robots

arXiv cs.RO / 4/15/2026

📰 NewsSignals & Early TrendsIdeas & Deep AnalysisModels & Research

Key Points

- PAINT(Partner-Agnostic Intent-Aware Cooperative Transport)は、レッグドロボットが身体の内的センサ(proprioceptive feedback)から協働相手の意図を推定しながら、安定した移動と協調運搬を実現する階層型学習フレームワークを提案している。

- 意図理解(高位ポリシー)と地形に頑健な移動(低位のロコモーション基盤)を分離し、外部の力トルクセンサやペイロード追跡を使わずに軽量に運用できる点が特徴だ。

- 学習ではintent estimatorに基づく高位制御と、teacher-student方式を組み合わせ、複雑環境でも相互作用に伴う信号が捉えにくい課題に対処している。

- シミュレーションと実機実験で、多様な地形・ペイロード・パートナーに対するコンプライアント(柔軟で追従的な)協調運搬が示されている。

- decentralizedなマルチロボット運搬や、ロボット形態の違いによる移植性についても、ロコモーション基盤を差し替えることでスケール/転移できることを報告している。

Related Articles

The myth of Claude Mythos crumbles as small open models hunt the same cybersecurity bugs Anthropic showcased

THE DECODER

Claude Opus 4.7 vs 4.6: What Actually Changed and What Breaks on Migration

Dev.to

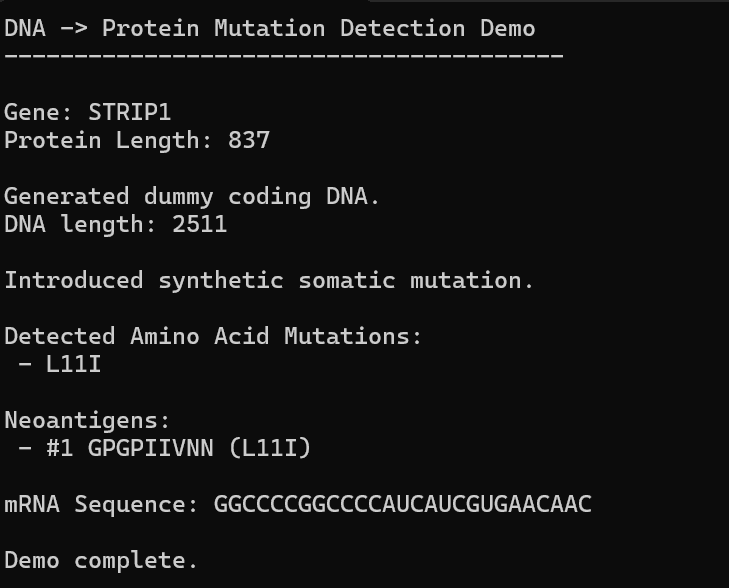

AI, Hope, and Healing: Can We Build Our Own Personalized mRNA Cancer Vaccine Pipeline?

Dev.to

The Hotel AI Visibility Crisis: Why AI Cites Review Sites More Than Your Own Website

Dev.to

Automate Your Literature Review: Build a Custom AI Pipeline

Dev.to