Unlocking Prompt Infilling Capability for Diffusion Language Models

arXiv cs.CL / 4/7/2026

💬 OpinionIdeas & Deep AnalysisModels & Research

Key Points

- 論文は、masked diffusion language models(dLMs)が通常のSFTで「response-only masking」により、プロンプトのマスク部分を埋めるinfilling能力が学習で封じられている点を指摘しています。

- 対策として、SFT時にpromptとresponseの両方を含めたfull-sequence maskingで学習する手法を提案し、infillingを可能にします。

- 様式化されたプロンプトテンプレートのマスク箇所を、few-shot例に条件付けして埋めることで、手設計テンプレートと同等以上の性能を示したと報告しています。

- infilledプロンプトはモデル間での転移性があり、既存のprompt optimization手法とも相補的であるとされています。

- 結論として、アーキテクチャの限界ではなく「学習/訓練手順」がmasked diffusion言語モデルのプロンプトinfillingを阻む主要ボトルネックだと主張しています。

Related Articles

Big Tech firms are accelerating AI investments and integration, while regulators and companies focus on safety and responsible adoption.

Dev.to

Could it be that this take is not too far fetched?

Reddit r/LocalLLaMA

npm audit Is Broken — Here's the Claude Code Skill I Built to Fix It

Dev.to

Meta Launches Muse Spark: A New AI Model for Everyday Use

Dev.to

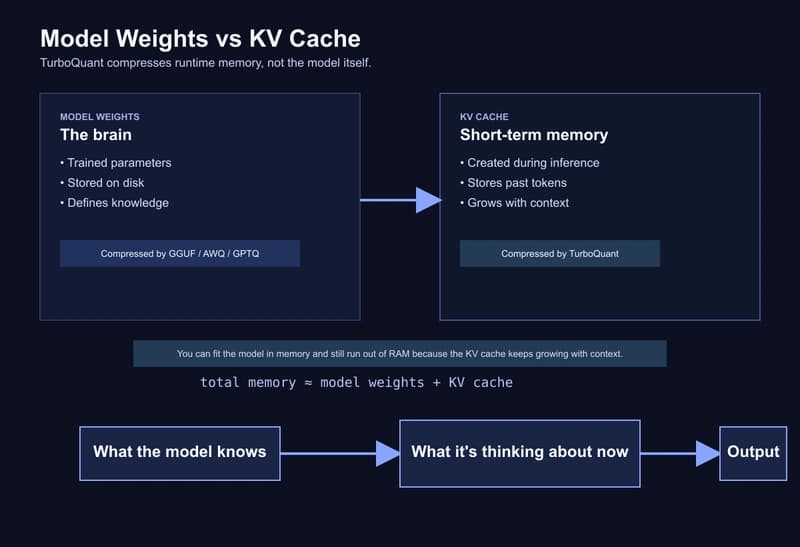

TurboQuant on a MacBook: building a one-command local stack with Ollama, MLX, and an automatic routing proxy

Dev.to