ChatGPTが自信満々に嘘をつく"本当の理由" — OpenAIの論文でわかってました

Zenn / 4/19/2026

💬 OpinionIdeas & Deep AnalysisModels & Research

Key Points

- ChatGPT(LLM)が自信満々に誤情報を提示する背景には、生成モデルの性質(もっともらしさの最適化)と限界が関係している点を論じています。

- OpenAIの関連論文の知見を手がかりに、「なぜ嘘のように見える回答が起きるのか」というメカニズムを説明しています。

- 単なる不具合ではなく、学習・推論の過程で“もっとも”に見える出力が優先されうることが、誤答の発生理由として整理されています。

- ユーザー側は、もっともらしさだけで真偽判断せず、検証や根拠確認を前提に運用すべきという示唆につながります。

米IT企業AIサイエンティストのこうじです。

この記事の内容は、インスタのリールで1分で解説しています。動画でサクッと知りたい方はこちらからどうぞ。

👉 インスタで1分解説を見る

いきなりですが、みなさん一度は経験ありませんか?

ChatGPTに質問したら、めちゃくちゃ流暢に、めちゃくちゃ自信満々に、完全な嘘を返された経験。

存在しない論文を教えてきたり、行ったこともないレストランを絶賛してきたり、誰かの経歴を勝手に盛ったり。しかも、聞き返しても一切動揺せず、堂々と嘘を重ねてくる。

「お前、なんでそんなに自信あんねん」と、画面の前で一人ツッコミを入れたこと、ありますよね。

で、今日お伝え...

Continue reading this article on the original site.

Read original →💡 Insights using this article

This article is featured in our daily AI news digest — key takeaways and action items at a glance.

Related Articles

Are we confusing Agent Execution Runtimes with true Agent Runtime Environments? [D]

Reddit r/MachineLearning

How to Debug AI-Generated Code: A Systematic Approach

Dev.to

Why production systems keep making “correct” decisions that are no longer right [D]

Reddit r/MachineLearning

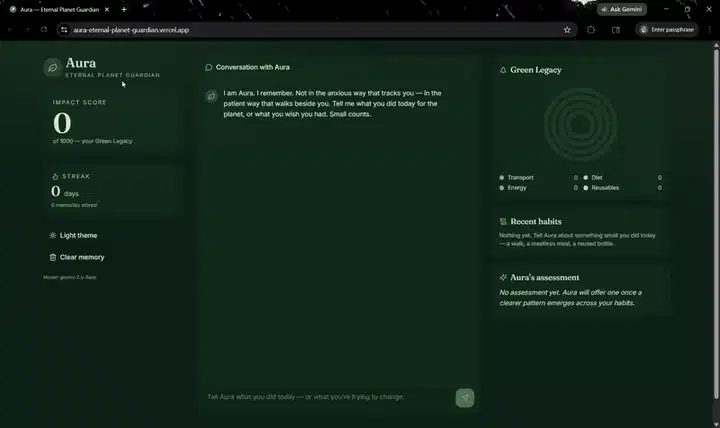

Every climate chatbot is amnesiac. So I built Aura — a stateful climate coach on Backboard + Gemini

Dev.to

Reducing LLM context from ~80K tokens to ~2K without embeddings or vector DBs

Reddit r/artificial