エッジから深度へ:ビジョン・トランスフォーマーにおける空間階層の解明

arXiv cs.CV / 2026/4/28

📰 ニュースModels & Research

要点

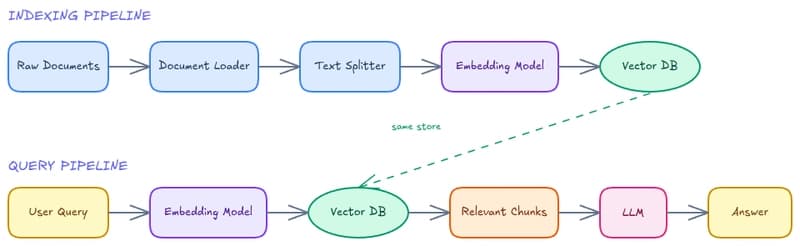

- この論文は、空間監督なしで事前学習されたビジョン・トランスフォーマー(分類学習のみ)が、空間構造をどこでどのように符号化するのかを調べます。

- BSDS500(局所の境界構造)とNYU Depth V2(パッチごとの深度)に対する層ごとのプロービングにより、階層性として、境界は層5〜6あたりで線形デコーダで読めるようになり、深度はより遅れて層8でピークを迎えることが示されます。

- 最終の分類層ではこれらの空間シグナルが崩れ、ランダム重みの対照実験から、符号化はモデル構造の偶然ではなく学習によって獲得されたことが示されます。

- 因果的介入(プローブの特定方向のアブレーションやアクティベーション・パッチング)により、深度の復元は学習された特定の方向に依存し、各層で部分的に再計算(再誘導)されること、そして中間層の介入ほど下流で強く残ることが示されます。

- 著者らは、分類学習されたViTが、霊長類の視覚皮質に見られる初期から後期への進行に似た空間階層を能動的に維持していると結論づけています。

関連記事

OpenVidyaのフィードバック募集:NCERT/CBSE向けのオープンソースAI教室レイヤー [R]

Reddit r/MachineLearning

RAGシリーズ(1):なぜLLMには外部メモリが必要なのか

Dev.to

「Open Source Project a Day」第54回:Warp - AIネイティブなRustターミナル

Dev.to

「One Open Source Project a Day (No.53)」pi-mono:ミニマル&高性能なAIコーディングエージェント

Dev.to

おすすめのオープンソース字幕生成は?Canary Qwen 2.5B+Whisper 完全ガイド

Dev.to