AI(人工知能)を導入しても組織が賢くならない根本原因は「データ」にある。人間向けの文書を単に蓄積するのではなく、人とAIが共に使える「判断資産」へとパラダイムシフトさせることが必要――と前回は解説しました。

今回から、この判断資産を作り上げるための具体的な「AIデータ設計」の手法を説明します。

まず大前提として、自社データを取り込んでAIに回答の根拠を与えるRAG(Retrieval-Augmented Generation:検索拡張生成)は、情報検索の効率化において一定の価値をもたらし、すでに一般的な仕組みとなりました。

しかし同時に、非構造化データをそのままRAGに放り込んでも、実用的な回答精度が出ないことは、多くの現場が痛感している事実です。RAGは強力なツールですが、それ単体では「初歩的ソリューション」に過ぎず、現場の高度な業務判断を自動化するには至りません。今後、自律的なAIエージェントを活用していくための「スタート地点」なのです。

以下では自律的なAIエージェントを活用していくための第一歩として、足元のテキストデータをAIが正しく理解できる状態にする「AI-Ready」化の基礎と、RAGの精度を引き上げる「コンテキストエンジニアリング」について解説します。

普及するRAGの落とし穴と「コンテキストエンジニアリング」の必要性

チューニングしても過去の提案書がAI検索に引っかからない理由

RAGは、ユーザーからの質問に対し、社内データベースから関連する文章を検索し、それをベースにAIが回答を生成します。このプロセスにおいて、文書はあらかじめ「チャンク」と呼ばれる小さな文章の塊に分割されています。

RAGを実行する多くの現場では「検索アルゴリズムやプロンプト、データを懸命にチューニングしているのに精度が上がらない」という悩みを抱えています。その原因の多くはAIの賢さではなく、「AIに渡すデータの品質」にあります。

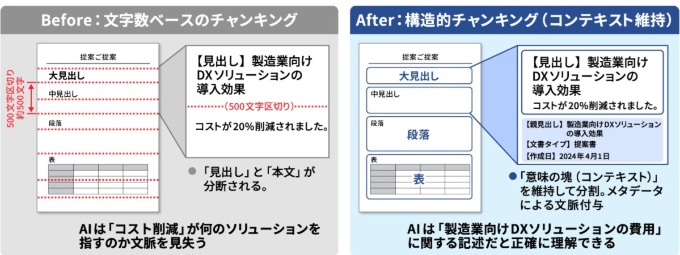

例えば、AIに「製造業向けDX(デジタルトランスフォーメーション)ソリューションの過去の提案事例を探して」と指示しても、的確な提案書が見つからないことがあります。原因は多くのツールが初期設定で採用している「文字数ベースのチャンキング」です。

「500文字ごとに区切る」設定では、文章の途中でチャンクが分割されます。「製造業向けDXの導入効果」という見出しと、「コストが20%削減されました」という本文が分断されれば、AIは「コスト削減」が何のソリューションを指すのか文脈を理解できません。細切れにされたデータは、主語と述語が切り離された意味不明な断片にすぎないのです。

文脈を壊さずにデータを分割する「構造的チャンキング」

この問題を解決し、RAGの精度を向上させるのが「構造的チャンキング」です。これは文字数ではなく文書の「意味的なまとまり(構造)」に着目して分割する手法です。

具体的には、見出しタグ(H1、H2など)や段落をプログラムで認識し、意味が完結する単位で分割します。これにより1つのチャンクの中に「見出し(テーマ)」と「本文(内容)」がセットで保持されます。

次のページ

重要なのは親階層の文脈を引き継ぐ処理この記事は会員登録で続きをご覧いただけます