ハイブリッド言語モデルにおけるコンポーネント対応の自己推測デコード

arXiv cs.CL / 2026/5/5

📰 ニュースDeveloper Stack & InfrastructureModels & Research

要点

- 本論文は、ハイブリッド言語モデル向けに「コンポーネント対応の自己推測デコード」を提案し、SSM/線形アテンションの内部サブグラフを“ゼロコスト”のドラフトとして利用します。

- Falcon-H1 と Qwen3.5 のハイブリッド構成で評価した結果、受け入れ率に大きな差が出ており、並列ハイブリッドでは α≈0.68(k=2、貪欲デコード)を達成する一方、逐次ハイブリッドは α≈0.038 と低いことが示され、コンポーネントの統合方法が重要であることが示唆されます。

- 提案手法はスケールに対して不変(スケール不変)で、Falcon-H1 では 3B が 0.5B と同様の受け入れ率を再現したと報告されています。

- さらに著者らは、推測デコードを実行せずとも、アブレーションに基づくパープレキシティ劣化の比率から“推測の実行可能性”を予測できることを示し、Falcon は高い α(例:k=4 で α≈0.37)に対応する一方、Qwen は低い α(例:α≈0.019)に対応すると報告しています。

- 逐次ハイブリッドでは、汎用の LayerSkip がコンポーネント対応の手法より約12×高い受け入れ率を示すため、最適戦略はハイブリッドの合成(構成)に依存することが示されます。

関連記事

キオクシア、27年にAI向け100倍速SSD 「NVIDIAから要望」

日経XTECH

無料で「ComfyUI」「Open WebUI」などからローカルAIモデルをGPUで動かすDocker環境を一発で構築し動かし続ける「Puget Systems Docker App Packs」

GIGAZINE

小売のチャージバック回収はAgentHansaの“本当のPMF”になり得る理由

Dev.to

RTX3090でQwen3.6 27B/35Bをローカル実行すると遅い・コードが壊れる——より良い設定と自動モデル切替を探す

Reddit r/LocalLLaMA

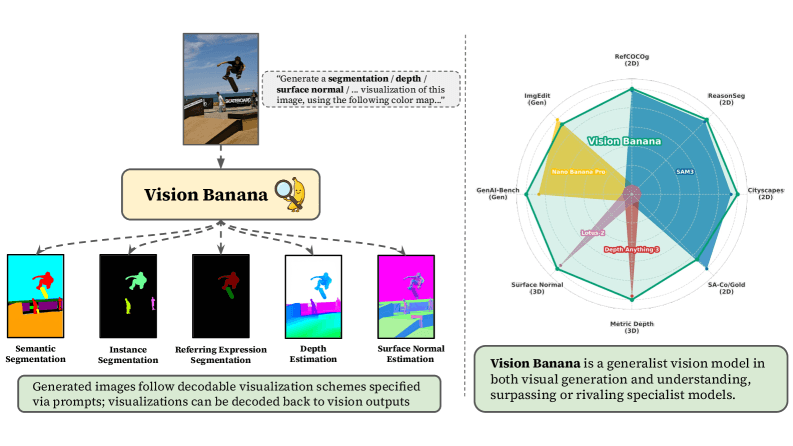

先週のAIまとめ #340 - OpenAI vs ムスク+マイクロソフト、DeepSeek v4、Vision Banana

Last Week in AI