2026年3月26日 - リンクブログ

Quantization from the ground up。Sam Roseは、情報量の多い見事なインタラクティブ・エッセイを公開し続けており、今回も彼の連載が続きます。大規模言語モデルの量子化がどのように機能するのかを説明しています(彼は「私がこれまで作った中で最良の投稿かもしれない」と言っています)。

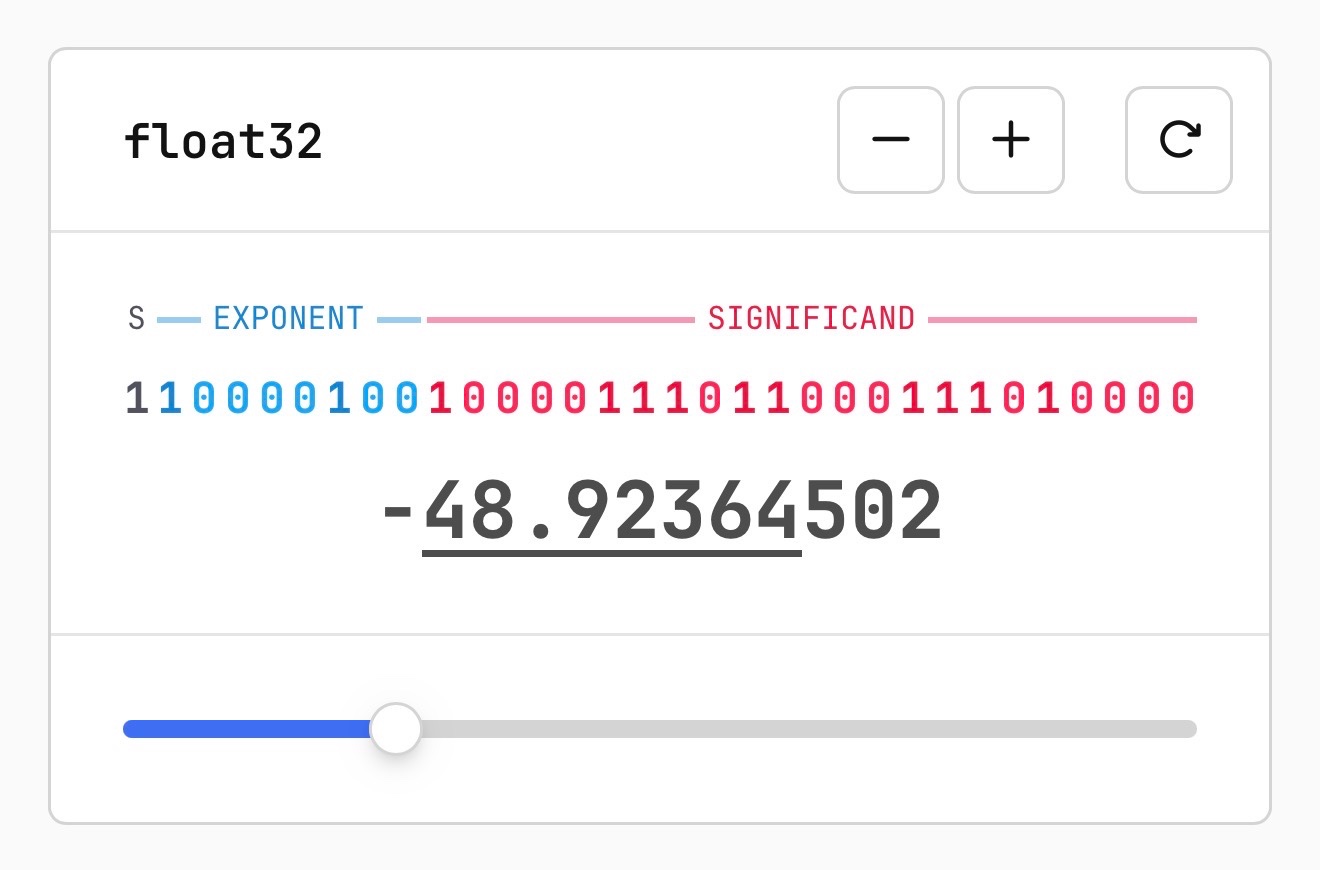

加えて、浮動小数点数が二進数を使ってどのように表現されるのかを、私がこれまで見た中で最も優れたビジュアルで説明しているのも含まれています。

量子化における外れ値(outlier values)のことは知りませんでした。これは通常のごく小さい値の分布の外側に存在する、まれな float の値ですが、どうやら非常に重要です:

なぜこれらの外れ値が存在するのですか?[...] tl;dr: 誰も決定的には分かっていませんが、これらの外れ値のごく一部は(非常に)重要で、モデル品質のための重要な要素になっています。「Appleがそう呼んでいる」たとえ1つの「スーパー・ウェイト」を取り除くだけでも、モデルが完全に支離滅裂な出力をしてしまうことがあります。

その重要性ゆえに、現実世界の量子化方式では、外れ値を保持するために追加の作業をすることがあります。たとえば、外れ値をそもそも量子化しない、あるいは、それらの位置と値を別のテーブルに保存し、その後それらを取り除いて、ブロックが壊れないようにする、などです。

さらに、量子化はモデル精度にどれほど影響するのか? というセクションもあります。Samは困惑度(perplexity)と** KLダイバージェンス **の概念を説明し、そのうえでllama.cpp の困惑度ツールとGPQAベンチマークの実行結果を使って、量子化レベルがQwen 3.5 9Bにどう影響するかを示しています。

彼の結論:

16-bitから8-bitへの変換は、ほとんど品質のペナルティがないように見えます。16-bitから4-bitだとより目立ちますが、それでも元のものの4分の1ほど良くない、というわけでは確実にありません。測り方によりますが、90%に近いところです。

最近の記事

- ClaudeスキルでStarlette 1.0を試す - 2026年3月22日

- コメントに基づいてHacker Newsユーザーをプロファイリングする - 2026年3月21日

- OpenAIがAstralを買収し、uv/ruff/tyを手に入れることについての考え - 2026年3月19日

これは、Simon Willisonによるリンク投稿で、2026年3月26日に掲載されました。

computer-science 15 ai 1932 explorables 30 generative-ai 1713 llms 1679 sam-rose 5 qwen 53月次ブリーフィング

$10/月でスポンサーになって、今月の最も重要なLLMの動向を厳選したメールダイジェストを受け取ってください。

少ない送信で済むように、私にお金を払ってください!

スポンサーになって購読する