要旨: 大規模言語モデル(LLM)の学習は、メモリ消費が非常に大きい。学習では、重みやオプティマイザ状態だけでなく、逆伝播のための中間活性も保存する必要があるためである。既存のメモリ効率化手法は主として勾配およびオプティマイザ状態に着目しているが、活性圧縮は、LLMに特化した理論や保証が欠如していることから、十分に確立されていない。本研究では、活性圧縮が「活性圧縮が偏りのない(unbiased)」場合に限り、線形作用素に対して安全である一方、非線形作用素に対しては問題が生じることを示す理論的枠組みを構築する。さらに、勾配分散の上界を導出し、標準的なL-滑らかさ(smoothness)仮定のもとで、全ての線形作用素に活性圧縮を適用する際の収束保証を確立し、これが収束率を変えないことを示す。理論に導かれて、低ランクの活性因子を再利用し、追加の計算や追加の勾配誤差なしに線形層の勾配を圧縮する、活性勾配の共同圧縮(activation-gradient co-compression)手法を提案する。事前学習ベンチマークおよび複数のファインチューニングベンチマークを用いて、QwenおよびLLaMAモデルに関する大規模な実験を実施し、理論を検証するとともに、精度と圧縮効率の両面で本手法が競争力のある性能を示すことを実証する。再現性のため、コードは補足資料に提供する。

LLMにおけるアクティベーション圧縮:理論解析と効率的アルゴリズム

arXiv cs.LG / 2026/5/5

📰 ニュースDeveloper Stack & InfrastructureModels & Research

要点

- 本論文は、LLM学習におけるアクティベーション圧縮を扱い、勾配やオプティマイザ状態の圧縮に比べて理論が十分でなかった点を踏まえ、LLM向けの理論と保証を新たに提示しています。

- 圧縮が線形演算子では「偏りのない」条件下で安全に機能しうる一方、非線形では問題が生じうることを示します。

- 勾配分散の上界を導出し、標準的なLスムーズ性の仮定のもとで線形演算子すべてに圧縮を適用した場合の収束保証を証明し、収束率は変わらないと結論づけています。

- その理論に基づき、低ランクのアクティベーション因子を再利用して線形層の勾配を圧縮する「アクティベーション勾配同時圧縮」を提案し、追加計算や勾配誤差の増加なしで圧縮できるとします。

- QwenとLLaMAで事前学習・微調整の複数ベンチマークにより、精度を保ちながら圧縮効率を改善できることを検証し、再現性のためにコードも提示しています。

関連記事

キオクシア、27年にAI向け100倍速SSD 「NVIDIAから要望」

日経XTECH

無料で「ComfyUI」「Open WebUI」などからローカルAIモデルをGPUで動かすDocker環境を一発で構築し動かし続ける「Puget Systems Docker App Packs」

GIGAZINE

小売のチャージバック回収はAgentHansaの“本当のPMF”になり得る理由

Dev.to

RTX3090でQwen3.6 27B/35Bをローカル実行すると遅い・コードが壊れる——より良い設定と自動モデル切替を探す

Reddit r/LocalLLaMA

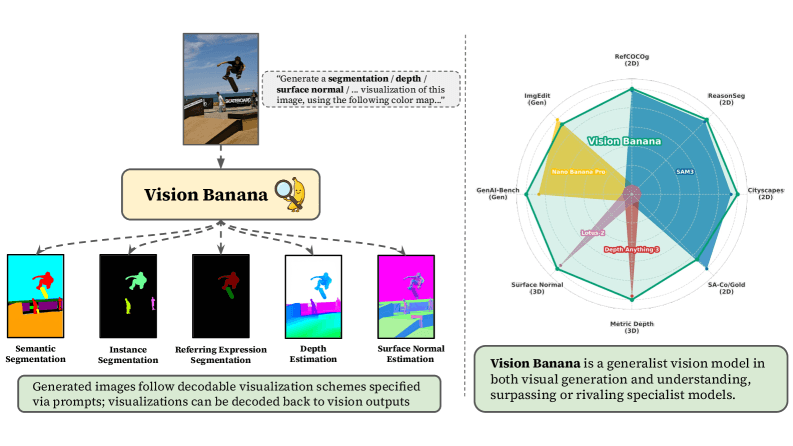

先週のAIまとめ #340 - OpenAI vs ムスク+マイクロソフト、DeepSeek v4、Vision Banana

Last Week in AI