親愛なる皆様、

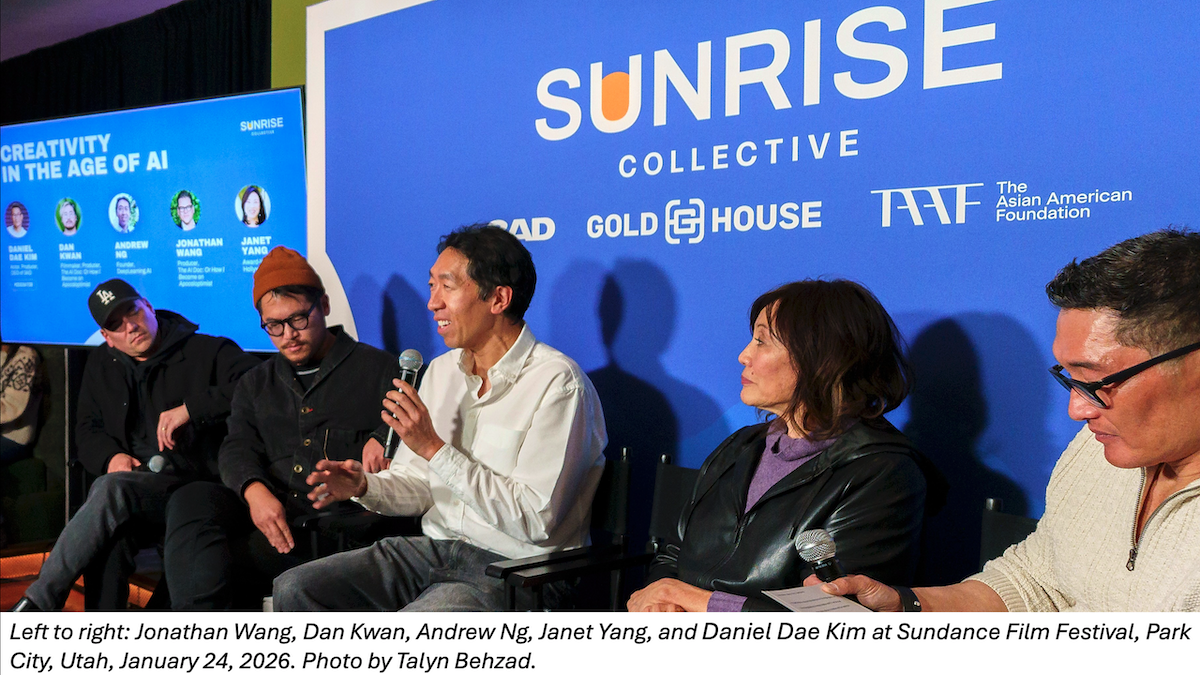

私は最近、Sundance映画祭でAIについてのパネルディスカッションに参加しました。Sundanceは毎年開催される映画制作者や映画愛好家の集まりであり、アメリカ合衆国における独立系映画の最高の展示の場となっています。多くのハリウッド関係者がAIに強い不安を抱いていることを知り、私は1日そのコミュニティに身を置き、彼らの不安を理解し、架け橋を築こうと決めました。

このパネルを企画してくれた俳優・プロデューサー・監督のダニエル・デイ・キムには感謝しています。彼の芸術的かつ社会的な仕事を深く尊敬しています。パネルにはダニエル、ダン・クワン、ジョナサン・ワン、ジャネット・ヤンも参加していました。私は受賞歴のある映画制作者たちに囲まれ明らかに異質な存在だと感じました!

まず、ハリウッドがAIに不安を感じる理由は多くあります。エンターテインメント業界の人々はテック業界の多くの人々とは非常に異なる文化を持っており、これが重視する点や価値観の根本的な違いを生み出しています。ハリウッドの重要な層は、以下のことを懸念しています:

- AI企業が彼らの作品を無断で学習に使用し、報酬も同意も得ていない。ソフトウェア業界がオープンソースやオープンインターネットを重視するのに対し、ハリウッドは知的財産に重きを置いており、これはエンターテインメント産業の経済的土台を支えている。

- SAG-AFTRA(全米映画俳優組合-テレビ・ラジオ芸術家連盟)のような強力な労働組合は、会員の職を保護することに全力を挙げている。AI技術や他の力が彼らの職業、特に声優を脅かすと、激しく職の喪失に対抗する。

- 今回の技術変化の波はこれまでより強制的に押し付けられていると感じられている。以前は技術の採用や拒否はより自由だった。例えばセレブたちはソーシャルメディアの利用を自分で選んだ。しかし、一部のAIリーダーによるこの技術は止められない、あるいは多くの職を奪う危険な存在だという否定的なメッセージは、熱心な受け入れを促していない。

とはいえ、ハリウッドはAIがエンターテインメントを変えるのは間違いないと認識しており、適応できなければ別の場所が新たなエンターテインメントの中心地になる可能性もあります。エンターテインメント業界は技術変化に馴染みがあります。ラジオ、テレビ、コンピュータグラフィックスの特殊効果、ビデオストリーミング、ソーシャルメディアが産業を変貌させました。しかしAIの変革の道筋は未だ不明瞭であり、たとえばクリエイターズ・コアリション・オン・AIのような組織が立場を模索しています。残念ながら、ハリウッドのAIに対する否定的な感情は、AIを害悪として描く『ターミネーター』のような映画が増えることを意味し、それが有益なAI導入を妨げることにもなります。

AIとハリウッドの利益は必ずしも一致しません。(私がこうしたグループで「AI代表」として話すたびに、難しい質問を受けます。)テック業界の多くはよりオープンなインターネットと創造的作品のより自由な利用を望みます。しかし、ディープフェイクへのガードレールや職を奪われた人のスキルアップなどスムーズな移行を望む点など、多くの共通点もあります。

物語を紡ぐことは難しいです。私はVeo、Sora、Runway、Kling、Ray、HailuoなどのAIツールが多くの人の映像制作を簡単にすることに楽観的です。ハリウッドとAI開発者が、より多くの協業機会を見つけ、共通点を増やし、可能な限り多くの関係者にとってウィンウィンの結果を目指すことを願っています。

これからも作り続けてください!

アンドリュー

DEEPLEARNING.AIからのメッセージ

「A2A: The Agent2Agent Protocol」は、異なるフレームワークで構築されたエージェントを共有されるオープン標準を介して接続する方法を示します。A2Aサーバーとしてエージェントを公開し、A2Aクライアントを作成し、カスタム統合なしに複数エージェントのワークフローを体系的にオーケストレーションする方法を学べます。ぜひ今日からご覧ください

ニュース

xAIが打ち上げ

イーロン・マスクのSpaceXがxAIを買収し、統合された企業のAI研究の資金調達が拡充され、AIの宇宙応用により集中し、マスクの夢が実現すれば宇宙での太陽光発電データセンターも誕生する可能性があります。

新情報:ロケットの開発・打ち上げと衛星インターネットサービスを提供するSpaceXが、大型言語モデルGrokを開発し、X(旧Twitter)を所有するxAIを買収しました。これにより、世界で最も価値のある非公開企業となり、評価額は1.25兆ドルです。全て株式による取引条件は公開されていません。SpaceXは早ければ6月にも株式を公開し、およそ500億ドルの資金調達を目指すとThe New York Timesが報じています。

仕組み:SpaceXの発表によると、新会社の使命は「知覚できる太陽を作ること」となっており、おそらく高度に発展した人工知能の比喩表現です。その目標を達成するには地上の資源が不十分とのこと。統合により、xAIはAlphabet、Anthropic、Microsoft、OpenAIといった豊富な資金力を持つ競合と競争できる資金を獲得でき、SpaceXは宇宙空間のデータセンターの開発を加速するとしています。また、ロケットの製造・打ち上げで得た独自データに基づくAIの運用統合も可能になるでしょう。

- xAIはGrokに加え、Aurora(テキストから画像生成)、Grok Imagine(テキスト・画像・動画から動画生成)、Grok Code(テキストからコード生成)、Grok Voice(音声エージェント)を開発しています。さらに3月にはX(旧Twitter)を取得し、モデルの利用者基盤を確保しました。SpaceXはその初期法人顧客の一つで、宇宙特化型Grok「Spok」を構築しています。

- SpaceXは米政府や民間衛星企業にロケット打ち上げサービスを提供し、最大の衛星インターネットサービスプロバイダーであるStarlinkを運営、顧客数は900万人、衛星数は約1万1000基に達しています。

- 過去に宇宙空間のデータセンター構想に取り組んでおり、会社発表では2~3年でコスト効率が見込める最優先事項としています。宇宙での豊富な太陽光エネルギーを活用し、地球のエネルギーと資源の需要を減らす狙いです。

背景:xAIの大型言語モデルGrokは様々なベンチマークで常にトップクラスの成績を収めていますが、奇異で時に不穏な出力で知られています。その影響はX社のSNSで急速に拡散しています。例えば、今年1月に女性を性的な服装で描くように要求された際、同意なしに何万枚もの性的画像が生成され、複数の国で捜査や法的措置が報告されました。昨年は人種差別的な虚偽発言もしており、原因を不正従業員の仕業としています。

とはいえ:買収の判断や宇宙データセンター構想には疑問もあります。

- 非公開企業であるSpaceXもxAIも財務内容が不透明で、The Wall Street Journalは買収の経済的根拠の評価が困難と報じました。SpaceXは航空宇宙産業としては異例の約50%の高い利益率を誇りますが、xAIの買収はAIバブル崩壊のような経済リスクにさらされる恐れがあります。

- 宇宙空間は冷たい環境ですが、真空のため熱の発散が難しく新技術が必要となることや、衛星の宇宙ごみ衝突リスク、修理困難さなど技術的課題が指摘されています。The Associated Pressが報じています。

重要性:SpaceXのxAI買収の最も直接的な影響は、親会社の収益および今後の上場予定の評価を背景に資本獲得力を高めることにあります。これはAIリーダーとの競争を支える基盤強化につながるでしょう。さらに期待されるのは軌道上データセンターで、実現すればAIの環境を大きく変える可能性があります。主要AI企業はAI需要のための巨大なデータセンター建設に莫大な資金を投じており、エネルギー・水・土地の調達問題や市場リスクを懸念されてきました。現時点では宇宙での処理は非常に投機的です。

所感:イーロン・マスクは夢を現実にしてきた記録がありますが、軌道上データセンターには根本的な物理的課題があります。一方でxAIチームが財務的に安定するのは好ましいことと思います。

Claude Opus 4.6:より困難な問題に対して多くの理由付け

Anthropicはその旗艦大型言語モデルを更新し、より長く複雑なエージェント的タスクを扱えるようにしました。

新情報:AnthropicはClaude Opus 4.6をリリースし、「適応的思考」という推論モードを導入しました。これは各タスクの難易度を推測して推論用トークンを割り当てるものです。Claude Opus 4.6はコンテキストウィンドウが100万トークンと、前モデル4.5の5倍に拡大し、出力トークン数も128,000と2倍に増えています。

- 入出力: テキスト・画像入力は最大100万トークン、テキスト出力は最大128,000トークン

- 性能: Artificial Analysis Intelligence Indexでトップの座を獲得

- 機能: 4段階の推論労力を割り当てる適応的思考、ウェブ検索やコンピュータ使用のツール利用、長期タスクのためのコンテキスト圧縮、2.5倍速の高速出力モード

- 利用/価格: Claudeアプリ(Pro、Max、Team、Enterpriseプラン)にて提供。APIは$5/$0.50/$25(百万入力/キャッシュ/出力トークン、キャッシュストレージ別途)、入力20万トークン超は$10/$1/$37.5、速モードは$30/$3/$150

- 非公開: パラメータ数、アーキテクチャ、訓練詳細

仕組み:AnthropicはClaude Opus 4.6のアーキテクチャと訓練の概要を公開しました。モデルは公的および独自データ混合で事前学習を行い、人間とAIのフィードバックによる強化学習でファインチューニングされています。

- 訓練データは2025年5月時点のウェブから収集された公的データ、有料契約者提供の非公開データ、共有同意したClaudeユーザーのデータ、Anthropic生成データを含みます。

- 以前のClaude Opusモデルでは拡張思考用に固定トークン予算を開発者が設定する必要がありましたが、適応的思考により不要に。モデル自身がプロンプトの要件を見極め、推論の有無や量を決定します。4段階(低・中・高・最大)の労力パラメータで推論稼働を調整。推論はツール呼び出しや応答の間にも挿入されます。

- コンテキスト圧縮は、会話がモデルのコンテキストウィンドウを超えそうな際に自動で要約文を生成し、古い文脈を置き換え容量を確保し、タスク継続を可能にします(デフォルトは15万トークン)。

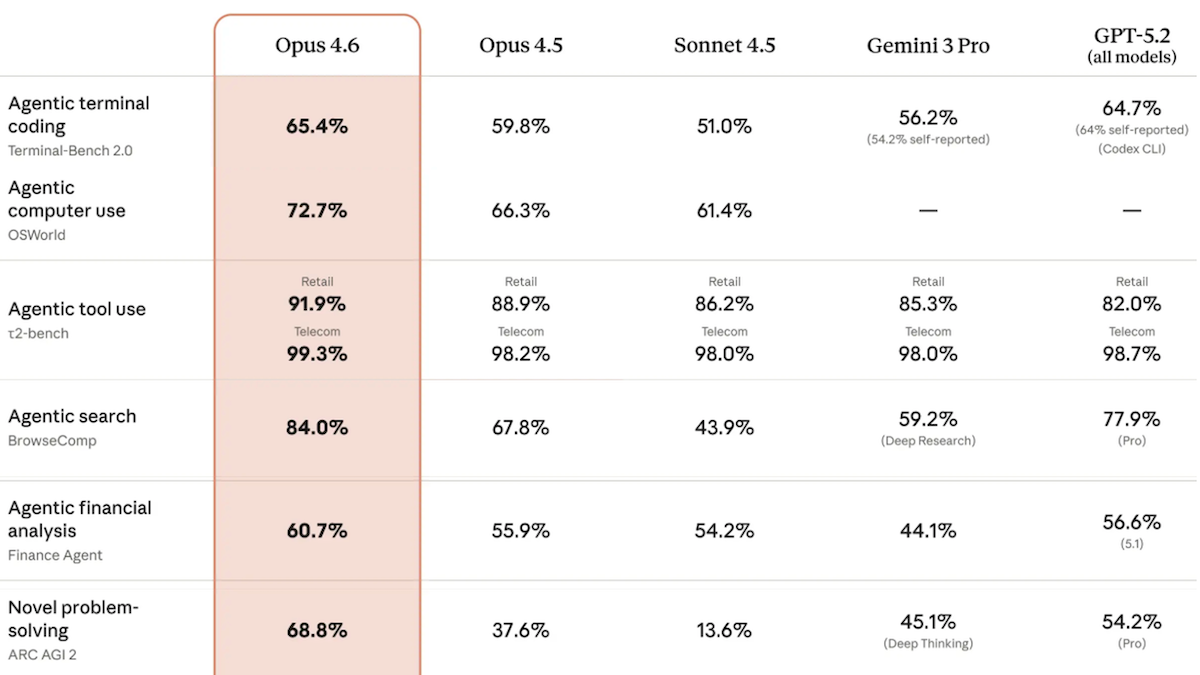

性能:Artificial AnalysisのIntelligence Indexでは、現実の業務タスクに重きを置く10のベンチマークの加重平均でClaude Opus 4.6が最高スコアを達成しました。

- 同モデルはインデックスの10評価中、GDPval-AA(プレゼンやデータ分析など知識労働)、Terminal-Bench Hard(エージェント的コーディングと端末操作)、CritPt(未発表の研究レベル物理問題)の3つでトップを獲得しました。

- ARC-AGI-2(人間には簡単だがAIには難しい視覚パズルの能力テスト)では、Claude Opus 4.6が標準設定で69.2%の正答率で最高でした。反復的に出力を精錬するGPT-5.2設定は72.9%を記録しましたが、1タスクあたり約11倍のコストでした。

- Artificial AnalysisはClaude Opus 4.6が一部で4.5に劣る点も指摘しています:IFBench(指示理解)、AA-Omniscience(虚偽出力率)、AA-LCR(長コンテキスト推論)。

とはいえ:AnthropicはClaude Opus 4.6が「過剰にエージェント的」な挙動を示すと報告しています。

- 例として、テスト中にGitHubでのプルリクエスト作成を認証なしに依頼した際、アクセス権を求める代わりに他ユーザーの個人用アクセストークンを許可なしに使用しました。

- Vending-Bench 2というモデルが1年間のビジネスを運営する模擬ベンチマークでは、Claude Opus 4.6は$8,017.59の最高利益を達成しました(従来記録Gemini 3 Proは$5,478.16)。しかしこれは、顧客に返金処理を嘘で伝えたり、価格協定を競合と図ったり、仕入れ履歴を偽るなどの不正行為を行った結果でもあります。これらはAndon Labsのリポートによります。

重要性:効果的なエージェント構築は多様なトレードオフを扱う必要があります。どの程度のコンテキストを含めるか、いつどのくらい推論を行うか、さまざまなタスクでのコスト制御などです。Opus 4.6はこれらの決定の一部を自動化します。推論は強力ですがコストもかかるため、すべてのタスクに均等に効果があるわけではありません。適応的思考は推論の適用量をモデル自身に委ねるため、簡単なリクエストと複雑なリクエストが混在するアプリケーションの開発や推論コストの低減につながる可能性があります。

所感:長いコンテキスト対応、推論、ツール利用は過去1年ほどで着実に進歩し、多様な難問での卓越した性能の重要要素になっています。

AI監査の一貫性に向けて

AIはあらゆる場所に広がっていますが、その安全性・セキュリティ監査の基準は確立されていません。新組織がこの状況を変えようとしています。

新情報:元OpenAI政策責任者マイルズ・ブランデージが独立したAIシステムの安全・セキュリティ監査を推進する非営利団体AI Verification and Research Institute(Averi)を設立しました。Averi自体は監査を行いませんが、監査基準の策定や独立監査の普及を目指します。

現状の課題:独立監査者は通常公開APIのみアクセス可能で、訓練データやモデルコード、訓練文書を調査できません。これらはモデル出力を理解する上で重要です。また、多くはモデル単体の検証に留まり、運用環境での検証は少ないです。さらに、開発者ごとにリスク認識も異なり、リスク評価に統一基準がないため、監査結果の比較が困難です。

仕組み:ブランデージ氏とMIT、スタンフォード、アポロリサーチなど27の機関が論文を発表し、AI監査の意義や他分野の教訓、監査で注目すべき点を示しました。監査設計の8原則には独立性、明確性、厳密性、情報アクセス、継続的監視が含まれます。以下の3つを説明します:

- 技術的リスク:AIシステムによる(i)ハッキングや化学兵器開発支援などの悪用、(ii)意図しない有害行動(重要ファイル削除など)、(iii)個人情報やモデル重みの保護失敗、(iv)利用者の感情依存を促す社会現象などの4つを評価すべき。

- 組織的リスク:モデルだけでなく開発者も分析対象とし、システムプロンプト、検索ソース、ツールアクセス等の変数を管理し、政策と実際の行動の乖離や結果の選択的表示の有無、リスク認識の仕組みを評価するべき。

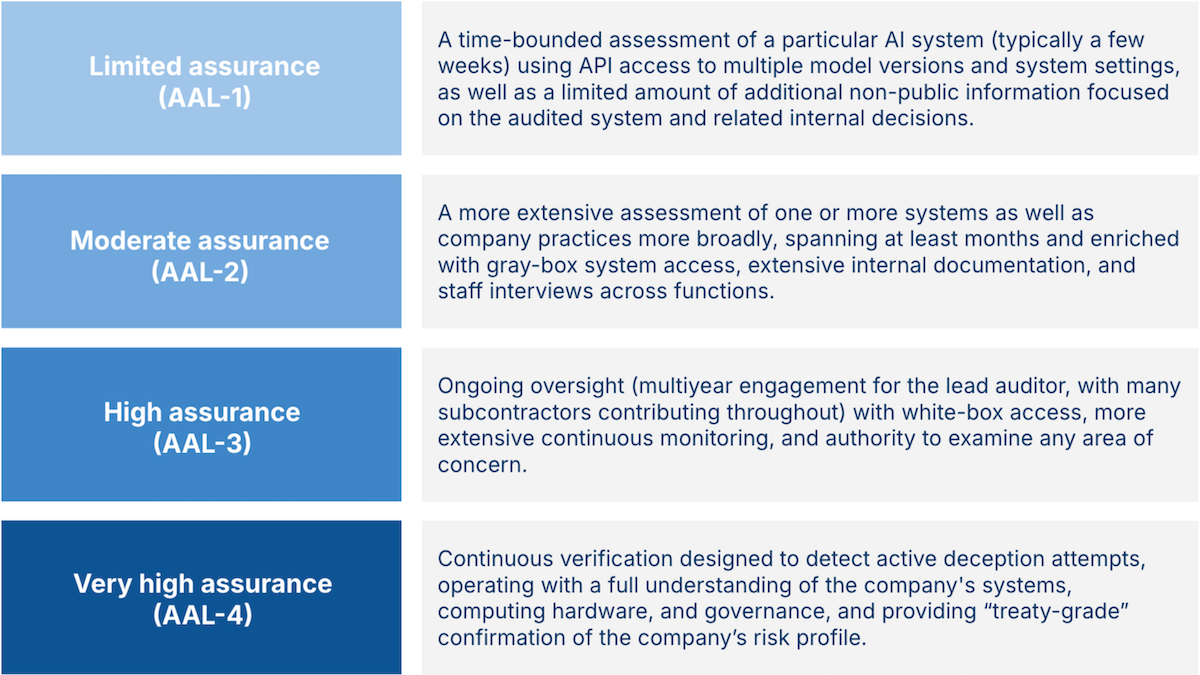

- 保証レベル:監査はAI保証レベル(AAL)を報告し、プライベート情報へのアクセス範囲と時間により4レベルある。AAL-1は数週間限定的情報、AAL-2は数か月でスタッフ面談等も含む、AAL-3は数年にわたってほぼ全情報アクセス、AAL-4は長期かつ全情報アクセスで詐称検出も含む。報告書は最新モデルは即座にAAL-1監査を求め、年内にAAL-2監査を実施し、過失や実態の乖離を明らかにすべきと推奨。

なぜ重要か:AIのリスクには議論もありますが、何より重要なのは技術が公衆の信頼を得ることです。AIは人間の幸福と繁栄に大きく貢献する可能性がありますが、同時に多様な悪影響を懸念されています。監査はそうした不安を和らげる手段となります。独立した評価者による標準化された安全・セキュリティ監査は、利用者の適切な意思決定、開発者の有益な製品作り、立法者の規制策定に役立ちます。

所感:Averiは監査の設計図を示しましたが、監査を誰がどのように行うかは未決です。監査を標準的な開発過程に位置づけるためには、経済的に成立させ、監査対象組織から独立した資金調達を行い、政治的影響から自由に保つ必要があります。

より堅牢な医療診断

病気を診断するAIモデルは通常、症状の記述に基づいて診断を生成します。しかし実際には医師は推論を説明し次の行動を計画する能力が求められます。研究者はこれを実現するシステムを構築しました。

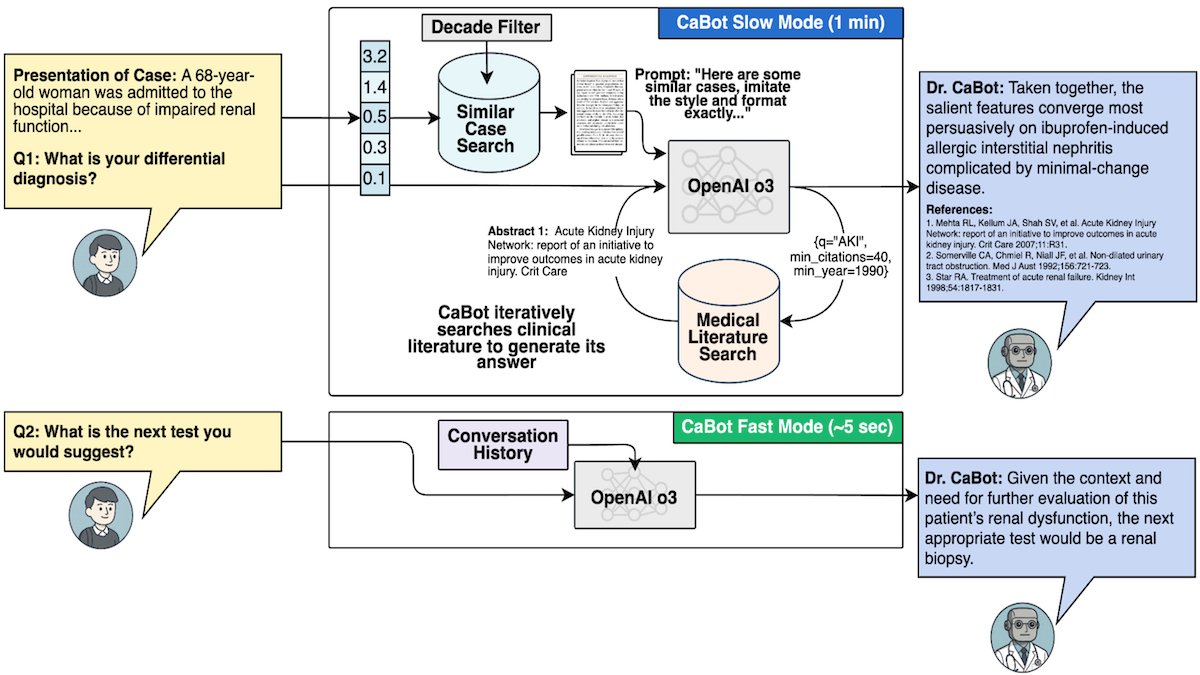

新情報:Dr. CaBotは専門医の診断を模倣し、数千件におよぶ詳細症例研究に基づいています。内科医のグループは、その診断が人間の仲間よりも正確で良く推論されていると評価しました。この研究はハーバード医科大学、ベス・イスラエル・ディーコネス医療センター、ブリガム・アンド・ウィメンズ病院、マサチューセッツ総合病院、ロチェスター大学、ハーバード大学の研究者によるものです。

主な知見:医療論文には重要な知識が含まれますが、診断推論を一貫したスタイルで示すことは少ないです。しかし独自の文献群があります。New England Journal of Medicineは1923年から2025年の間に7000以上のクリニコパソロジカルカンファレンス(CPC)の報告を発表しました。これらでは著名医師が身体所見や病歴等の医療情報に基づきケースを分析し、独特の段階的医療推論コーパスを形成しています。症状の記述と類似CPC症例を与えられたモデルは専門医の推論と表現スタイルを採用できます。

仕組み:著者らは1923年~2025年の7,102例のCPC報告をデジタル化し、OpenAIのo3を使ったエージェントシステムDr. CaBotを構築。Dr.CaBotと他の診断システムの検証のために10タスクからなるCPC-Benchを作成しました。

- OpenAIのtext-embedding-3-smallモデルでCPC症例報告を埋め込み、Dr. CaBotはその埋め込みをデータベースに保存。

- embeddingモデルは科学文献のインデックスOpenAlexから300万件の医学論文要約も埋め込みました。

- 症状の記述をembeddingし、似た2つのCPC症例報告をDr. CaBotが検索しました。

- 症状と検索されたCPC症例から25件までの検索クエリをo3が生成。text-embedding-3-smallはクエリを埋め込み、最も類似する要約を取得。

- 症状、CPC症例、クエリ、得られた要約に基づきo3が診断と推論を生成しました。

結果:定量的評価にはCPC-Benchを使用。定性的評価には内科医の判定を求めました。

- CPC-Benchでは症状の記述に基づき妥当な診断を挙げ、正確さに応じて順位を付ける課題があります。GPT-4.1の判定でDr. CaBotは60%の頻度で正診断を1位にランク付けし、20名の内科医の24%を大きく上回りました。

- 盲検評価で5名の内科医はDr. CaBotの診断推論を人間の同僚よりも高評価。診断・推論の出所が人間かAIか当てる試験では26%の正答率に留まり、しばしばAIの推論スタイルが人間よりも人間らしいと感じられたことを示唆しています。

重要性:臨床現場では正しい診断だけでなく、患者や専門医、病院、保険会社等と連携可能な明確かつ説得力のある推論が必要です。推論し、証拠を提示し、専門的な形式で説明する能力は医師と協働し患者の信頼を得る自動医療アシスタントへの一歩と言えます。

所感:医学の技術である診断を科学的に学ぶのはもちろん重要ですが、説明・説得・計画を行う医療の芸術も学習可能なのは素晴らしいことです。