要旨: 低ランク適応(LoRA)は、現在、大規模言語モデルのパラメータ効率の高い微調整において支配的な手法となっている。しかし、高品質なアダプタを得るには、LoRAの性能が設定の選択に非常に敏感であるため、体系的なハイパーパラメータ調整を要することが多い。実際には、これにより多くの同時LoRAジョブが発生し、マルチテナント環境ではしばしば異種のタスクにまたがることになる。既存のシステムはこれらのジョブを概ね独立に扱っており、弱い候補に対して計算を浪費するだけでなく、GPUの活用度も低いままとなる。私たちはALTO(Adaptive LoRA Tuning and Orchestration)を提示する。これは、LoRAのハイパーパラメータ調整を加速しつつ、異種タスクにまたがるクラスタ共有を効率的に可能にする共同設計の学習システムである。ALTOの中核となる洞察は、共有された固定化バックボーン上で複数のチューニングジョブが同時に実行されると、単一ジョブ設計では活用できない最適化機会が露出する、という点にある。これを踏まえ、ALTOは損失の軌跡を監視して有望でない設定を早期に打ち切り、さらに新しい「ランクローカル」アダプタ並列性と融合したグループ化GEMMを用いて、生き残ったアダプタを同一箇所に配置して解放されたGPU容量を取り戻し、LoRAジョブの予測可能な実行時間を活かして、タスク内スケジューリングとタスク間スケジューリングを組み合わせることでマルチタスク配置を改善する。大規模な評価により、ALTOはアダプタ品質を損なうことなく、最先端手法に対して最大13.8\timesの高速化を達成することが示されている。

ALTO: 異種LoRAトレーニングワークロード向けの適応的LoRAチューニングとオーケストレーション

arXiv cs.LG / 2026/4/8

💬 オピニオンDeveloper Stack & InfrastructureModels & Research

要点

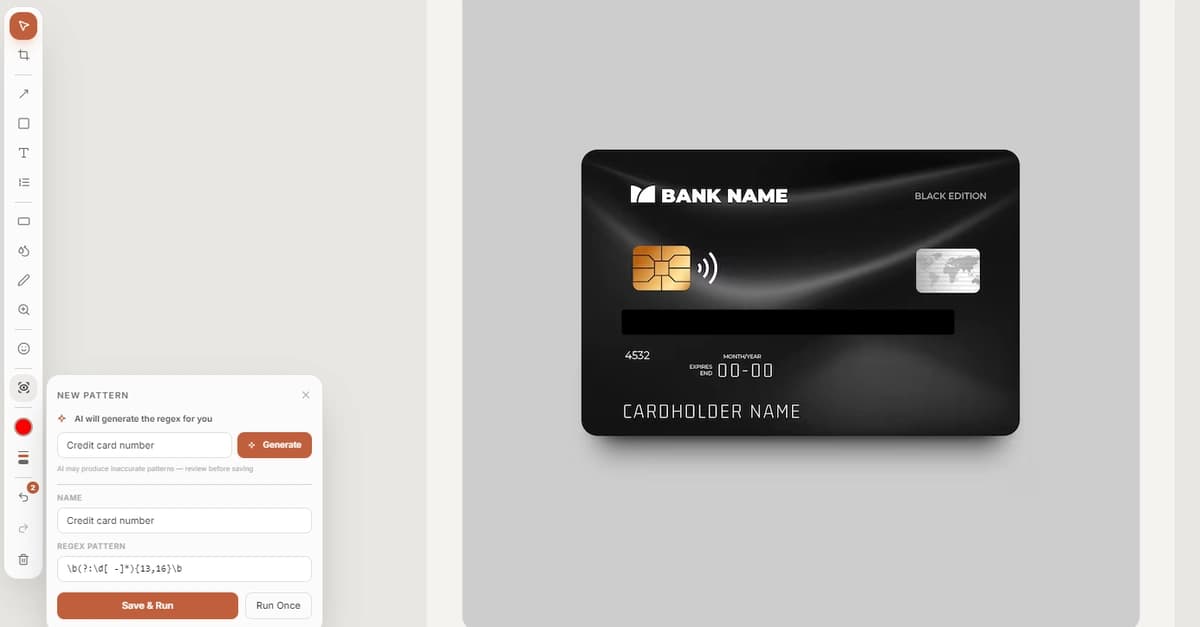

- ALTOは、LoRAによるパラメータ効率の高いファインチューニングのためのトレーニングシステムとして提示されます。特にマルチテナントで異種なワークロードでは、広範なハイパーパラメータチューニングが高コストになるという課題に対応します。

- 各LoRAジョブを個別に扱うのではなく、ALTOは、複数の同時チューニングジョブが同じ凍結済みLLMバックボーンを共有することで生まれる最適化の機会を活用します。

- このシステムは損失曲線を監視して弱いハイパーパラメータ構成を早期終了し、さらに、融合されたグループ化GEMMと新しいランクローカルアダプタ並列性を用いて有望なアダプタを共配置し、GPU容量を再回収します。

- ALTOはまた、タスク内スケジューリングとタスク間スケジューリングを組み合わせ、LoRAジョブの所要時間が予測可能であることを活かして、複数のタスクを共有クラスタ資源上により良く配置することを可能にします。

- 報告されているALTOの実験では、アダプタの品質を維持しつつ、最先端手法に対して最大13.8倍の高速化が示されています。