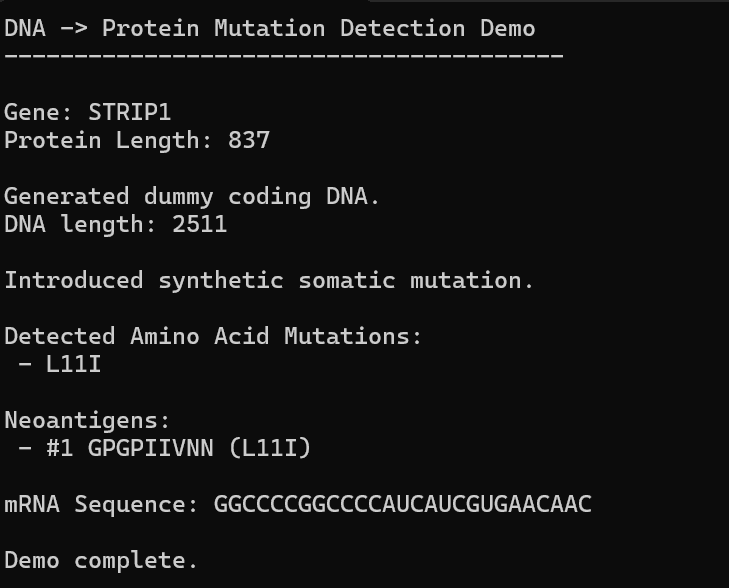

Cloudflare は、出力精度を犠牲にせずに LLM のサイズを 15〜22% 削減する可逆圧縮システム「Unweight」を公開しました。

Meta の Llama-3.1-8B では、このツールが Nvidia H100 GPU 上で MLP の重みを圧縮することで、およそ 3 GB の VRAM を節約します。

Cloudflare は GitHub で GPU カーネルをオープンソース化し、技術論文を公開しました。圧縮を注意(attention)の重みにも拡張する計画があります。

[link] [comments]