「ChatGPT」の回答で「ゴブリン」の比喩が増殖――そんな珍事件のメカニズムを米OpenAIが突き止めた。原因はChatGPTの人格カスタマイズ機能を作る上での学習過程で、モンスターの名前の出力を高く評価し過ぎたためだった。

発端になったのは、ChatGPTの人格設定の一つ「Nerdy」(オタク)だ。ChatGPTのユーザーは好みの返答スタイルを幾つかの人格から選択でき、オタク人格は知的で遊び心のある文体を促す設定だ。オタク的表現は全回答の2.5%に過ぎなかったが、ゴブリンを含む表現の66.7%をオタク的表現が占めていたという。

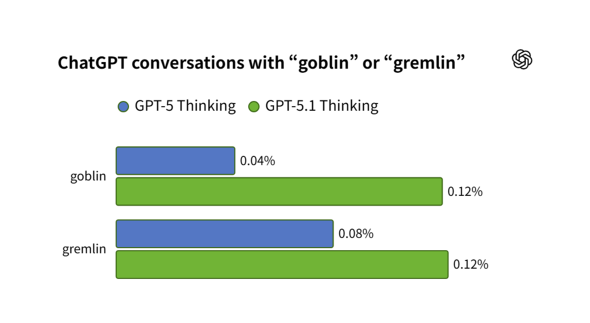

OpenAIが強化学習中の出力を調べたところ、ゴブリンや「グレムリン」を含む回答は、オタク人格の学習において高く評価されやすかった。それにより、「GPT-5.1」では「GPT-5」と比較して、ChatGPTの回答に含まれるゴブリンの使用は175%、グレムリンは52%増加していたという。さらに、その評価がその後の学習にも影響を与えたことで、「GPT-5.4」や「GPT-5.5」の回答でもゴブリンやグレムリンが増加した。

OpenAIは3月にオタク人格を廃止し、学習時に生き物の比喩を好む設定を取り除いた。生き物を表す単語を含む訓練データもフィルタリングした。

ただし、GPT-5.5は原因特定前に学習が始まっていたため、「Codex」でのテスト時にも同様の傾向が見つかった。そこでOpenAIはCodex向けに、明確に関連がある場合以外はゴブリンなどの生き物の比喩を使わないよう、開発者プロンプト内に抑制する指示を追加した。

Copyright © ITmedia, Inc. All Rights Reserved.

続きを読むには、コメントの利用規約に同意し「アイティメディアID」および「ITmedia AI+メールマガジン」の登録が必要です