要旨: 推測(speculative)デコーディングは、小さなドラフトモデルを用いて、対象モデルが検証すべき k 個の候補トークンを提案させることで、LLM 推論を高速化します。同一トークナイザの組において、高帯域幅の GPU では有効である一方、トークナイザが一致しないクロスファミリの組や、コンシューマ向けの統合メモリ(unified memory)に対する適用可能性は、十分に調査されていません。我々は、Apple Silicon 上でクロス・トークナイザの推測デコーディングを可能にするために、MLX-LM フレームワークを Universal Assisted Generation (UAG) で拡張します。対象モデルとして Bielik 11B-Instruct(Mistral ベース)を評価し、ドラフトモデルとして 3 つのモデルを組み合わせます:Bielik 1.5B(カスタムトークナイザを備えた Qwen ベース)、Qwen2.5-1.5B、Llama 3.2-1B。3 つのポーランド語データセット(Wikipedia、pl_alpaca、合成)で、ドラフト長 k ∈ {2, 4, 6} を用いて、素朴なトークン翻訳と文脈に基づく(context-aware)トークン翻訳を比較します。結果は次のとおりです:(1) 文脈に基づく翻訳は、すべての構成において一貫して受理率(acceptance rates)を改善します;(2) ポーランド語に特化した Bielik 1.5B は、汎用の Qwen2.5 や Llama 3.2 のドラフタよりも低い受理を達成します;(3) Apple Silicon 上でのスループットはコンテンツ依存であり、構造化テキストでは 1.7x の高速化に到達する一方、バラエティに富む指示では失敗します;そして (4) 統合メモリにおける検証コストは、理論どおりにはならず減衰(償却)されません。両モデルがメモリ帯域幅(memory-bandwidth)に律速されるため、まとめて検証するのに比べて、逐次的なドラフティングは高コストになるからです。ハードウェアを考慮した高速化のための数式を提案し、Apple Silicon 上でのクロスファミリ推測デコーディングの条件を特徴づけます。これは、ポーランド語 LLM に対するクロスファミリ推測デコーディングの最初の体系的評価であり、統合メモリアーキテクチャにおける UAG ベースのデコーディングに関する最初の実証的研究です。

Appleシリコン上でポーランド語LLM向けにクロスファミリー推測デコーディングを行うための実証評価:UAG拡張MLX-LMでのBielik 11B

arXiv cs.CL / 2026/4/21

📰 ニュースDeveloper Stack & InfrastructureModels & Research

要点

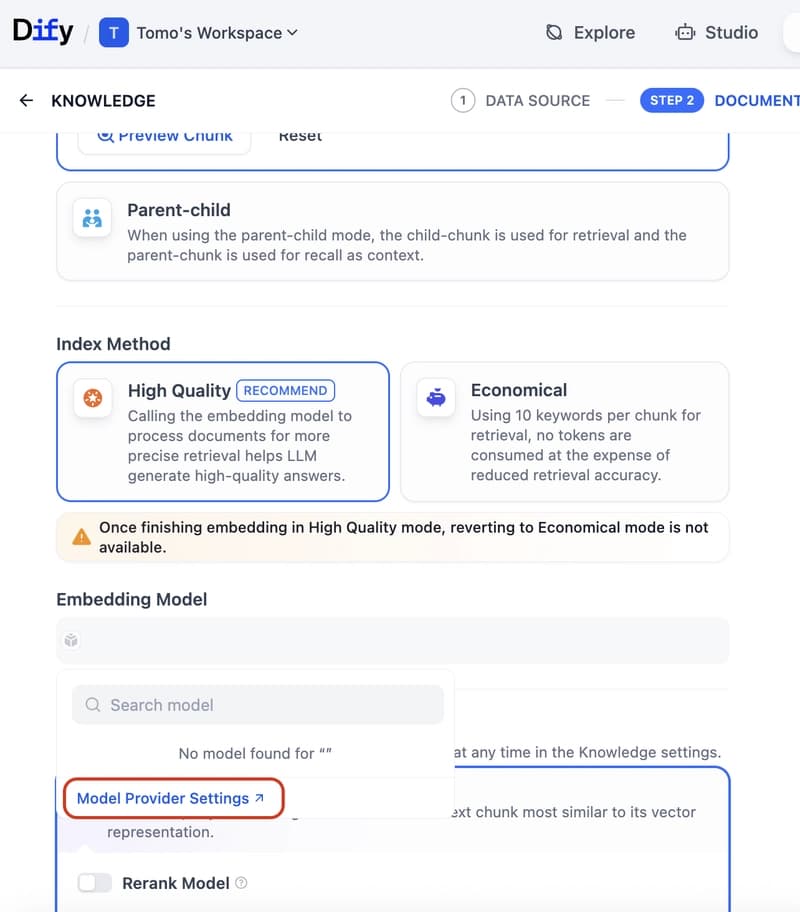

- 本論文はMLX-LMにUniversal Assisted Generation(UAG)を拡張し、Appleシリコン上で異なるトークナイザ同士でも推測デコーディングを可能にしている。

- 対象モデルにBielik 11B-Instruct(Mistralベース)を用い、Bielik 1.5B・Qwen2.5-1.5B・Llama 3.2-1Bの3種類のドラフトモデルを組み合わせて、k={2,4,6}のドラフト長をポーランド語データセット(Wikipedia、pl_alpaca、合成)で評価する。

- 文脈を考慮したトークン変換は全構成で受理率を一貫して改善するが、ポーランド語特化のBielik 1.5Bドラフタは一般用途のQwen2.5やLlama 3.2より受理率が低い。

- Appleシリコンでのスループット向上は入力内容に依存し、構造化テキストでは最大約1.7倍の高速化が見られる一方、指示が多様な場合は性能が落ちる。

- 検証コストの理論的な償却が成立しない理由として、両モデルがユニファイドメモリ上でメモリ帯域制限により律速されることを示し、ハードウェアを踏まえた速度向上の条件と式を提案している。