| Neo AI Engineer を使い、llama-cpp-python で BF16、Q4_K_M、Q8_0 の 3 つの GGUF 量子化バリアントにおける Qwen 3.6 27B を評価しました。 使用したベンチマーク:

総サンプル数:

結果: BF16

Q4_K_M

Q8_0

際立った点: Q4_K_M は、この中では最も実用的なバリアントのように見えます。BFCL は BF16 とほぼ同じまま、HumanEval では約 5.5 ポイント落ちますが、HellaSwag では BF16 に対してまだ 4 ポイントしか遅れていません。 そのトレードオフはかなり良好です:

この実行では Q8_0 は少し物足りない結果でした。HumanEval は Q4_K_M より約 1.8 ポイント改善しましたが、RAM は 28 GB ではなく 42 GB 使用し、さらに遅くなりました。この評価では HellaSwag においても Q4_K_M よりスコアが低いです。 ローカル/CPU デプロイをするなら、おそらくワークロードがコード生成に大きく偏っていない限り、Q4_K_M を選ぶと思います。最大品質を狙うなら、BF16 が依然として勝ちます。 評価設定:

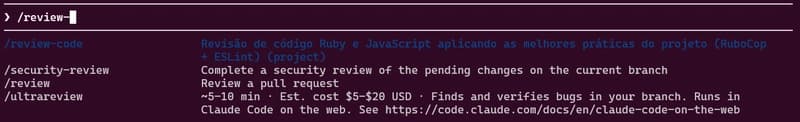

この評価は Neo AI Engineer を使って行いました。これにより、GGUF の評価セットアップの構築、チェックポイント付きの実行の処理、ベンチマーク結果の統合が行われました。結果についても私は手動で確認しました。 下記のコメントに記載の、ベンチマーク結果、アプローチ、コードスニペットを含む完全なケーススタディ [link] [comments] |

Qwen 3.6 27B:BF16とQ4_K_M、Q8_0のGGUFを評価(llama-cpp-python)

Reddit r/LocalLLaMA / 2026/4/28

💬 オピニオンDeveloper Stack & InfrastructureTools & Practical UsageModels & Research

要点

- この記事は、Neo AI Engineer による llama-cpp-python を用いた評価として、Qwen 3.6 27B の BF16 と GGUF 量子化版(Q4_K_M、Q8_0)の性能を比較しています。

- HumanEval、HellaSwag、BFCL(ファンクションコーリング)において、BF16 が総合的に最良の精度を示す一方、Q4_K_M は実用面でより近い代替手段になっています。

- Q4_K_M は BF16 とほぼ同等の BFCL スコア(63.0〜63.25%)を保ちながら、ピークRAMを 54GB(BF16)から 28GB に削減し、モデルファイルも 16.8GB に縮小しています。

- 今回の実行では Q8_0 は振るわず、Q4_K_M より遅く、ピークRAMも多く消費しつつ、HumanEval でわずかに改善があるものの HellaSwag は低い結果でした。

- ローカル/CPU 配備では、コード生成中心のワークロードでない限り Q4_K_M を推奨し、最高品質を狙う場合は BF16 を選ぶべきだと述べています。