セマンティック類似度を超えて:健康格差への影響を踏まえた医療質問応答システムのコンポーネント別評価フレームワーク

arXiv cs.CL / 2026/4/22

💬 オピニオンIdeas & Deep AnalysisModels & Research

要点

- この論文は、医療質問応答にLLMを用いる際の既存の評価指標がセマンティック類似度に過度に依存しており、医学的な正確性や健康格差に関わるリスクを見落とし得ると主張しています。

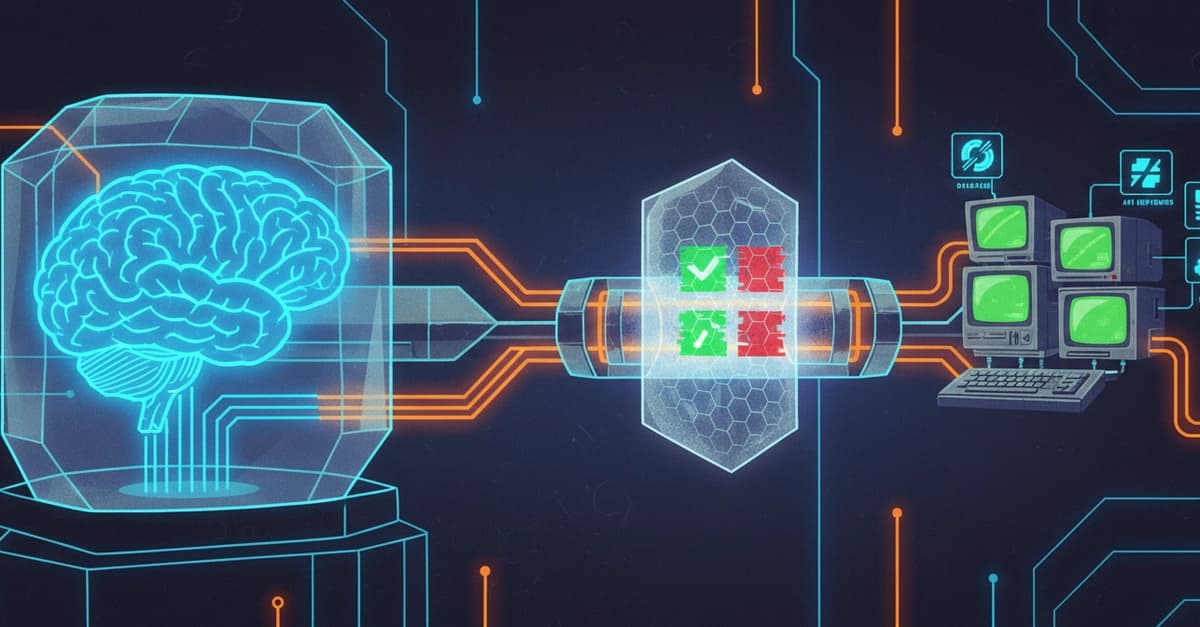

- VB-Score(Verification-Based Score)と呼ばれる新しい枠組みを提案し、エンティティ認識、セマンティック類似度、事実整合性、構造化情報の完全性を別々に評価します。

- 著者らは権威ある情報源から選んだ公衆衛生トピック48件を用いて、広く使われている3つのLLMを厳密に検証し、セマンティック精度とエンティティ精度の間に大きな不一致があることを見出しました。

- VB-Score基準で評価すると、3モデルはいずれも深刻な性能低下が一様に見られ、また高齢者やマイノリティ集団に関わる慢性疾患トピックでは平均に対して約13.8%低い性能となるなど、条件に基づくアルゴリズム上の差別(condition-based algorithmic discrimination)を報告しています。

- その結果から、プロンプトエンジニアリングだけでは医療エンティティ抽出に関する基礎的な制約を補えないことが示され、セマンティック評価のみでは医療AIの安全性と公平性を十分に測れない可能性が提起されています。