Abstract

大規模言語モデルは、タスクの複雑さに応じてスケールする複雑なエージェント型システムとしてますます導入が進んでいます。先行研究ではモデルレベルおよびシステムレベルのスケーリングが広く検討されている一方で、アルゴリズムレベルおよびタスクレベルのスケーリングは、ほとんど未解決のままです。これが、エージェント型システムの可能性を十分に引き出すことを制約しています。アルゴリズムレベルでは、推論時の追加計算を割り当てることでワークフローの処理能力を高められる一方、経路間の冗長性が生じます。すなわち、複数の推論ブランチにわたって計算が重複し、冗長になるのです。タスクレベルでは、複雑なタスクをサブ問題に分解し、複数のエージェントに委譲することで、スケーラビリティと並列性を向上できます。しかし、既存のインフラストラクチャのスケジューリングは複数のエージェントの存在を認識していないため、リソース配分を最適化する機会を逃しています。

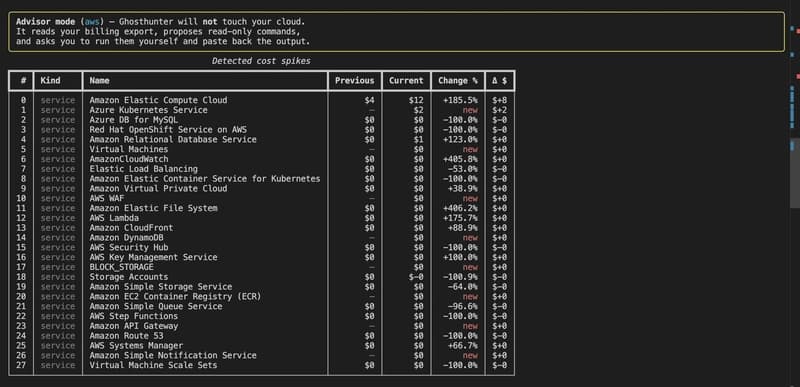

我々は、アルゴリズムレベルおよびタスクレベルのスケーリングを可能にするマルチエージェント基盤であるHiveを提案します。Hiveには、エージェントごとの振る舞いを捉える記述フロントエンドがあり、テスト時スケーリングアルゴリズムをサポートします。この仕様を活用して、バックエンドは2つの主要なメカニズムを導入します。アルゴリズムレベルでの経路間冗長性を緩和するために、冗長なサンプリング経路にまたがって中間のlogitsを再利用するLogits Cacheと、タスクレベルでエージェントの貢献に応じて計算およびKV-cacheリソースを効率的に割り当てるAgent-Aware Schedulingです。実験の結果、Logits Cacheは再サンプリングにおいて平均で1.11 imes〜1.76 imesの高速化を達成し、Agent-Aware Schedulingはホットスポットのミス率を33〜51低減することが示されました。